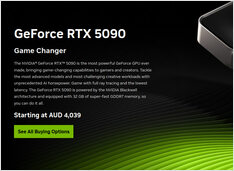

Рост цен на GPU и ОЗУ в Австралии: RTX 5090 подорожал на 15%, ОЗУ — на 38% — январь 2026 года

Проверка цен на GPU и RAM в январе 2025 года

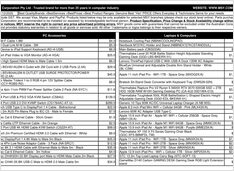

Сегодня мы рассматриваем топовые потребительские графические процессоры и модули оперативной памяти. Конкретно я смотрю на цены на RTX-5080 и RTX-5090, а также на 32ГБ (2x16ГБ) DDR5 6000.