Сравнение AI-ассистентов программирования

Cursor AI против GitHub Copilot против Cline AI против...

Список здесь некоторых инструментов для кодирования с помощью ИИ и AI Coding Assistants и их приятных сторон.

Cursor AI против GitHub Copilot против Cline AI против...

Список здесь некоторых инструментов для кодирования с помощью ИИ и AI Coding Assistants и их приятных сторон.

Ollama на процессорах Intel: эффективность против производительных ядер

У меня есть теория, которую нужно проверить - использование всех ядер Intel CPU повысит скорость работы LLMs? (Тест: Как Ollama использует производительность и эффективные ядра Intel CPU)

Меня беспокоит, что новая модель gemma3 27 бит (gemma3:27b, 17ГБ в ollama) не помещается в 16ГБ видеопамяти моей GPU и частично работает на CPU.

Настройка ollama для параллельного выполнения запросов.

Когда сервер Ollama получает два запроса одновременно, его поведение зависит от конфигурации и доступных системных ресурсов.

Сравнение двух моделей deepseek-r1 с двумя базовыми

DeepSeek’s первая генерация моделей рассуждений с производительностью, сопоставимой с OpenAI-o1, включает шесть плотных моделей, дистиллированных на основе Llama и Qwen.

Обновленный список команд Ollama - ls, ps, run, serve и т.д.

Этот Ollama CLI cheatsheet фокусируется на командах, которые вы используете каждый день (ollama ls, ollama serve, ollama run, ollama ps, управление моделями и общие рабочие процессы), с примерами, которые можно скопировать/вставить.

Следующий раунд тестирования LLM

Недавно был выпущен Mistral Small. Давайте посмотрим, как он справляется в сравнении с другими языковыми моделями (тестирование производительности Mistral Small).

Python-код для переранжирования в RAG

Пересортировка — это второй этап в системах генерации с расширением поиска (RAG) системы, расположенный между этапом извлечения и генерации.

Так много моделей с миллиардами параметров…

Тестирование, как Perplexica работает с различными LLM, запущенными на локальном Ollama: Llama3, Llama3.1, Hermes 3, Mistral Nemo, Mistral Large, Gemma 2, Qwen2, Phi 3 и Command-r различных квант и выбор Лучший LLM для Perplexica

Сравнение двух самонастраиваемых поисковых движков ИИ

Вкусная еда - это удовольствие не только для глаз. Но в этом посте мы сравним две системы поиска на основе ИИ, Farfalle и Perplexica.

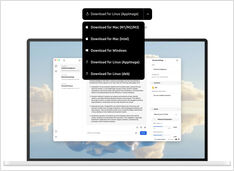

Запуск сервиса в стиле Copilot на локальном компьютере? Легко!

Это очень волнующе! Вместо того чтобы звонить в Copilot или Perplexity.ai и рассказывать всему миру, что вы ищете, теперь вы можете разместить аналогичную службу на своем ПК или ноутбуке!

Тестирование обнаружения логических ошибок

Недавно мы увидели несколько новых языковых моделей, которые были выпущены. Возбуждающие времена. Давайте протестируем и посмотрим, как они работают при обнаружении логических ошибок.

Не так много вариантов на выбор, но всё же...

Когда я начал экспериментировать с ЛЛМ, интерфейсы для них находились в стадии активной разработки, и теперь некоторые из них действительно хороши.

Требует некоторого экспериментирования, но

Есть ещё несколько общепринятых подходов к написанию хороших промптов, чтобы LLM не запуталась, пытаясь понять, чего вы хотите от неё.

8 версий LLM llama3 (Meta+) и 5 версий phi3 (Microsoft)

Исследование поведения моделей с разным количеством параметров и квантования.

Файлы моделей LLM Ollama занимают много места

После установки ollama лучше сразу переконфигурировать ollama для хранения их в новом месте. Таким образом, после того как мы загрузим новую модель, она не будет скачана в старое место.