ASIC для больших языковых моделей и специализированные чипы для вывода (почему они важны)

ASIC и специализированные кремниевые решения повышают скорость и эффективность вывода LLM

Будущее ИИ связано не только с более умными моделями. Речь также идет о кремнии, который соответствует тому, как эти модели фактически обслуживаются. Специализированное оборудование для инференса LLM следует путем, напоминающим переход майнинга биткоинов с графических процессоров (GPU) на специализированные интегральные схемы (ASIC), только с более жесткими ограничениями, поскольку модели и схемы точности постоянно эволюционируют.

Для получения дополнительной информации о пропускной способности, задержке, видеопамяти (VRAM) и тестах производительности в различных средах выполнения и на разном оборудовании, см. Производительность LLM: тесты, узкие места и оптимизация.

Электрическое воображение — Flux text to image LLM.

Электрическое воображение — Flux text to image LLM.

Почему LLM выигрывают от оборудования, предназначенного для инференса

Большие языковые модели трансформировали ИИ, но каждый беглый ответ зависит от огромных, предсказуемых потоков матричной математики и трафика памяти. По мере роста расходов на инференс — которые часто превышают расходы на обучение на протяжении жизненного цикла модели — чипы, оптимизированные для обслуживания, а не для любой возможной задачи, становятся экономически привлекательными.

Аналогия с майнингом биткоинов неполна, но поучительна. В обоих случаях речь идет о повторяющихся, строго ограниченных задачах, где удаление неиспользуемой универсальности кристалла может обеспечить значительный прирост пропускной способности и снижение энергозатрат на полезную операцию.

Что история майнинга биткоинов говорит об ASIC для инференса

Майнинг биткоинов прошел через четыре поколения:

| Эпоха | Оборудование | Ключевое преимущество | Ограничение |

|---|---|---|---|

| 2015–2020 | GPU (CUDA, ROCm) | Универсальность | Высокое энергопотребление, зависимость от памяти |

| 2021–2023 | TPU, NPU | Грубая специализация | Все еще ориентированы на обучение |

| 2024–2025 | Трансформаторные ASIC | Настроены на инференс с низкой точностью | Ограниченная универсальность |

ИИ следует похожим путем. Каждый переход улучшал производительность и энергоэффективность на порядки.

Однако, в отличие от ASIC для биткоинов (которые вычисляют только SHA-256), ASIC для инференса нуждаются в некоторой гибкости. Модели эволюционируют, архитектуры меняются, а схемы точности улучшаются. Заключается хитрость в том, чтобы специализироваться достаточно — жестко прошивая основные паттерны, сохраняя при этом адаптивность на периферии.

Чем инференс LLM отличается от обучения (и какие аспекты используют чипы)

Нагрузки инференса выявляют паттерны, на которые может ориентироваться специализированное оборудование:

- Доминирование низкой точности — 8-битная, 4-битная, а также тернарная или бинарная арифметика хорошо работают для инференса

- Память является узким местом — Перемещение весов и кэшей KV потребляет гораздо больше энергии, чем вычисления

- Задержка важнее пропускной способности — Пользователи ожидают токены менее чем за 200 мс

- Массовый параллелизм запросов — Тысячи одновременных запросов на инференс на один чип

- Предсказуемые паттерны — Слои трансформеров высоко структурированы и могут быть жестко прошиты

- Возможности разреженности — Модели все чаще используют методы прунинга (обрезки) и MoE (смесь экспертов)

Специализированный чип для инференса может жестко зашить эти предположения, чтобы достичь в 10–50 раз лучшей производительности на ватт, чем универсальные графические процессоры.

Кто создает кремний, оптимизированный для инференса LLM

Рынок ASIC для инференса охватывает действующих игроков, проекты масштаба кристалла и стартапы, делающие ставку на кремний формы трансформера:

| Компания | Чип / Платформа | Специализация |

|---|---|---|

| Groq | LPU (Блок обработки языка) | Детерминированная пропускная способность для LLM |

| Etched AI | ASIC Sohu | Жестко прошитый движок трансформера |

| Tenstorrent | Grayskull / Blackhole | Общий ML с высокопропускной сетью |

| Taalas | HC1 (продукт Llama 3.1 8B) / дорожная карта HC2 | Специализированный «жесткий» кремний; объединяет хранение и вычисления |

| OpenAI × Broadcom | Специальный чип для инференса | По слухам, выход в 2026 году |

| Intel | Crescent Island | GPU Xe3P только для инференса с 160 ГБ HBM |

| Cerebras | Кристалл-масштабный движок (WSE-3) | Огромная пропускная способность памяти внутри кристалла |

Большая часть этого уже находится в производственных центрах обработки данных, а не в презентациях. Такие небольшие команды, как d-Matrix, Rain AI, Mythic и Tenet, также разрабатывают архитектуры, настроенные на инференс с низкой точностью и структурированную разреженность.

Taalas HC1, Chat Jimmy и сверхбыстрое обслуживание малых моделей

Taalas — недавний пример школы «специализируйся почти на всем». Компания утверждает, что граница между памятью и вычислениями (DRAM вне кристалла против SRAM внутри кристалла) определяет стоимость, энергопотребление и сложность инженерии для инференса, и что кремний для конкретной модели — то, что они называют Hardcore Models (Жесткими моделями), — может устранить эту границу, когда развертывание готово зафиксировать веса и граф.

Их первый выпущенный продукт, HC1, жестко прошивает вариант Llama 3.1 8B. Этот выбор прагматичен: модель достаточно мала для быстрого запуска, открыто документирована и все еще полезна для многих задач автоматизации, классификации и черновиков, где глубина рассуждений имеет меньшее значение, чем задержка и стоимость. Taalas сообщает о скорости порядка 16–17 тысяч декодированных токенов в секунду на пользователя для этой конфигурации (методология вендора и сравнения приведены в их отчете), а также заявляет о значительном выигрыше в капитальных и энергетических затратах по сравнению с традиционными стеками GPU для того же класса моделей. Чипы первого поколения используют агрессивное смешанное хранение с низкой точностью; компания описывает переход к стандартным форматам с плавающей запятой с 4-битной точностью на HC2 для восстановления запаса качества.

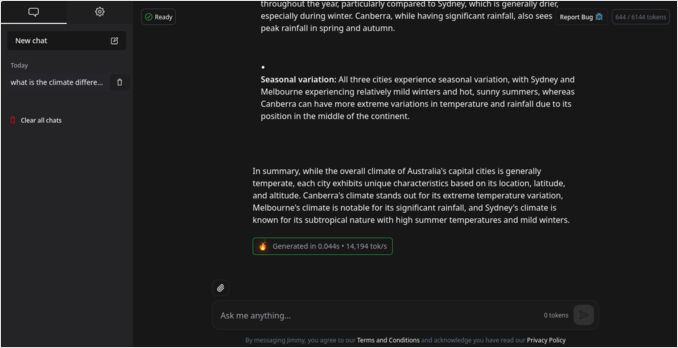

Для разработчиков, которые хотят почувствовать, что означает такая пропускная способность на практике, Taalas запускает бесплатную демо-версию чат-бота, Chat Jimmy, и предлагает доступ к API через форму заявки на их сайте. Это явно доказательство концепции — а не передовой ассистент — но это иллюстрирует реальную аудиторию, которая может предпочесть скромную модель со «скоростью человеческого мышления» более крупной модели, которая кажется медленной или дорогой.

Архитектура ASIC для инференса трансформера

Как на самом деле выглядит чип, оптимизированный для трансформера, под капотом?

+--------------------------------------+

| Интерфейс хоста |

| (PCIe / CXL / NVLink / Ethernet) |

+--------------------------------------+

| Внутрикристальная шина (mesh/ring) |

+--------------------------------------+

| Вычислительные плитки / Ядра |

| — Блоки плотного матричного умножения |

| — АЛП с низкой точностью (int8/int4) |

| — Блоки деквантования / активации |

+--------------------------------------+

| Внутрикристальная SRAM и буферы кэша KV |

| — Горячие веса, объединенные кэши |

+--------------------------------------+

| Конвейеры квантования / деквантования |

+--------------------------------------+

| Планировщик / Контроллер |

| — Движок выполнения статического графа |

+--------------------------------------+

| Интерфейс внекристальной DRAM / HBM |

+--------------------------------------+

Ключевые архитектурные особенности включают:

- Вычислительные ядра — Блоки плотного матричного умножения, оптимизированные для операций int8, int4 и тернарных операций

- Внутрикристальная SRAM — Большие буферы хранят горячие веса и кэши KV, минимизируя дорогостоящие обращения к DRAM

- Потоковые шины — Топология mesh обеспечивает эффективное масштабирование между несколькими чипами

- Движки квантования — Квантование/деквантование в реальном времени между слоями

- Стек компилятора — Преобразует графы PyTorch/ONNX непосредственно в микрокоманды, специфичные для чипа

- Жестко прошитые ядра внимания — Устраняет накладные расходы управления потоком для softmax и других операций

Философия дизайна напоминает ASIC для биткоинов: каждый транзистор служит конкретной задаче. Никакого потраченного впустую кремния на функции, которые не нужны для инференса.

Сравнение производительности GPU и ASIC для инференса LLM

Представительные публичные данные показывают, как специализированное оборудование для инференса может оторваться от универсальных стеков GPU на тех же семействах моделей (всегда проверяйте методологию и предположения о пакетной обработке для ваших собственных нагрузок):

| Модель | Оборудование | Пропускная способность (токенов/с) | Время до первого токена | Множитель производительности |

|---|---|---|---|---|

| Llama-2-70B | NVIDIA H100 (8x DGX) | ~80–100 | ~1.7 с | Базовый (1×) |

| Llama-2-70B | Groq LPU | 241–300 | 0.22 с | В 3–18 раз быстрее |

| Llama-3.3-70B | Groq LPU | ~276 | ~0.2 с | Стабильно в 3× |

| Gemma-7B | Groq LPU | 814 | <0.1 с | В 5–15 раз быстрее |

| Llama-3.1-8B | Taalas HC1 (вендор) | ~16k–17k декод. т/с/пользователь | — | Отдельная ось (фиксированный граф 8B, не 70B) |

Источники: Groq.com, ArtificialAnalysis.ai, NVIDIA Developer Blog; данные Taalas HC1 из продуктового поста компании.

Строки, посвященные Groq, показывают значительный прирост пропускной способности и времени до первого токена по сравнению с базовым высокоуровневым GPU для больших моделей. Строка Taalas не является еще одним множителем по сравнению с моделями на 70B; она иллюстрирует, насколько далеко можно зайти с декодированием на пользователя, когда модель и граф фиксированы в кремнии, ценой гибкости.

Компромиссы при специализации кремния для инференса

Специализация покупает производительность, но возвращает риски для продукта и инженерии:

-

Гибкость против эффективности. Полностью фиксированный ASIC быстро обрабатывает сегодняшние модели трансформера, но может испытывать трудности с архитектурами завтрашнего дня. Что произойдет, когда механизмы внимания эволюционируют или появятся новые семейства моделей?

-

Квантование и точность. Более низкая точность экономит огромное количество энергии, но управление деградацией точности требует сложных схем квантования. Не все модели легко квантуются до 4 бит или меньше.

-

Программная экосистема. Оборудование без надежных компиляторов, ядер и фреймворков бесполезно. NVIDIA по-прежнему доминирует во многом благодаря зрелой экосистеме CUDA. Производителям новых чипов необходимо инвестировать значительные средства в программное обеспечение.

-

Стоимость и риск. Выпуск чипа на фабрику стоит десятки миллионов долларов и занимает 12–24 месяца. Для стартапов это огромная ставка на архитектурные предположения, которые могут не сбыться.

Тем не менее, в масштабах гиперскейла, даже прирост эффективности в 2× переводится в миллиарды долларов экономии. Для провайдеров облачных услуг, обрабатывающих миллионы запросов на инференс в секунду, кастомный кремний становится все более обязательным.

Список желаний: спецификация чипа для инференса LLM

| Характеристика | Идеальная спецификация |

|---|---|

| Процесс | Узел 3–5 нм |

| Внутрикристальная SRAM | 100 МБ+ тесно связанная |

| Точность | Нативная поддержка int8 / int4 / тернарная |

| Пропускная способность | 500+ токенов/сек (модель 70B) |

| Задержка | <100 мс время до первого токена |

| Шина | Сеть с низкой задержкой или оптические линии |

| Компилятор | PyTorch/ONNX → микрокод, инструментальная цепочка |

| Энергия | <0.3 джоуля на токен |

Взгляд в будущее (2026–2030)

Ожидается, что ландшафт оборудования для инференса разделится на три грубые категории:

-

Чипы для обучения. Высокоуровневые графические процессоры, такие как NVIDIA B200 и AMD Instinct MI400, продолжат доминировать в обучении благодаря своей гибкости FP16/FP8 и огромной пропускной способности памяти.

-

ASIC для инференса. Жестко прошитые акселераторы трансформера с низкой точностью будут обрабатывать производственное обслуживание в гипермасштабе, оптимизированные для стоимости и эффективности.

-

NPU для периферии (Edge). Маленькие, сверхэффективные чипы принесут квантованные LLM в смартфоны, автомобили, устройства IoT и роботы, обеспечивая интеллектуальные возможности на устройстве без зависимости от облака.

Помимо самого оборудования, мы увидим:

- Гибридные кластеры — GPU для гибкого обучения, ASIC (или кристалл-масштабные движки инференса) для эффективного обслуживания

- Инференс как услуга — Гиперскейлеры, смешивающие акселераторы собственного производства (AWS Inferentia, Google TPU и другие) с GPU

- Совместный дизайн аппаратного и программного обеспечения — Модели, созданные для блочной разреженности, маршрутизации MoE и слоев, дружественных к квантованию

- Кремний для конкретной модели или семейства — Компании, такие как Taalas, делают ставку на то, что некоторые развертывания пожертвуют архитектурной гибкостью ради экстремальной стоимости и задержки на известном графе

- Открытые API для инференса — Давление на необходимость сохранения портативности интерфейсов обслуживания даже когда кремний не является портативным

Финальные мысли

«АСИК-зация» ИИ-инференса уже началась. Так же, как майнинг биткоинов эволюционировал от ЦПУ к специализированному кремнию, развертывание ИИ следует по тому же пути.

Следующая революция в ИИ будет не о более крупных моделях — она будет о лучших чипах. Оборудование, оптимизированное для специфических паттернов инференса трансформера, определит, кто сможет экономично развертывать ИИ в масштабе.

Так же, как майнеры биткоинов оптимизировали каждый потраченный ватт, оборудование для инференса будет выжимать каждый последний FLOP-на-джоуль. Когда это произойдет, настоящий прорыв будет не в алгоритмах — он будет в кремнии, который их выполняет.

Будущее ИИ высечено в кремнии, по одному транзистору за раз.

Для получения дополнительных тестов производительности, выбора оборудования и настройки производительности посетите наш хаб Производительность LLM: тесты, узкие места и оптимизация.

Полезные ссылки

- Официальные тесты Groq

- Taalas — Путь к повсеместному ИИ (HC1, дорожная карта, философия)

- Chat Jimmy — Демо Llama 3.1 8B от Taalas

- Форма заявки на доступ к API Taalas

- Artificial Analysis - Лидерборд производительности LLM

- Технический бюллетень NVIDIA H100

- Etched AI - Объявление об ASIC для трансформеров

- Кристалл-масштабный движок Cerebras

- Цены на NVidia RTX 5080 и RTX 5090 в Австралии - Октябрь 2025

- Производительность LLM и линии PCIe: ключевые соображения

- Тест скорости больших языковых моделей

- Сравнение пригодности GPU NVidia для ИИ

- Насколько хорош Quadro RTX 5880 Ada 48GB?