Модели встраивания и переупорядочивания Qwen3 на Ollama: передовые показатели производительности

Новые впечатляющие LLM доступны в Ollama

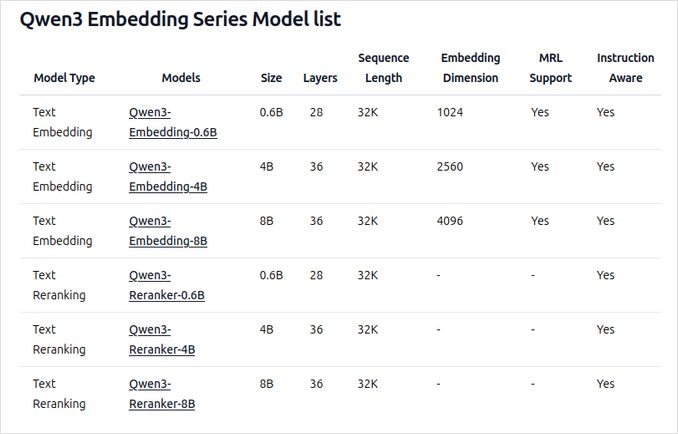

Модели встраивания и переупорядочивания Qwen3 являются новейшими релизами в семействе Qwen, специально разработанными для продвинутых задач встраивания текста (embedding), поиска и переупорядочивания результатов (reranking).

Визуальное удовольствие

Модели Qwen3 Embedding и Reranker представляют собой значительный прорыв в многоязычной обработке естественного языка (NLP), предлагая передовые результаты в задачах встраивания текста и переупорядочивания. Эти модели, входящие в серию Qwen, разработанную Alibaba, предназначены для поддержки широкого спектра приложений: от семантического поиска до поиска кода. Такие возможности встраивания являются фундаментальными для создания эффективных систем RAG, что подробно рассматривается в Учебнике по генерации с дополнением извлечения (RAG): архитектура, реализация и руководство для продакшена. Хотя Ollama является популярной платформой с открытым исходным кодом для размещения и развертывания больших языковых моделей (LLM), интеграция моделей Qwen3 с Ollama не подробно описана в официальной документации. Тем не менее, модели доступны через Hugging Face, GitHub и ModelScope, что позволяет потенциально развернуть их локально через Ollama или аналогичные инструменты.

Примеры использования этих моделей

Пожалуйста, ознакомьтесь с образцами кода на Go с использованием ollama и этими моделями:

- Переупорядочивание текстовых документов с помощью Ollama и модели Qwen3 Embedding — на Go

- Переупорядочивание текстовых документов с помощью Ollama и модели Qwen3 Reranker — на Go

Обзор новых моделей Qwen3 Embedding и Reranker на Ollama

Эти модели теперь доступны для развертывания на Ollama в различных размерах, обеспечивая передовую производительность и гибкость для широкого спектра языковых и связанных с кодом приложений.

Ключевые особенности и возможности

-

Размеры моделей и гибкость

- Доступны в нескольких размерах: 0.6B, 4B и 8B параметров как для задач встраивания, так и для переупорядочивания.

- Модель встраивания 8B в настоящее время занимает 1-е место в многоязычном лидерстве MTEB (по состоянию на 5 июня 2025 года, со счетом 70.58).

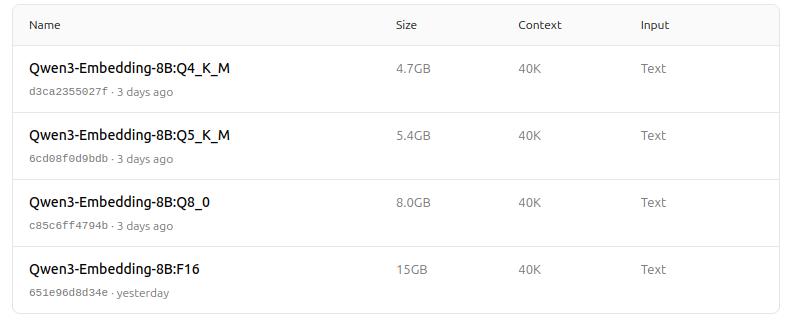

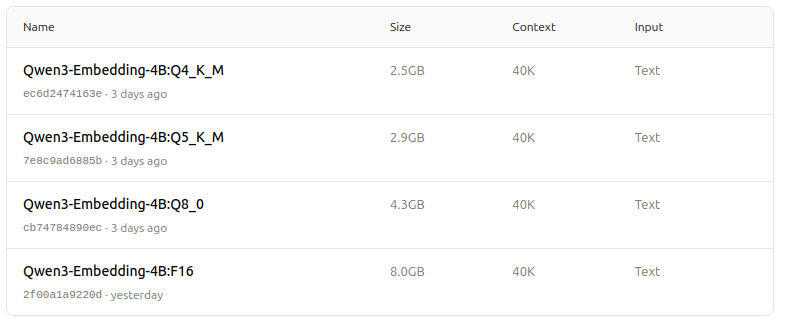

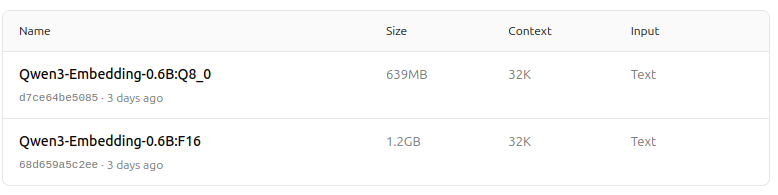

- Поддерживает ряд опций квантования (Q4, Q5, Q8 и т. д.) для баланса между производительностью, использованием памяти и скоростью. Q5_K_M рекомендуется для большинства пользователей, так как он сохраняет большую часть производительности модели, оставаясь при этом эффективным по ресурсам.

-

Архитектура и обучение

- Построены на основе Qwen3, используя как двухкодерную (для встраиваний), так и кросс-кодерную (для переупорядочивания) архитектуры.

- Модель встраивания: обрабатывает отдельные сегменты текста, извлекая семантические представления из финального скрытого состояния.

- Модель переупорядочивания: принимает пары текста (например, запрос и документ) и выдает оценку релевантности, используя подход кросс-энкодера.

- Модели встраивания используют трехэтапную парадигму обучения: контрастное предобучение, контролируемое обучение с использованием высококачественных данных и объединение моделей для оптимальной обобщающей способности и адаптивности.

- Модели переупорядочивания обучаются напрямую на высококачественных размеченных данных для обеспечения эффективности и результативности.

-

Многоязычная и многозадачная поддержка

- Поддерживает более 100 языков, включая языки программирования, обеспечивая надежные возможности многоязычного, межъязыкового и поиска кода.

- Модели встраивания позволяют гибко определять векторы и использовать пользовательские инструкции для настройки производительности под конкретные задачи или языки.

- Для приложений, требующих мультимодальных возможностей beyond текста, см. Кросс-модальные встраивания: объединение модальностей ИИ.

-

Производительность и сценарии использования

- Передовые результаты в извлечении текста, поиске кода, классификации, кластеризации и поиске билингвальных текстов.

- Модели переупорядочивания превосходно справляются с различными сценариями извлечения текста и могут бесшовно комбинироваться с моделями встраивания для создания конвейеров извлечения от начала до конца.

Как использовать на Ollama

Вы можете запустить эти модели на Ollama с помощью команд:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

Выберите версию квантования, которая лучше всего соответствует вашим аппаратным требованиям и потребностям в производительности.

Обновление декабрь 2025: Теперь Ollama предоставляет стандартные модели встраивания Qwen3 из своего собственного репозитория, а не от dengcao:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

Подробнее: https://ollama.com/library/qwen3-embedding

Сводная таблица

| Тип модели | Доступные размеры | Ключевые преимущества | Многоязычная поддержка | Опции квантования |

|---|---|---|---|---|

| Embedding | 0.6B, 4B, 8B | Топовые баллы MTEB, гибкость, эффективность, SOTA | Да (100+ языков) | Q4, Q5, Q6, Q8, и т.д. |

| Reranker | 0.6B, 4B, 8B | Превосходство в оценке релевантности пар текста, эффективность, гибкость | Да | F16, Q4, Q5, и т.д. |

Потрясающие новости!

Модели Qwen3 Embedding и Reranker на Ollama представляют собой значительный скачок в возможностях многоязычного и многозадачного извлечения текста и кода. Благодаря гибким вариантам развертывания, высоким показателям в бенчмарках и поддержке широкого спектра языков и задач, они отлично подходят как для исследовательских, так и для производственных сред.

Зверинец моделей — визуальное удовольствие сейчас

Qwen3 Embedding

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

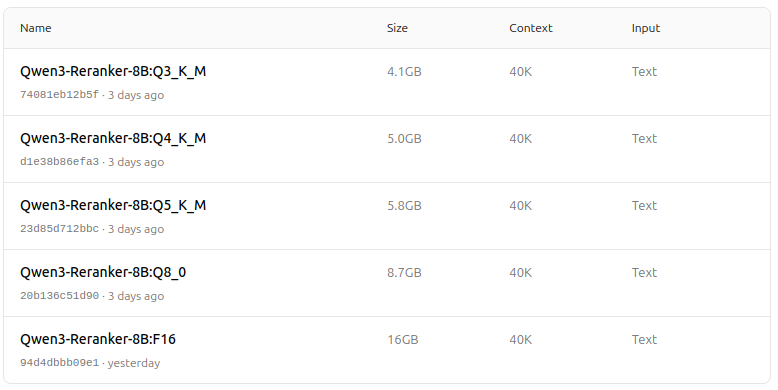

Qwen3 Reranker

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

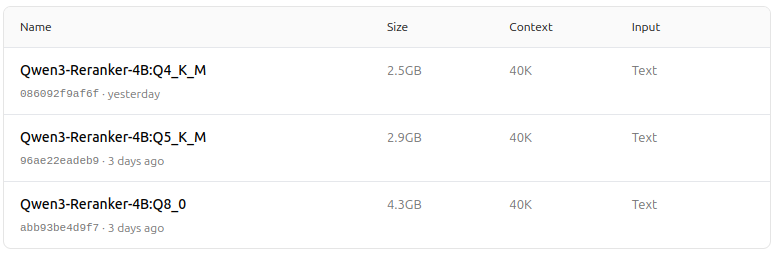

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

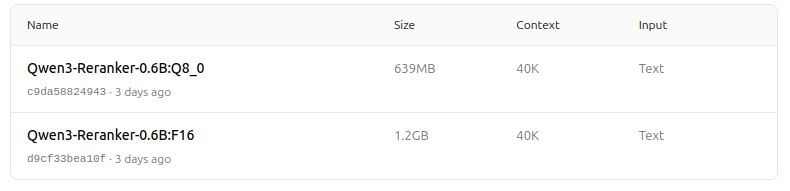

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

Отлично!

Полезные ссылки

- Переупорядочивание текстовых документов с помощью Ollama и модели Qwen3 Embedding — на Go

- Переупорядочивание текстовых документов с помощью Ollama и модели Qwen3 Reranker — на Go

- Шпаргалка по Ollama

- Перемещение моделей Ollama на другой диск или в другую папку

- Самохостинг Perplexica — с Ollama

- Тест: как Ollama использует производительность процессора Intel и эффективные ядра

- Сравнение скорости производительности LLM

- Сравнение способностей LLM к суммированию

- Облачные провайдеры LLM

- Как Ollama обрабатывает параллельные запросы

- Сравнение качества перевода страниц Hugo — LLM на Ollama