Problemi di Output Strutturato di Ollama GPT-OSS

Non molto bello.

Ollama’s GPT-OSS models presentano frequenti problemi nel gestire l’output strutturato, specialmente quando vengono utilizzate con framework come LangChain, OpenAI SDK, vllm e altri.

Non molto bello.

Ollama’s GPT-OSS models presentano frequenti problemi nel gestire l’output strutturato, specialmente quando vengono utilizzate con framework come LangChain, OpenAI SDK, vllm e altri.

Un paio di modi per ottenere un output strutturato da Ollama

Modelli di grandi dimensioni (LLMs) sono potenti, ma in produzione raramente desideriamo paragrafi liberi. Invece, vogliamo dati prevedibili: attributi, fatti o oggetti strutturati che possiamo alimentare in un’app. Questo è LLM Structured Output.

Il mio test della pianificazione del modello ollama

Ecco che confronto quanta VRAM la nuova versione di Ollama alloca per il modello rispetto alla versione precedente di Ollama. La nuova versione è peggio.

La mia opinione sull'attuale stato dello sviluppo di Ollama

Ollama ha rapidamente diventato uno degli strumenti più popolari per eseguire i modelli LLM localmente. La sua semplice CLI e la gestione semplificata dei modelli l’hanno resa un’opzione di riferimento per gli sviluppatori che desiderano lavorare con i modelli AI al di fuori del cloud.

Panoramica rapida delle interfacce utente più prominenti per Ollama nel 2025

Locally hosted Ollama consente di eseguire modelli linguistici di grandi dimensioni sul proprio computer, ma l’utilizzo tramite riga di comando non è particolarmente utente-friendly. Ecco diversi progetti open-source che forniscono interfacce simili a ChatGPT che si connettono a un Ollama locale.

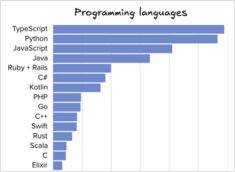

Confronto di strumenti e linguaggi per l'ingegneria del software

La lettera The Pragmatic Engineer pubblicata un paio di giorni fa presenta statistiche di un sondaggio sull’[popolarità dei linguaggi di programmazione, IDE e strumenti AI e altri dati per la metà del 2025.

A luglio 2025, dovrebbe essere disponibile a breve.

Nvidia sta per lanciare NVIDIA DGX Spark - un piccolo supercomputer AI basato sull’architettura Blackwell, con oltre 128 GB di memoria unificata e prestazioni AI da 1 PFLOPS. Un ottimo dispositivo per eseguire LLM.

Implementi RAG? Ecco alcuni frammenti di codice in Go - 2...

Dato che Ollama standard non dispone di una API diretta per il ricalcolo del ranking (reranking), dovrai implementare il reranking utilizzando Qwen3 Reranker in GO generando embedding per le coppie query-documento e assegnando loro un punteggio.

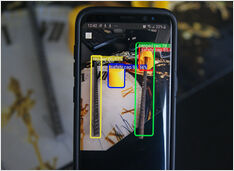

Un po' di tempo fa ho addestrato un riconoscitore oggetti AI

Un freddo giorno d’inverno a luglio… che è in Australia… ho avuto un forte bisogno di addestrare un modello AI per rilevare barre di armatura in calcestruzzo non chiuse…

qwen3 8b, 14b e 30b, devstral 24b, mistral small 24b

In questo test sto confrontando come diversi LLM ospitati su Ollama traducono una pagina Hugo dall’inglese al tedesco.

Implementate RAG? Ecco alcuni snippet di codice in Golang..

Questo piccolo esempio di codice Go per il Reranking chiama Ollama per generare gli embedding per la query e per ciascun documento candidato, ordinando poi in ordine decrescente in base alla similarità coseno.

Stai pensando di installare una seconda GPU per i modelli LLM?

Come le lane PCIe influenzano le prestazioni degli LLM? Dipende dal compito. Per l’addestramento e l’inferenza multi-GPU, la riduzione delle prestazioni è significativa.

LLM per estrarre testo da HTML...

Nella libreria dei modelli Ollama ci sono modelli in grado di convertire contenuti HTML in Markdown, che è utile per compiti di conversione del contenuto. Questa guida fa parte del nostro Strumenti per la Documentazione nel 2026: Markdown, LaTeX, PDF e Flussi di Lavoro per la Stampa hub.

Quale modalità di ricerca AI si adatta al tuo task?

Cursor AI vs GitHub Copilot vs Cline AI vs...

Elencherò qui alcuni strumenti di coding assistito dall’IA e Assistenti di Coding AI e i loro aspetti positivi.

Breve lista di fornitori di LLM

L’uso degli LLM non è molto costoso, potrebbe non esserci bisogno di acquistare un nuovo GPU fantastico. Ecco un elenco se LLM provider in the cloud con gli LLM che ospitano.