Open WebUI: interfaccia self-hosted per LLM

Alternativa self-hosted a ChatGPT per LLM locali

Open WebUI è una potente, estensibile e ricca di funzionalità interfaccia web autoospitata per interagire con i grandi modelli linguistici.

Alternativa self-hosted a ChatGPT per LLM locali

Open WebUI è una potente, estensibile e ricca di funzionalità interfaccia web autoospitata per interagire con i grandi modelli linguistici.

Il calendario essenziale della tecnologia a Melbourne nel 2026

La comunità tecnologica di Melbourne continua a prosperare nel 2026 con un’impressionante serie di conferenze, incontri e workshop che coprono sviluppo software, calcolo cloud, AI, cybersecurity e tecnologie emergenti.

Inferenza rapida di LLM con l'API OpenAI

vLLM è un motore di inferenza e servizio ad alto throughput e a basso consumo di memoria per modelli linguistici su larga scala (LLM), sviluppato dal laboratorio Sky Computing dell’Università della California, Berkeley.

Prezzi AUD reali dai rivenditori australiani ora

L' NVIDIA DGX Spark (GB10 Grace Blackwell) è ora disponibile in Australia nei principali rivenditori di PC con scorte locali. Se segui le prezzi e disponibilità globali del DGX Spark, sarà interessante sapere che i prezzi in Australia variano da 6.249 a 7.999 AUD a seconda della configurazione di archiviazione e del rivenditore.

Guida tecnica per la rilevazione del contenuto generato da AI

La proliferazione del contenuto generato dall’IA ha creato una nuova sfida: distinguere la scrittura umana autentica da “AI slop” - testo sintetico di bassa qualità, prodotto in massa.

Test di Cognee con LLM locali - risultati reali

Cognee è un framework Python per costruire grafi di conoscenza da documenti utilizzando LLM. Ma funziona con modelli auto-hostati?

Output sicuri dal punto di vista del tipo di LLM con BAML e Instructor

Quando si lavora con i Large Language Models in produzione, ottenere output strutturati e sicuri dal punto di vista dei tipi è fondamentale. Due framework popolari - BAML e Instructor - adottano approcci diversi per risolvere questo problema.

Riflessioni sui modelli LLM per Cognee autoospitati

Scegliere il miglior LLM per Cognee richiede di bilanciare la qualità della costruzione del grafo, i tassi di allucinazione e i vincoli hardware. Cognee eccelle con modelli più grandi a bassa allucinazione (32B+) tramite Ollama ma le opzioni di dimensioni medio-piccole funzionano per le configurazioni più leggere.

Scorciatoie essenziali e comandi magici

Jumpstart the produttività del Jupyter Notebook con scorciatiere essenziali, comandi magici e suggerimenti per il flusso di lavoro che trasformeranno l’esperienza di data science e sviluppo.

Costruisci agenti di ricerca AI con Python e Ollama

La libreria Python di Ollama ora include funzionalità native di ricerca web OLLama. Con poche righe di codice, puoi arricchire i tuoi LLM locali con informazioni in tempo reale dal web, riducendo le illusioni e migliorando l’accuratezza.

Scegli il database vettoriale giusto per il tuo stack RAG

La scelta del giusto vettore store può fare la differenza per le prestazioni, i costi e la scalabilità della tua applicazione RAG. Questo confronto completo copre le opzioni più popolari nel 2024-2025.

Costruisci agenti di ricerca AI con Go e Ollama

L’API di ricerca web di Ollama ti permette di integrare LLM locali con informazioni in tempo reale dal web. Questa guida ti mostra come implementare le capacità di ricerca web in Go, dal semplice utilizzo dell’API alle funzionalità complete degli agenti di ricerca.

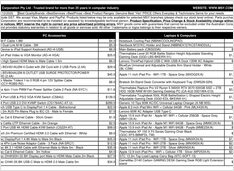

I prezzi della RAM schizzano del 163-619% mentre la domanda di AI mette sotto pressione l'offerta.

Il mercato della memoria sta vivendo una volatilità dei prezzi senza precedenti alla fine del 2025, con i prezzi della RAM in forte aumento che si stanno verificando drammaticamente in tutti i segmenti.

Confronta i migliori strumenti di hosting locale per LLM nel 2026: maturità dell'API, supporto hardware, tool calling e casi d'uso reali.

L’esecuzione di LLM in locale è ora pratica per sviluppatori, startup e persino team aziendali.

Ma la scelta dello strumento giusto — Ollama, vLLM, LM Studio, LocalAI o altri — dipende dai tuoi obiettivi:

Costruisci pipeline AI/ML robuste con microservizi Go

Con l’aumento della complessità dei carichi di lavoro di AI e ML, è diventato più urgente il bisogno di sistemi di orchestrazione robusti. La semplicità, le prestazioni e la concorrenza di Go lo rendono una scelta ideale per costruire lo strato di orchestrazione dei pipeline ML, anche quando i modelli stessi sono scritti in Python.

Unificare testo, immagini e audio in spazi di embedding condivisi

Embeddingi cross-modal rappresentano un passo avanti significativo nell’intelligenza artificiale, consentendo di comprendere e ragionare su diversi tipi di dati all’interno di uno spazio di rappresentazione unificato.