Aplikacje monitorowania GPU w Linux / Ubuntu

Krótki wykaz aplikacji do monitorowania obciążenia GPU

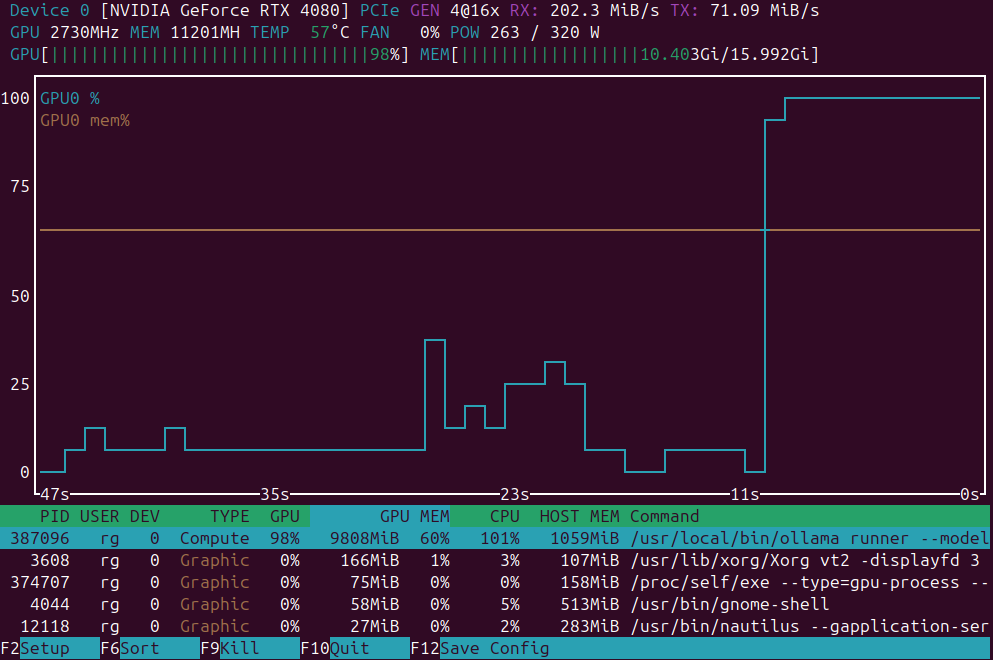

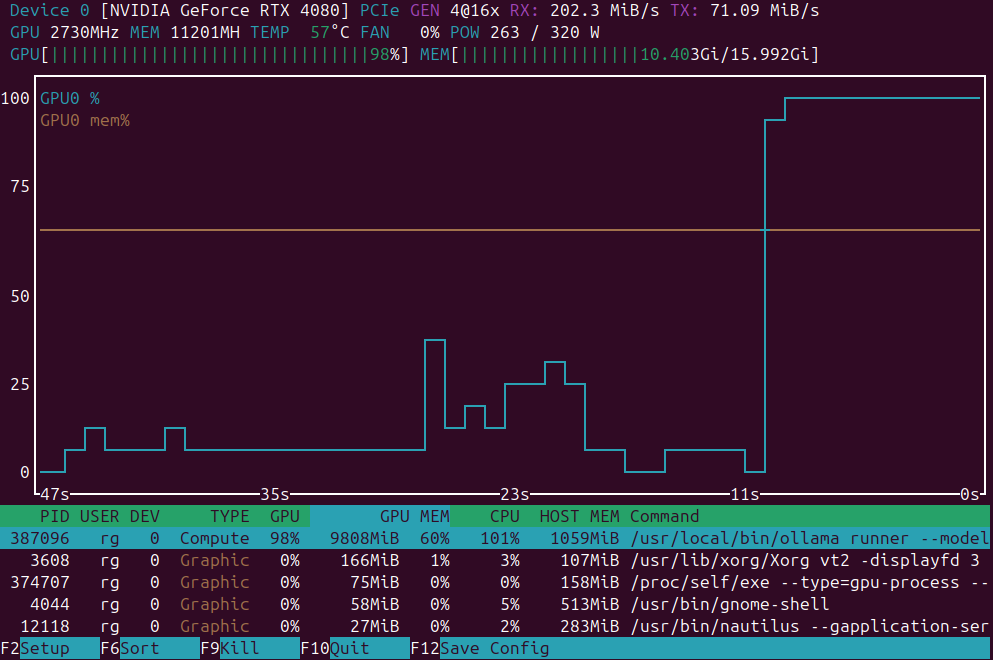

Monitorowanie obciążenia GPU: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

Krótki wykaz aplikacji do monitorowania obciążenia GPU

Monitorowanie obciążenia GPU: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

Instalacja małego klastra Kubernetes z użyciem k3s na homelabie

Oto krok po kroku instrukcja instalacji

3-węzłowego klastra K3s

na serwerach nago metalowych (1 serwer główny + 2 serwery robocze).

Bardzo krótka charakterystyka wersji kubernetes

Porównanie dystrybucji self-hosting Kubernetes przeznaczonych do hostowania na serwerach nago-metalowych lub domowych, zwracając uwagę na łatwość instalacji, wydajność, wymagania systemowe oraz zestaw funkcji.

Wybór najlepszego wariantu Kubernetes dla naszej domowej laboratorium

Porównuję wersje samowystarczalnego Kubernetesa, które nadają się do homelaba opartego na Ubuntu z 3 węzłami (16 GB RAM, 4 rdzenie CPU każdy), skupiając się na łatwości instalacji i konserwacji, obsłudze persistent volumes i LoadBalancers.

Kilka słów o typowych działaniach GitHub Actions i ich strukturze.

GitHub Actions jest platformą automatyzacji i CI/CD w ramach GitHub, używaną do budowania, testowania i wdrażania kodu na podstawie zdarzeń, takich jak push, żądania pull request lub harmonogram.

W przypłyku, docker-compose różni się od docker compose...

Oto Docker Compose cheatshet z opisanymi przykładami, które pomogą Ci szybko opanować pliki i polecenia Compose.

O Obsidian ...

Oto szczegółowy opis

Obsidian jako potężne narzędzie do zarządzania wiedzą osobistą (PKM),

wyjaśniające jego architekturę, funkcje, zalety oraz to, jak wspiera współczesne przepływy wiedzy.

W lipcu 2025 roku, wkrótce będzie dostępny.

Nvidia wkrótce wypuści NVIDIA DGX Spark – mały superkomputer AI oparty na architekturze Blackwell, z ponad 128 GB pamięci unifikowanej i wydajnością AI na poziomie 1 PFLOPS. Wspaniałe urządzenie do uruchamiania LLM.

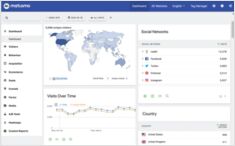

Których systemów analizy webowej warto użyć na swojej stronie internetowej?

Spójrzmy szybko na Matomo, Plausible, google i inne dostawcy i systemy analizy web dostępne do samowystawiania i porównajmy je.

Uwagi dotyczące standardowej sekwencji instalacji Ubuntu 24.04

Oto moje ulubione kroki podczas nowej instalacji Ubuntu 24.04. To, co lubię tutaj – nie muszę instalować sterowników NVidia! Są instalowane automatycznie.

Korzystałem z Dokuwiki jako osobowej bazą wiedzy

Dokuwiki to samowystarczalny wikipedia, który można łatwo hostować lokalnie, bez konieczności korzystania z baz danych.

Wcześniej uruchamiałem go w wersji dockerowej, na moim własnym klastrze Kubernetes.

Aktualizacja cen GPU odpowiednich dla AI – RTX 5080 i RTX 5090

Porównajmy ceny czołowych kart GPU dla konsumentów, które są szczególnie odpowiednie dla modeli LLM i ogólnie dla AI. W szczególności zwróćmy uwagę na ceny RTX 5080 i RTX 5090. Nieco spadły.

Dobry framework do ETS/MLOPS z użyciem Pythona

Apache Airflow to otwarty platforma programowy, zaprojektowana do programistycznej tworzenia, harmonogramowania i monitorowania przepływów pracy – całkowicie w kodzie Pythona, oferując elastyczne i potężne alternatywy dla tradycyjnych, ręcznych lub opartych na interfejsie graficznym narzędzi do zarządzania przepływami pracy.

Wdrażasz RAG? Oto kilka fragmentów kodu w Go – część 2...

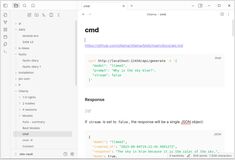

Ponieważ standardowe Ollama nie posiada bezpośredniego interfejsu API do ponownego rankingu (reranking), musisz zaimplementować ponowny ranking przy użyciu Qwen3 Reranker w GO, generując wektory (embeddings) dla par zapytanie-dokument i przypisując im oceny.

qwen3 8b, 14b i 30b, devstral 24b, mistral small 24b

W tym teście porównuję, jak różne LLMs hostowane na Ollama tłumaczą stronę Hugo z języka angielskiego na niemiecki.

Wdrażasz RAG? Oto kilka fragmentów kodu w języku Golang.

Ten niewielki przykład kodu Go do rerankingu wywołuje Ollamę do generowania wektorów dla zapytania oraz dla każdego dokumentu kandydackiego, następnie sortuje wyniki malejąco według podobieństwa kosinusowego.