Porównanie asystentów do kodowania AI

Cursor AI vs GitHub Copilot vs Cline AI vs...

W tym miejscu wymienię niektóre narzędzia wspomagane przez AI do kodowania oraz asystentów kodowania opartych na AI i ich pozytywne strony.

Cursor AI vs GitHub Copilot vs Cline AI vs...

W tym miejscu wymienię niektóre narzędzia wspomagane przez AI do kodowania oraz asystentów kodowania opartych na AI i ich pozytywne strony.

Ollama na procesorze Intel CPU: wydajność a jądra wydajne

Mam teorię do przetestowania – czy wykorzystanie Wszystkich rdzeni na procesorze Intel podniesie prędkość LLM? Zdenerwuje mnie fakt, że nowy model gemma3 27 bit (gemma3:27b, 17GB na ollama) nie mieści się w 16GB VRAM mojej karty graficznej, a częściowo działa na procesorze.

Konfiguracja ollama do wykonywania równoległych żądań.

Gdy serwer Ollama otrzymuje dwa żądania jednocześnie, jego zachowanie zależy od konfiguracji i dostępnych zasobów systemowych.

Porównanie dwóch modeli deepseek-r1 z dwoma modelami bazowymi

Modeli DeepSeek pierwszego pokolenia z wydajnością porównywalną do modeli OpenAI-o1, w tym sześć gęstych modeli oddestylowanych z DeepSeek-R1 opartych na Llama i Qwen.

Zaktualizowana lista poleceń Ollama - ls, ps, run, serve, itp.

Ten cheatsheet CLI Ollama skupia się na poleceniach, które używasz każdego dnia (ollama ls, ollama serve, ollama run, ollama ps, zarządzanie modelami i typowe przepływy pracy), z przykładami, które możesz skopiować i wkleić.

Następny etap testów LLM

Nieco wcześniej wydano. Przejdźmy do sprawy i

testuj jak Mistral Small radzi sobie w porównaniu do innych LLM.

Kod Pythona do ponownego rankingu w RAG.

Porównanie dwóch samodzielnie hostowanych silników wyszukiwania AI

Świetna jedzenie to przyjemność dla oczu również. Ale w tym poście porównamy dwa systemy wyszukiwania oparte na AI, Farfalle i Perplexica.

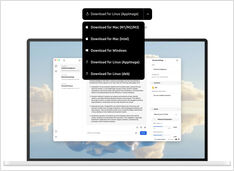

Uruchamianie lokalnego usługi w stylu Copilot? Łatwe!

To bardzo ekscytujące! Zamiast wołać copilot lub perplexity.ai i opowiadać światu, czego szukasz, teraz możesz uruchomić podobną usługę na własnym komputerze lub laptopie!

Testowanie wykrywania błędnego rozumowania

Niedawno widzieliśmy kilka nowych LLM, które zostały wydane. Wspaniałe czasy. Zróbmy test i zobaczmy, jak działają, gdy wykrywają błędy logiczne.

Nieco mniej do wyboru, ale nadal...

Kiedy zacząłem eksperymentować z LLM, interfejsy do nich były w aktywnym rozwoju, a teraz niektóre z nich są naprawdę dobre.

Wymaga pewnego doświadczenia, ale

Nadal istnieją pewne powszechne podejścia do pisania dobrych promptów, dzięki czemu LLM nie będzie się pogubił, próbując zrozumieć, czego od niego oczekujesz.

8 wersji llama3 (Meta+) i 5 wersji phi3 (Microsoft) LLM

Testowanie zachowania modeli o różnej liczbie parametrów i różnym stopniu kwantyzacji.

Pliki modeli LLM Ollama zajmują dużo miejsca.

Po zainstalowaniu ollama lepiej natychmiast skonfigurować Ollama, aby przechowywał je w nowym miejscu. Wtedy, po pobraniu nowego modelu, nie zostanie on pobrany do starego lokalizacji.