Poradnik Retrieval-Augmented Generation (RAG): architektura, implementacja i wdrożenie w produkcji

Od podstawowego RAG do wdrożenia produkcyjnego: fragmentowanie, wyszukiwanie wektorowe, ponowne rankingowanie i ocena – wszystko w jednym przewodniku.

Ten tutorial Retrieval-Augmented Generation (RAG) to krok-po-kroku, skupiony na produkcji przewodnik po budowaniu rzeczywistych systemów RAG.

Jeśli szukasz:

- Jak zbudować system RAG

- Wyjaśnienie architektury RAG

- Tutorial RAG z przykładami

- Jak implementować RAG z bazami wektorowymi

- RAG z rerankingiem

- RAG z wyszukiwaniem w sieci

- Najlepsze praktyki produkcyjnego RAG

Jesteś we właściwym miejscu.

Ten przewodnik konsoliduje praktyczną wiedzę o implementacji RAG, wzorce architektoniczne oraz techniki optymalizacji stosowane w produkcyjnych systemach AI.

Mapa Klastrowa RAG (Czytaj w tej kolejności)

Jeśli szukasz najszybszej ścieżki przez ten klaster RAG, użyj tej mapy:

- Jesteś tutaj: Przegląd RAG + pełny pipeline (ta strona)

- Chunking (podstawa jakości pobierania danych): Strategie Chunkingu w RAG

- Składniki wektorowe (przechowywanie i indeksowanie): Porównanie Składników Wektorowych dla RAG

- Głębokość pobierania (kiedy “wyszukiwanie” to za mało): Search vs DeepSearch vs Deep Research

- Reranking (często największy zysk jakościowy): Reranking z Modelami Embeddingowymi

- Embeddingi + modele rerankera (praktyczne implementacje):

- Zaawansowane architektury: Zaawansowane Warianty RAG: LongRAG, Self-RAG, GraphRAG

Czym jest Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) to wzorzec projektowy systemów, który łączy:

- Pobieranie informacji

- Rozszerzanie kontekstu

- Generowanie przez duże modele językowe

Prosto mówiąc, pipeline RAG pobiera odpowiednie dokumenty i wstrzykuje je do promptu, zanim model wygeneruje odpowiedź.

W przeciwieństwie do fine-tuningu, RAG:

- Działa z często aktualizowanymi danymi

- Wspiera prywatne bazy wiedzy

- Redukuje halucynacje

- Uniknie konieczności ponownego trenowania dużych modeli

- Poprawa ugruntowanie odpowiedzi

Współczesne systemy RAG zawierają więcej niż tylko wyszukiwanie wektorowe. Pełna implementacja RAG może obejmować:

- Pisanie zapytań (query rewriting)

- Wyszukiwanie hybrydowe (BM25 + wektorowe)

- Reranking z użyciem cross-encoders

- Pobieranie wieloetapowe

- Integrację z wyszukiwaniem w sieci

- Ewaluację i monitorowanie

Minimalny Blueprint Produkcyjnego RAG (Implementacja Referencyjna)

Użyj tego jako modelu mentalnego (i szkieletu startowego) dla produkcyjnego RAG.

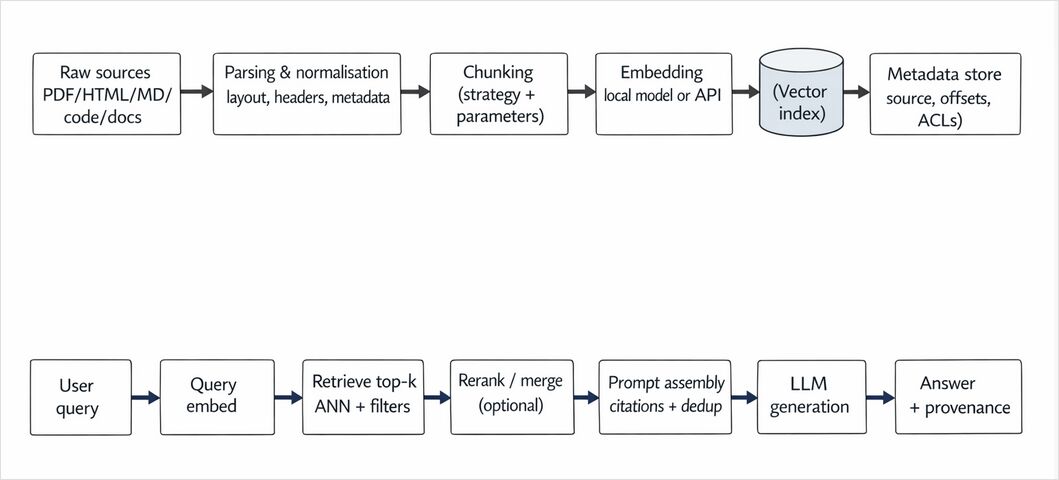

Pipeline Wgrywania (offline lub ciągły)

- Zebranie źródeł (dokumenty, zgłoszenia, strony WWW, PDFy, kod)

- Normalizacja (ekstrakcja tekstu, czyszczenie szablonów, usuwanie duplikatów)

- Chunking (wybór strategii + nakładanie się + metadane)

- Embedding (wersjonowane embeddingi)

- Upsert do indeksu (składnik wektorowy + pola metadanych)

- Strategia ponownego indeksowania przy zmianie embeddingów lub chunkingu

Pipeline Zapytań (online)

- Parsing / przepisanie zapytania (opcjonalnie)

- Pobranie kandydatów (wektorowe lub hybrydowe + filtrowanie metadanymi)

- Reranking top-K z użyciem modelu cross-encoder / reranker

- Złożenie kontekstu (usuwanie duplikatów, sortowanie według istotności, dodawanie cytowań)

- Generowanie z ugruntowanym promptem (reguły + zachowanie odmowy)

- Logowanie (zestaw pobranych, zestaw rerankowanych, finalny kontekst, opóźnienia, koszty)

- Ewaluacja (harnes online/offline)

Jeśli możesz poprawić tylko jedną rzecz w działającym systemie RAG: dodaj reranking i harnes ewaluacyjny.

Krok-po-kroku Tutorial RAG: Jak Zbudować System RAG

Ta sekcja przedstawia praktyczny przepływ tutorialu RAG dla developerów.

Krok 1: Przygotuj i Podziel Dane

Jakość pobierania danych zależy w dużej mierze od strategii chunkingu i projektowania indeksu: dobry RAG zaczyna się od prawidłowego chunkingu.

Chunking determinuje:

- Recall pobierania

- Opóźnienia

- Szum kontekstowy

- Koszt tokenów

- Ryzyko halucynacji

Powszechne strategie chunkingu w RAG obejmują:

- Chunking o stałym rozmiarze

- Chunking oknem przesuwnym

- Chunking semantyczny

- Chunking rekurencyjny

- Chunking hierarchiczny

- Chunking z uwzględnieniem metadanych

Słaby chunking to jedna z najczęstszych przyczyn słabej wydajności systemów RAG.

Aby uzyskać szczegółowe, inżynieryjne podejście do kompromisów chunkingu, wymiarów ewaluacji, macierzy decyzyjnych i działających implementacji Pythona, zobacz:

Strategie Chunkingu w RAG: Alternatywy, Kompromisy i Przykłady

Ten przewodnik obejmuje praktyczne domyślne ustawienia dla:

- Systemów Q&A

- Pipeline’ów do podsumowań

- Wyszukiwania kodu

- Dokumentów multimodalnych

- Wgrywania strumieniowego

- Dokumentów multimodalnych z embeddingami między-modalnymi

Jeśli zależy Ci na wydajności RAG, przeczytaj to przed strojeniem embeddingów lub rerankingu.

Dla systemów RAG multimodalnych, które łączą tekst, obrazy i inne modalności, zapoznaj się z Cross-Modal Embeddings: Bridging AI Modalities

Krok 2: Wybierz Bazę Wektorową dla RAG

Baza wektorowa przechowuje embeddingi dla szybkiego wyszukiwania podobieństw.

Porównaj bazy wektorowe tutaj:

Porównanie Składników Wektorowych dla RAG

Przy wyborze bazy wektorowej dla tutorialu RAG lub systemu produkcyjnego, rozważ:

- Typ indeksu (HNSW, IVF itp.)

- Wsparcie dla filtrowania

- Model wdrożenia (chmura vs self-hosted)

- Opóźnienia zapytań

- Skalalność pozioma

- Wymogi wielodostępności i kontroli dostępu

Krok 3: Zaimplementuj Pobieranie (Wyszukiwanie Wektorowe lub Hybrydowe)

Podstawowe pobieranie RAG używa podobieństwa embeddingów.

Zaawansowane pobieranie RAG używa:

- Wyszukiwania hybrydowego (wektor + słowo kluczowe)

- Filtrowania metadanymi

- Pobierania z wielu indeksów

- Pisania zapytań (query rewriting)

Dla teoretycznego ugruntowania:

Search vs DeepSearch vs Deep Research

Zrozumienie głębi pobierania jest kluczowe dla wysokiej jakości pipeline’ów RAG.

Krok 4: Dodaj Reranking do Pipeline’u RAG

Reranking jest często największą poprawą jakości w implementacji RAG.

Reranking poprawia:

- Precyzję

- Istotność kontekstu

- Wiarygodność

- Stosunek sygnału do szumu

Poznaj techniki rerankingu:

- Reranking z Modelami Embeddingowymi

- Qwen3 Embedding + Qwen3 Reranker na Ollama

- Reranking z Ollama + Qwen3 Embedding (Go)

- Reranking z Ollama + Qwen3 Reranker w Go

W systemach RAG produkcyjnych, reranking często ma większe znaczenie niż przejście na większy model.

Krok 5: Zintegruj Wyszukiwanie w Sieci (Opcjonalnie, ale Potężne)

RAG rozszerzone o wyszukiwanie w sieci umożliwia dynamiczne pobieranie wiedzy.

Wyszukiwanie w sieci jest przydatne dla:

- Danych w czasie rzeczywistym

- Asystentów AI świadomych wiadomości

- Rozpoznawania konkurencji

- Odpowiadania na pytania z otwartego domeny

Zobacz praktyczne implementacje:

Krok 6: Zbuduj Ramy Ewaluacji RAG

Poważny tutorial RAG musi zawierać ewaluację. Bez niej optymalizacja systemu RAG staje się zgadywaniem.

Co mierzyć

| Warstwa | Co mierzyć | Dlaczego to ważne |

|---|---|---|

| Wgrywanie | pokrycie chunków, stopień duplikatów, wersja embeddingu | zapobiega cichemu dryfowi |

| Pobieranie | recall@k, precision@k, MRR/NDCG | mówi, czy pobierasz właściwe dowody |

| Reranking | delta w precision@k względem bazy | validuje ROI rerankera |

| Generowanie | wiarygodność/ugruntowanie, dokładność cytowań, jakość odmowy | redukuje halucynacje |

| System | opóźnienia p50/p95, koszt na zapytanie, hit rate cache | utrzymuje używalność w produkcji |

Minimalny harnes ewaluacyjny (praktyczna lista kontrolna)

- Zbuduj zestaw testowy zapytań (jeśli to możliwe, prawdziwe zapytania użytkowników)

- Dla każdego zapytania przechowuj:

- oczekiwaną odpowiedź lub oczekiwane źródła

- dozwolone źródła (dokumenty gold), jeśli dostępne

- Uruchom batch offline:

- pobierz kandydatów

- wykonaj reranking

- wygeneruj

- oceń (pobieranie + generowanie)

- Śledź metryki w czasie i zablokuj build przy regresji (nawet małej)

Zacznij prosto: 50–200 zapytań wystarczy, aby wykryć poważne regresje.

Zaawansowane Architektury RAG

Gdy już zrozumiesz podstawy RAG, poznaj zaawansowane wzorce:

Zaawansowane Warianty RAG: LongRAG, Self-RAG, GraphRAG

Zaawansowane architektury Retrieval-Augmented Generation umożliwiają:

- Rozumowanie wieloetapowe

- Pobieranie oparte na grafach

- Pętle samokorygujące

- Integrację strukturalnej wiedzy

Te architektury są niezbędne dla systemów AI klasy enterprise.

Kiedy RAG Fajluje (I Jak To Naprawić)

Większość awarii RAG jest zdiagnozowalna, jeśli spojrzeć na warstwy pipeline’u.

- Zwraca nieistotny kontekst → popraw chunking, dodaj filtry metadanych, zaimplementuj wyszukiwanie hybrydowe, dostosuj K.

- Pobiera właściwe dokumenty, ale odpowiada niepoprawnie → dodaj reranking, zmniejsz szum kontekstowy, popraw reguły ugruntowania promptu.

- Halucynuje mimo dobrych dokumentów → wymuś cytowania, dodaj zachowanie odmowy, dodaj ocenę wiarygodności, zmniejsz temperaturę “kreatywności”.

- Jest wolny/drogi → cacheuj pobieranie i embeddingi, zmniejsz K rerankingu, ogranicz kontekst, batchuj embeddingi, dostosuj parametry indeksu ANN.

- Wycieka danych między najemcami → zaimplementuj filtrowanie ACL w momencie pobierania (nie tylko w prompt), oddziel indeksy lub partycje per-najemcę.

Częste Błędy Implementacji RAG

Częste błędy w tutorialach RAG dla początkujących obejmują:

- Używanie zbyt dużych chunków dokumentów

- Pomijanie rerankingu

- Przeciążanie okna kontekstowego

- Brak filtrowania metadanych

- Brak harnesu ewaluacyjnego

Naprawianie tych błędów drastycznie poprawia wydajność systemu RAG.

RAG vs Fine-Tuning

W wielu tutorialach RAG i fine-tuning są mylone. Użyj tego przewodnika decyzyjnego:

| Powinieneś preferować… | Kiedy… |

|---|---|

| RAG | wiedza często się zmienia; potrzebujesz cytowań/audytowalności; masz prywatne dokumenty; chcesz szybkich aktualizacji bez ponownego trenowania |

| Fine-tuning | potrzebujesz spójnego tonu/zachowania; chcesz, by model stosował się do stylu domenowego; Twoja wiedza jest stosunkowo statyczna |

| Oba | potrzebujesz zachowania domenowego i świeżej/prywatnej wiedzy (częste w produkcji) |

Użyj RAG do:

- Pobierania wiedzy zewnętrznej

- Często aktualizowanych danych

- Niższego ryzyka operacyjnego

Użyj fine-tuningu do:

- Kontroli zachowania

- Spójności tonu/stylu

- Adaptacji domenowej, gdy dane są statyczne

Większość zaawansowanych systemów AI łączy Retrieval-Augmented Generation z selektywnym fine-tuningiem.

Najlepsze Praktyki Produkcyjnego RAG

Jeśli przechodzisz od tutorialu RAG do produkcji:

Pobieranie + jakość

- Użyj pobierania hybrydowego

- Dodaj reranking

- Użyj filtrowania metadanymi i usuwania duplikatów

- Śledź metryki pobierania (recall@k / precision@k) w sposób ciągły

Koszt + opóźnienia (nie pomijaj tego)

- Cacheuj:

- Cache embeddingów (identyczny tekst → identyczny embedding)

- Cache pobierania (popularne zapytania)

- Cache odpowiedzi (dla deterministycznych workflow’ów)

- Dostosuj parametry indeksu ANN (HNSW/IVF) i operacje batchowe

- Kontroluj użycie tokenów: mniejszy kontekst, mniej kandydatów, strukturalne prompty

Bezpieczeństwo + prywatność

- Wykonuj kontrolę dostępu w momencie pobierania (filtry ACL / partycje per-najemcę)

- Redaguj lub unikaj indeksowania PII, gdzie to możliwe

- Loguj bezpiecznie (unikaj przechowywania surowych, wrażliwych promptów, jeśli nie jest to wymagane)

Dyscyplina operacyjna

- Wersjonuj swoje embeddingi i strategię chunkingu

- Automatyzuj pipeline’y wgrywania

- Monitoruj metryki halucynacji/wiarygodności

- Śledź koszt na zapytanie

Retrieval-Augmented Generation to nie tylko koncepcja z tutorialu – to dyscyplina architektoniczna produkcyjna.

Podsumowanie

Ten tutorial RAG obejmuje zarówno implementację dla początkujących, jak i zaawansowany projekt systemowy.

Retrieval-Augmented Generation jest kręgosłupem współczesnych aplikacji AI.

Opanowanie architektury RAG, rerankingu, baz wektorowych, wyszukiwania hybrydowego oraz ewaluacji zdecyduje, czy Twój system AI pozostanie demo, czy stanie się gotowy do produkcji.

Ten temat będzie się dalej rozwijał wraz z ewolucją systemów RAG.