Dostawcy LLM w chmurze

Krótki wykaz dostawców LLM

Użycie modeli językowych dużych (LLM) nie jest bardzo drogie, może nie być potrzeby zakupu nowego, wspaniałego GPU.

Oto lista, jeśli dostawcy LLM w chmurze z LLM, które hostują.

Krótki wykaz dostawców LLM

Użycie modeli językowych dużych (LLM) nie jest bardzo drogie, może nie być potrzeby zakupu nowego, wspaniałego GPU.

Oto lista, jeśli dostawcy LLM w chmurze z LLM, które hostują.

Ollama na procesorze Intel CPU: wydajność a jądra wydajne

Mam teorię do przetestowania – czy wykorzystanie Wszystkich rdzeni na procesorze Intel podniesie prędkość LLM? Zdenerwuje mnie fakt, że nowy model gemma3 27 bit (gemma3:27b, 17GB na ollama) nie mieści się w 16GB VRAM mojej karty graficznej, a częściowo działa na procesorze.

Przydatne polecenia MinIO

MinIO oferuje dwa standardowe interfejsy użytkownika: (1) MinIO Console – to interfejs webowy, oraz (2) MinIO Command – to wiersz poleceń util mc.

Przegląd i instalacja Minio

MinIO to system do przechowywania obiektów (object storage) o otwartym kodzie źródłowym i wysokiej wydajności, zaprojektowany tak, aby był w pełni kompatybilny z interfejsem API Amazon S3.

Przestawianie okien terminala od samego początku

Istnieje kilka sposobów, aby rozpocząć grupę narzędzi terminalowych w Linux Mint i uzyskać zautomatyzowane, rozmieszczone terminaly, w zależności od Twojego sposobu pracy i poziomu automatyzacji, jaki chcesz osiągnąć.

AI wymaga dużej ilości mocy...

Wśród burzy współczesnego świata tutaj porównuję specyfikacje techniczne różnych kart odpowiednich do zadań AI

(uczenia głębokiego,

wykrywania obiektów

i modeli językowych).

Są one jednak ogromnie drogie.

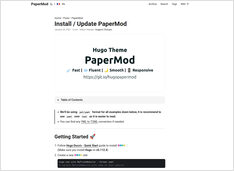

Najpopularniejsze motywy dla Hugo

Zobaczmy na GitHubie listę najlepszych motywów dla Hugo generatora statycznych stron internetowych,

i sprawdź ich ocenę gwiazdami.

Możesz przejść do oficjalnej listy motywów Hugo: https://themes.gohugo.io/

Z wydaniem nowego sterownika pg AutoMigrate zaczyna wyrzucać błędy...

W moim nowym projekcie w Go, który korzystał z GORM, zacząłem otrzymywać błąd:

pq: otrzymano 2 parametry, ale instrukcja wymaga 1

Bezpłatne narzędzie do zarządzania bazą danych w systemach Linux i Windows

DBeaver to uniwersalny narzędzie do zarządzania bazami danych i klient SQL zaprojektowane dla rozwojowców, administratorów baz danych, analityków oraz każdego, kto pracuje z danymi zawodowo.

Konfiguracja ollama do wykonywania równoległych żądań.

Gdy serwer Ollama otrzymuje dwa żądania jednocześnie, jego zachowanie zależy od konfiguracji i dostępnych zasobów systemowych.

Nieco administracji systemowej

Prawdopodobnie teraz warto nazwać to inżynieria platform.

Oto kilka uwag dotyczących instalacji i usuwania Portainer – interfejs użytkownika do zarządzania obrazami i kontenerami Docker.

niektóre przydatne polecenia venv

Venv to narzędzie do zarządzania wirtualnymi środowiskami w wierszu poleceń. Bardziej prosty niż Anaconda. Oto niektóre przydatne polecenia venv.

Kiedy potrzebujesz szybko jakiegoś asynchronicznego działania w chmurze

Krótkie porównanie RabbitMQ na AWS EKS i AWS SQS

Na podstawie liczby zainstalowanych rozszerzeń VS Code

Zagregowałem pewne statystyki instalacji rozszerzeń VS Code według różnych języków programowania.

Najpopularniejszym jest Python, potem C++.

Kiedy musisz wyciągnąć obraz z pliku PDF

Czasami istnieje rzeczywisty potrzeba zapisania obrazów z PDF bez używania zrzutów ekranu ani renderowania PDF na ekranie. pdfimages pomaga w tym. Niniejszy przewodnik jest częścią naszego Narzędzi do Dokumentacji w 2026: Markdown, LaTeX, PDF i Przepływach Drukowania hub.

Programowanie wspierane przez AI, gdzie opisujesz zamiast wpisywać kod.

Vibe coding to napędzane przez sztuczną inteligencję podejście do programowania, w którym deweloperzy opisują pożądaną funkcjonalność w języku naturalnym, a narzędzia AI automatycznie generują kod – przy minimalnym bezpośrednim pisaniu.

Otrzymuj nowe wpisy o systemach, infrastrukturze i inżynierii AI.