プロダクションでの可観測性: モニタリング、メトリクス、Prometheus & Grafanaガイド(2026)

プロダクションシステムのメトリクス、ダッシュボード、アラート — Prometheus、Grafana、Kubernetes、およびAIワークロード。

観測性は、信頼性のある運用システムの基礎です。

メトリクス、ダッシュボード、アラートがなければ、Kubernetesクラスタはドリフトし、AIワークロードは静かに失敗し、レイテンシーの回帰はユーザーが文句を言うまで気づかれません。

プロダクションシステムのメトリクス、ダッシュボード、アラート — Prometheus、Grafana、Kubernetes、およびAIワークロード。

観測性は、信頼性のある運用システムの基礎です。

メトリクス、ダッシュボード、アラートがなければ、Kubernetesクラスタはドリフトし、AIワークロードは静かに失敗し、レイテンシーの回帰はユーザーが文句を言うまで気づかれません。

基本の RAG から本番環境へ:チャンキング、ベクトル検索、再ランク付け、評価を一通りにまとめたガイド。

セルフホストされたLLMでデータとモデルを制御する

LLMを自社でホストすることで、データ、モデル、推論を自らの管理下に置くことができます。これは、チームや企業、国家にとっても実用的な**AI主権**への道です。

RTX 4080(16GB VRAM)でのLLM速度テスト

大規模言語モデルをローカルで実行すると、プライバシーの確保、オフラインでの使用が可能になり、APIコストはゼロになります。このベンチマークでは、RTX 4080上で動作する14のポピュラーなLLMs on Ollamaから期待できる性能が明らかになります。

2026 年 1 月の注目 Python リポジトリ

今月の Python エコシステムは、Claude Skills と AI エージェントツールによって支配されています。 本記事では、GitHub でトレンド入りしている トップの Python リポジトリ を分析します。

2026年1月の人気Rustリポジトリ

RustエコシステムはAIコーディングツールやターミナルアプリケーションにおいて革新的なプロジェクトが爆発的に増加しています。 この概要では、今月のGitHub上でのトップトレンドのRustリポジトリを分析しています。

2026年1月の人気Goリポジトリ

Goエコシステムは、AIツール、セルフホストアプリケーション、開発者インフラにわたる革新的なプロジェクトとともに、ますます活気づいています。この概要では、今月のGitHub上位トレンドGoリポジトリについて分析します。

ローカルLLM用のセルフホスト型ChatGPT代替ソフトウェア

Open WebUI は、大規模言語モデルと対話するための強力で拡張性があり、機能豊富な自己ホスト型ウェブインターフェースです。

OpenAI API を活用した高速 LLM 推論

vLLM は、UC Berkeley の Sky Computing Lab によって開発された、大規模言語モデル(LLM)向けの高速スループットかつメモリエフィレントな推論およびサーバーエンジンです。

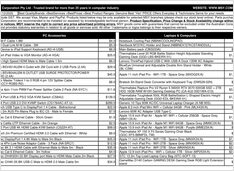

オーストラリアの小売業者から、リアルなオーストラリアドルでの価格を今すぐ。

NVIDIA DGX Spark (GB10 Grace Blackwell) は、主要な PC 小売店に国内在庫があり、オーストラリアで入手可能 となっています。 世界的な DGX Spark の価格と入手性 を追いかけていただいている方なら、オーストラリアでの価格帯はストレージ構成や小売店によって 6,249 オーストラリアドルから 7,999 オーストラリアドル であることが、ご関心をお持ちいただけるでしょう。

AI生成コンテンツの検出に関する技術ガイド

AI生成コンテンツの増加により、新たな課題が生じています。それは、本物の人の書き方と「AIスロップ」(https://www.glukhov.org/ja/post/2025/12/ai-slop-detection/ “AIスロップ”)を区別することです。AIスロップとは、低品質で大量生産された合成テキストのことです。

ローカルLLMを使用してCogneeをテストする - 実際の結果

CogneeはPythonフレームワークで、LLMを使用してドキュメントから知識グラフを構築します。 しかし、これはセルフホストされたモデルと互換性がありますか?

BAML と Instructor を使用した型安全な LLM 出力

LLM(大規模言語モデル)を本番環境で使用する際には、構造化された、型安全な出力を得ることが極めて重要です。

BAMLおよびInstructorという2つの人気のあるフレームワークは、この問題に対して異なるアプローチを取ります。

LLMを自社でホストするCogneeについての考察

Best LLM for Cognee を選ぶ際には、グラフ構築の質、幻覚率、ハードウェアの制約のバランスが求められます。

Cognee は、Ollama を介して 32B 以上の低幻覚モデルで優れた性能を発揮しますが、軽量な設定では中規模のオプションも使用可能です。