Farfalle vs Perplexica

Comparaison de deux moteurs de recherche d'IA auto-hébergés

La bonne nourriture est aussi un plaisir pour les yeux. Mais dans cet article, nous allons comparer deux systèmes de recherche basés sur l’IA, Farfalle et Perplexica.

Comparaison de deux moteurs de recherche d'IA auto-hébergés

La bonne nourriture est aussi un plaisir pour les yeux. Mais dans cet article, nous allons comparer deux systèmes de recherche basés sur l’IA, Farfalle et Perplexica.

Exécuter un service du style Copilot localement ? Facile !

C’est très excitant !

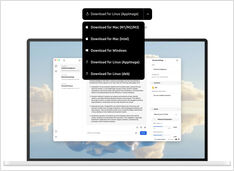

Au lieu d’appeler Copilot ou Perplexity.ai et de tout raconter au monde, vous pouvez maintenant héberger un service similaire sur votre propre ordinateur ou laptop !

Pas tant d'options à choisir, mais tout de même...

Quand j’ai commencé à expérimenter avec les LLM, les interfaces utilisateur pour eux étaient en développement actif, et maintenant certaines d’entre elles sont vraiment excellentes.

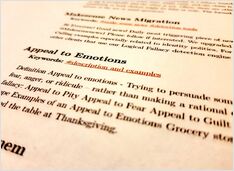

Test de détection des fautes de raisonnement

Récemment, nous avons vu plusieurs nouveaux LLM sortir. Des temps excitants. Testons-les et voyons comment ils se débrouillent lorsqu’ils détectent les fautes logiques.

Exige quelques expérimentations mais

Il existe toutefois quelques approches courantes pour rédiger des prompts efficaces afin que le modèle de langage ne se confonde pas en tentant de comprendre ce que vous souhaitez.

« 8 versions de llama3 (Meta+) et 5 versions de phi3 (Microsoft) »

Testons comment les modèles avec différents nombres de paramètres et de quantification se comportent.

Les fichiers de modèles LLM d'Ollama prennent beaucoup de place.

Après avoir installé ollama, il est préférable de reconfigurer ollama pour qu’ils soient stockés dans un nouvel emplacement dès maintenant. Ainsi, après avoir tiré un nouveau modèle, il ne sera pas téléchargé vers l’ancien emplacement.

Testons la vitesse des LLM sur GPU vs CPU

Comparaison de la vitesse de prédiction de plusieurs versions de LLMs : llama3 (Meta/Facebook), phi3 (Microsoft), gemma (Google), mistral (open source) sur CPU et GPU.

Testons la qualité de détection des fautes logiques de différents LLMs

Ici, je compare plusieurs versions de LLM : Llama3 (Meta), Phi3 (Microsoft), Gemma (Google), Mistral Nemo (Mistral AI) et Qwen (Alibaba).