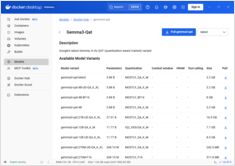

Infrastructure IA sur du matériel grand public

Déployez une IA d'entreprise sur du matériel abordable avec des modèles ouverts.

La démocratisation de l’IA est arrivée. Avec des LLM open-source comme Llama, Mistral et Qwen qui rivalisent désormais avec les modèles propriétaires, les équipes peuvent construire une puissante infrastructure IA utilisant du matériel grand public - réduisant les coûts tout en conservant un contrôle total sur la confidentialité des données et le déploiement.