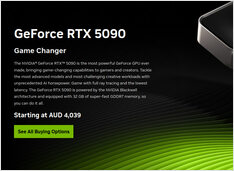

O Surgimento de ASICs para LLM: Por que o Hardware de Inferência Importa

Chipsets especializados estão tornando a inferência de IA mais rápida e barata.

O futuro do IA não é apenas sobre modelos mais inteligentes modelos — é sobre silício mais inteligente.

Hardware especializado para inferência de LLM está impulsionando uma revolução semelhante à mudança do mineração de Bitcoin para ASICs.