Fluxテキストto画像AIモデル

テキストから画像を生成する画期的な新しいAIモデル

最近、ブラックフォレスト・ラボズは一連のテキストから画像を生成するAIモデルを公開しました。これらのモデルは、出力品質が非常に高いとされています。試してみましょう

テキストから画像を生成する画期的な新しいAIモデル

最近、ブラックフォレスト・ラボズは一連のテキストから画像を生成するAIモデルを公開しました。これらのモデルは、出力品質が非常に高いとされています。試してみましょう

2つのセルフホスト型AI検索エンジンの比較

美味しい料理は目にも楽しめます。 しかし、本記事ではAIに基づく2つの検索システム、FarfalleとPerplexicaを比較します。

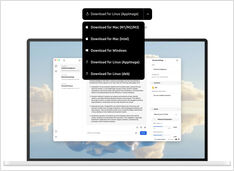

ローカルでCopilotスタイルのサービスを実行する?簡単!

とてもエキサイティングですね!

CopilotやPerplexity.aiに頼って、世界中に自分の目的を明かす代わりに、今や自らのPCや高性能なノートPC上で同様のサービスをホストできるようになりました!

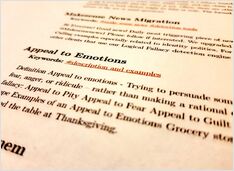

論理的誤謬の検出のテスト

最近、いくつかの新しいLLMがリリースされました。

非常にエキサイティングな時代です。

論理的誤謬の検出能力を確認するためにテストしてみましょう。

選択肢は多くないが、それでも……。

LLM(大規模言語モデル)のUI(ユーザーインターフェース)に初めて触れた時、それらは積極的に開発中で、今ではいくつかは本当に優れたものとなっています。

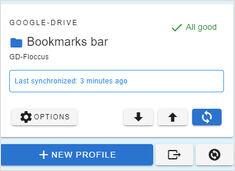

ラップトップとブラウザ間でブックマークを同期していますか?

さまざまなツールを試してきて、その中でもfloccusが最も気に入っていると結論付けました。

ラベリングとトレーニングには、ある程度の接着が必要です。

以前に オブジェクト検出AIのトレーニング を行った際、LabelImgは非常に役立つツールでしたが、 Label StudioからCOCOフォーマットへのエクスポートは MMDetectionフレームワークで受け入れられていませんでした。

8つのllama3(Meta+)および5つのphi3(Microsoft)LLMバージョン

パラメータ数や量子化の異なるモデルの挙動をテストしています。

OllamaのLLMモデルファイルは多くのスペースを占めます。

ollamaをインストールした後は、すぐにOllamaを再構成して、新しい場所にモデルを保存するように設定するのが良いでしょう。そうすることで、新しいモデルをプルした際にも、古い場所にダウンロードされません。

すべての広告を見るのは本当にうんざりです。

ブラウザの広告ブロッカーのプラグインやアドオンを、Google Chrome、Firefox、Safariなどにインストールできますが、それぞれのデバイスごとにこの操作を行う必要があります。ネットワーク全体で広告をブロックする方法が、私の最もお気に入りの解決策です。

さまざまなLLMの論理的誤謬検出の質をテストしましょう

ここではいくつかのLLMバージョンを比較しています:Llama3(Meta)、Phi3(Microsoft)、Gemma(Google)、Mistral Nemo(Mistral AI)、Qwen(Alibaba)。

これらの困難な時代には、何が起こるかわかりません。

k8sでコンテナレジストリを使用するには、SSL経由でアクセスする必要があります。

私たちは、セキュアで使いやすいコンテナレジストリをホストしたいと考えています。Dockerイメージをそこにプッシュし、Kubernetesクラスターがこのレジストリからイメージをプルできるようにしたいのです。

そのため、SSLを介してGiteaを使用するというアイデアが浮かびました。

優れたオープンソースのGitサーバーを選ぶのは難しいです

プロジェクトをオープンクラウドのGitプロバイダーから移行し、ローカルで内部のGitサーバーを自社でホストすることを検討していますか?

役に立つ Hugo コマンドパラメータ

Hugoは静的ウェブサイトジェネレータです。マークアップ、テーマを使用してHTMLを作成し、ウェブサイトを整理するのに役立ちます。

例: このテクノロジーブログ。

最も役立つHugoコマンドとそのパラメータのリストはこちらです:

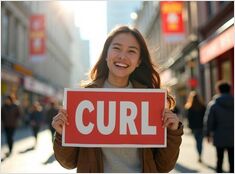

パラメータ付きの cUrl 有用コマンド

以下が最も有用な cURL コマンド のパラメータを含むチートシートです。