GNOME Boxes: 特徴、利点、課題、および代替ソフトウェアに関する包括的なガイド

GNOME Boxes による Linux 用のシンプルな仮想マシン管理

現代のコンピューティング環境において、仮想化は開発、テスト、複数のオペレーティングシステムの実行において不可欠となっています。Linuxユーザーが仮想マシンを簡単に管理できる方法を探している場合、GNOME Boxesは、機能性を犠牲にすることなく、軽量で使いやすいオプションとして際立っています。

GNOME Boxes による Linux 用のシンプルな仮想マシン管理

現代のコンピューティング環境において、仮想化は開発、テスト、複数のオペレーティングシステムの実行において不可欠となっています。Linuxユーザーが仮想マシンを簡単に管理できる方法を探している場合、GNOME Boxesは、機能性を犠牲にすることなく、軽量で使いやすいオプションとして際立っています。

専用チップにより、AIの推論がより高速かつ低コストになっている。

6 カ国における実勢価格、Mac Studio との比較、および入手可能性について。

NVIDIA DGX Spark は実在する製品で、2025 年 10 月 15 日から販売開始されます。統合された NVIDIA AI スタック を利用して、ローカルでの LLM 作業 が必要な CUDA 開発者を主なターゲットとしています。米国での MSRP は 3,999 ドル です。英国・ドイツ・日本 での小売価格は、VAT(消費税)や流通チャネルの事情により高くなります。オーストラリアドル (AUD) や韓国ウォン (KRW) の公開価格はまだ広く発表されていません。

AI 向けコンシューマー GPU の価格 – RTX 5080 と RTX 5090

LLM や AI 一般に特に適した、トップクラスの消費向け GPU の価格を比較してみましょう。 具体的には、RTX-5080 と RTX-5090 の価格 を見ていきます。 価格はわずかに下落しています。

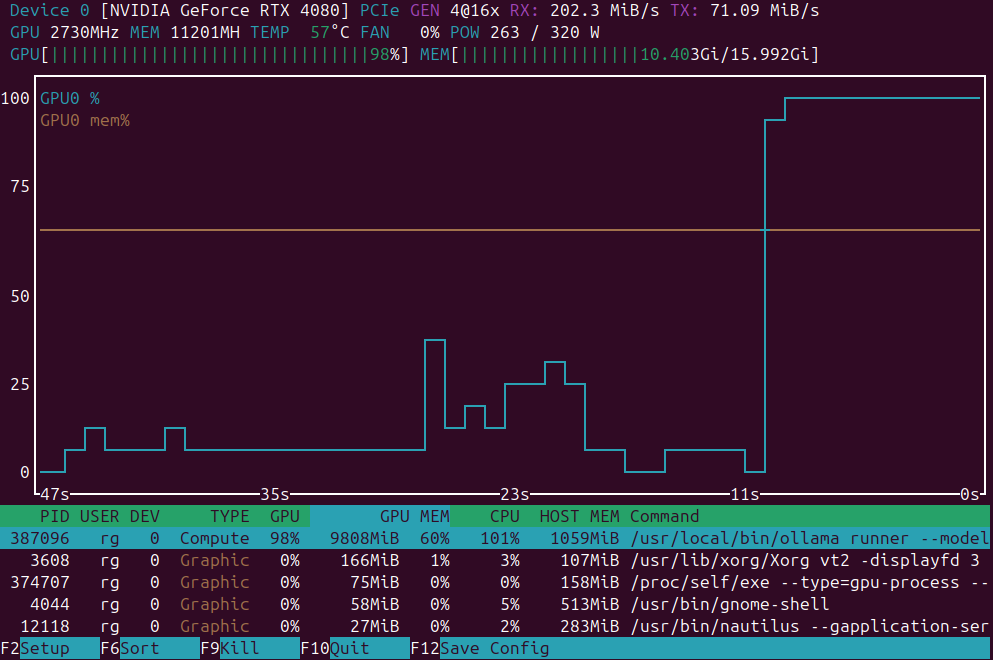

GPU負荷監視用のアプリケーションの簡単な一覧

GPU負荷監視アプリケーション: nvidia-smi vs nvtop vs nvitop vs KDE plasma systemmonitor.

2025 年 7 月にもまもなく利用可能となるでしょう。

Nvidia 社がNVIDIA DGX Sparkの発売を控えています。これは Blackwell アーキテクチャを採用した小型 AI スーパーコンピュータで、128GB 以上の統一メモリと 1 PFLOPS の AI 性能を備えています。LLM を実行するに最適なデバイスです。

AI 向け GPU 価格の更新 - RTX 5080 と RTX 5090

特に大規模言語モデル(LLM)および AI 全般に適したトップクラスのコンシューマー向け GPU の価格を比較しましょう。 特にRTX 5080 と RTX 5090 の価格 を見てみましょう。少し価格が下がっています。

価格の現実確認 - RTX 5080 と RTX 5090

わずか 3 ヶ月前まで、店舗で RTX 5090 を見かけることはありませんでした。しかし今や、その姿を見ることができます。ただし、価格はメーカー希望小売価格(MRSP)よりわずかに高くなっています。 オーストラリアにおける RTX 5080 と RTX 5090 の最安価格を比較して、その推移を見てみましょう。オーストラリアの RTX 5080 と RTX 5090 の価格

比較のために、以下の記事もご覧ください。オーストラリアの RTX 5080 と RTX 5090 の価格 - 2025 年 7 月、2025 年 10 月、2025 年 11 月。

メモリ容量は増え、消費電力は減っても、依然として高価です。

いくつかの素晴らしい仕事のためのトップ自動システム。

LLM用に2番目のGPUをインストールすることを考慮していますか?

PCIe レーンがLLM性能に与える影響? タスクによります。トレーニングやマルチGPUの推論では、パフォーマンスの低下が顕著です。

ではなぜこのBSODを目にしてきたのか...

この問題に強く打たれました。しかし、あなたのブルースクリーン(BSOD)が私のものと似ている場合は、PCを調査し、テストすることをお勧めします。原因はインテルの13世代および14世代CPU劣化問題でした。

インテルCPUにおけるOllamaの効率的なコアとパフォーマンスコアの比較

私はある仮説をテストしたいと思っています。すなわち、「インテルCPUのすべてのコアを活用することで、LLMの速度が向上するか?」というものです。このテストについては、ALL cores on Intel CPU would raise the speed of LLMs?をご覧ください。

新しいgemma3 27bitモデル(gemma3:27b、ollama上では17GB)が私のGPUの16GB VRAMに収まらず、部分的にCPU上での実行に頼っているという点が気になります。

AIは多くのパワーが必要です…

現代の世界の混乱の中でも、ここではさまざまなカードのテクスペックを比較、AIタスクに適したAI用のカードについて見ていく。

(Deep Learning、

Object Detection、

およびLLMs)。

しかし、これらはすべて非常に高価です。

オラマを並列リクエストの実行に設定する。

Ollama サーバーが同時に2つのリクエストを受け取った場合、その動作は設定と利用可能なシステムリソースに依存します。

古いプリンタードライバと比べてはるかに簡単です

ET-8500をWindowsにインストールする方法は、マニュアルに詳細に記載されています。ET-8500 Linuxドライバのインストールは簡単ですが、簡単ではありません。このガイドは、2026年のドキュメントツール: Markdown、LaTeX、PDFおよび印刷ワークフロー ハブの一部です。

LLMのGPUとCPUでの速度をテストしてみましょう

いくつかのLLM(大規模言語モデル)のバージョン(llama3(メタ/Facebook)、phi3(マイクロソフト)、gemma(グーグル)、mistral(オープンソース))におけるCPUおよびGPUでの予測速度の比較。