RAGにおけるチャンキング戦略の比較:代替案、トレードオフ、および例

RAGにおけるチャンキング戦略の比較

Chunking は、Retrieval ‑ Augmented Generation (RAG) において 最も過小評価されている ハイパラメータです。

静かに、LLM が「何を見ているか」を決定し、インジェストのコストをどのくらい高めるか、そしてLLMのコンテキストウィンドウがどのくらい使われるかを決めています。

RAGにおけるチャンキング戦略の比較

Chunking は、Retrieval ‑ Augmented Generation (RAG) において 最も過小評価されている ハイパラメータです。

静かに、LLM が「何を見ているか」を決定し、インジェストのコストをどのくらい高めるか、そしてLLMのコンテキストウィンドウがどのくらい使われるかを決めています。

セルフホストされたLLMでデータとモデルを制御する

LLMを自社でホストすることで、データ、モデル、推論を自らの管理下に置くことができます。これは、チームや企業、国家にとっても実用的な**AI主権**への道です。

RTX 4080(16GB VRAM)でのLLM速度テスト

大規模言語モデルをローカルで実行すると、プライバシーの確保、オフラインでの使用が可能になり、APIコストはゼロになります。このベンチマークでは、RTX 4080上で動作する14のポピュラーなLLMs on Ollamaから期待できる性能が明らかになります。

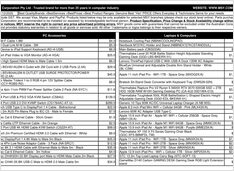

2025年1月GPUおよびRAM価格チェック

今日、トップレベルの消費者向けGPUとRAMモジュールについて見てみましょう。

特に注目しているのは、RTX-5080およびRTX-5090の価格と、32GB(2x16GB)DDR5 6000です。

正しいターミナルを選んでLinuxワークフローを最適化しましょう

Linuxユーザーにとって最も重要なツールの一つは、端末エミュレータです。https://www.glukhov.org/ja/developer-tools/terminals-shell/terminal-emulators-for-linux-comparison/ “Linux端末エミュレータ比較”

オーストラリアの小売業者から、リアルなオーストラリアドルでの価格を今すぐ。

NVIDIA DGX Spark (GB10 Grace Blackwell) は、主要な PC 小売店に国内在庫があり、オーストラリアで入手可能 となっています。 世界的な DGX Spark の価格と入手性 を追いかけていただいている方なら、オーストラリアでの価格帯はストレージ構成や小売店によって 6,249 オーストラリアドルから 7,999 オーストラリアドル であることが、ご関心をお持ちいただけるでしょう。

ローカルLLMを使用してCogneeをテストする - 実際の結果

CogneeはPythonフレームワークで、LLMを使用してドキュメントから知識グラフを構築します。 しかし、これはセルフホストされたモデルと互換性がありますか?

Ubuntuでネットワークの問題を解決した方法

新しいカーネルを自動インストールした後、Ubuntu 24.04でイーサネットネットワークが失われたという問題が発生しました。この面倒な問題は私にとって2度目だったので、同じ問題に直面している他の人々の助けになるよう、ここに解決策を記録しています。

短い投稿ですが、価格についてのみ記載します。

この狂気じみた RAM 価格のボラティリティ について、全体像を把握し、より明確なイメージを持つために、まずは私たちが オーストラリアの RAM 価格を追跡 してみましょう。

AI 需要による供給圧迫で、メモリ価格が 163〜619% 急騰

2025 年後半、メモリ市場は前例のない価格変動に直面しており、すべてのセグメントにおいて RAM 価格の高騰 が顕著です。

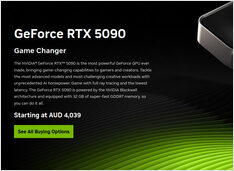

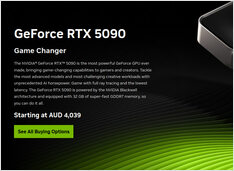

AI 向けコンシューマー GPU の価格 - RTX 5080 および RTX 5090

特に LLM や AI 全般に適した、上位の消費者向け GPU の価格を比較してみましょう。 具体的には、RTX-5080 と RTX-5090 の価格 に注目しています。

オープンモデルを活用して、予算内のハードウェアでエンタープライズAIをデプロイする

AI の民主化はここにやってきました。 Llama、Mistral、Qwen などのオープンソース大規模言語モデル(LLM)が現在、プロプライエタリなモデルと競合するレベルに達しており、チームは 消費级ハードウェアを使用した AI インフラストラクチャ を構築することで、コストを削減しながらもデータプライバシーとデプロイの完全な制御を維持することが可能になりました。

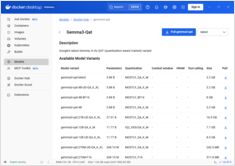

NVIDIA CUDAをサポートしたDocker Model RunnerでGPU加速を有効にする

Docker Model Runner は、Dockerが公式に提供するローカルでAIモデルを実行するためのツールですが、

Docker Model RunnerにおけるNVidia GPUの加速の有効化 には特定の設定が必要です。

GPT-OSS 120bの3つのAIプラットフォームにおけるベンチマーク

私は、Ollama上でGPT-OSS 120bのパフォーマンステストを3つの異なるプラットフォームで確認しました:NVIDIA DGX Spark, Mac Studio, and RTX 4080。OllamaライブラリのGPT-OSS 120bモデルは65GBあり、これはRTX 4080(または新しいRTX 5080の16GB VRAMには収まらないことを意味します。

Docker Model Runner コマンドのクイックリファレンス

Docker Model Runner (DMR) は、2025年4月に導入された Docker の公式ソリューションで、AIモデルをローカルで実行するためのものです。このチートシートでは、すべての必須コマンド、構成、およびベストプラクティスのクイックリファレンスを提供しています。