PythonでMCPサーバーを構築する:ウェブ検索とスクレイピングガイド

Pythonの例を使ってAIアシスタント用のMCPサーバーを構築する

モデルコンテキストプロトコル(MCP)は、AIアシスタントが外部データソースやツールとどのように相互作用するかを革命的に変えてきました。本ガイドでは、ウェブ検索およびスクレイピング機能に焦点を当てた例を用いて、MCPサーバーをPythonで構築する方法について説明します。

Pythonの例を使ってAIアシスタント用のMCPサーバーを構築する

モデルコンテキストプロトコル(MCP)は、AIアシスタントが外部データソースやツールとどのように相互作用するかを革命的に変えてきました。本ガイドでは、ウェブ検索およびスクレイピング機能に焦点を当てた例を用いて、MCPサーバーをPythonで構築する方法について説明します。

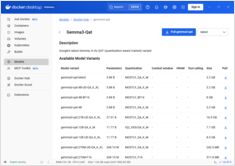

Docker Model Runner コマンドのクイックリファレンス

Docker Model Runner (DMR) は、2025年4月に導入された Docker の公式ソリューションで、AIモデルをローカルで実行するためのものです。このチートシートでは、すべての必須コマンド、構成、およびベストプラクティスのクイックリファレンスを提供しています。

Docker Model RunnerとOllamaを比較してみる:ローカルLLM向け

ローカルで大規模言語モデル(LLM)を実行する は、プライバシー、コスト管理、オフライン機能のためにますます人気になってきています。 2025年4月にDockerが**Docker Model Runner (DMR)**を導入し、AIモデルの展開用の公式ソリューションとして登場したことで、状況は大きく変わりました。

ステップバイステップの例

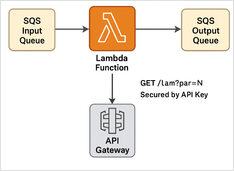

ここに、Python LambdaのSQSメッセージプロセッサの例 + REST APIとAPIキー保護 + Terraformスクリプトがあり、サーバーレス実行のためにそれをデプロイします。

+ 思考型LLMを使用した具体的な例

この投稿では、PythonアプリケーションをOllamaに接続する2つの方法について紹介します。1つ目はHTTP REST APIを使用する方法、2つ目は公式のOllama Pythonライブラリを使用する方法です。

わずかに異なるAPIには特別なアプローチが必要です。

以下は、提供されたHugoページコンテンツの日本語への翻訳です。すべてのHugoショートコードと技術要素は正確に保持されており、日本語の文法、表記、文化に合った表現が使用されています。

以下は、構造化された出力(信頼性の高いJSONを取得)をサポートする、人気のあるLLMプロバイダーの比較、および最小限のPythonの例です。