Ollama GPT-OSS 構造化された出力の問題

あまり良くない。

OllamaのGPT-OSSモデルは、LangChainやOpenAI SDK、vllmなどのフレームワークと使用する際に、構造化された出力を処理する際に繰り返し問題が発生しています。

あまり良くない。

OllamaのGPT-OSSモデルは、LangChainやOpenAI SDK、vllmなどのフレームワークと使用する際に、構造化された出力を処理する際に繰り返し問題が発生しています。

Ollamaから構造化された出力を得るいくつかの方法

大規模言語モデル(LLM) は強力ですが、実運用では自由な形式の段落はほとんど使いません。 代わりに、予測可能なデータ:属性、事実、またはアプリにフィードできる構造化されたオブジェクトを望みます。 それはLLM構造化出力です。

オラマモデルのスケジューリングに関する自分のテスト

ここでは、新しいバージョンのOllamaがモデルに対してどのくらいのVRAMを割り当てているかについて、Ollama VRAM割り当てと以前のOllamaバージョンを比較しています。新しいバージョンは、以前のバージョンよりも劣っています。

現在のOllama開発状況に対する私の見解

Ollama は、LLM をローカルで実行するためのツールとして、非常に人気のあるツールの一つとなっています。

シンプルな CLI と、モデル管理の簡素化により、クラウド外で AI モデルと仕事をしたい開発者にとっての定番のオプションとなっています。

2025年のOllamaで最も注目されているUIの概要

ローカルにホストされた Ollama は、あなたのマシン上で大規模言語モデルを実行できるが、コマンドライン経由での使用はユーザーにとって使いにくい。

以下に、ローカルの Ollama に接続するための、いくつかのオープンソースプロジェクトが提供する ChatGPTスタイルのインターフェース がある。

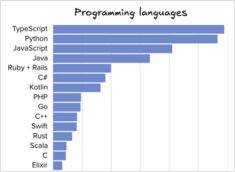

ソフトウェアエンジニアリングツールおよび言語の比較

The Pragmatic Engineerのレターは数日前に、2025年中盤におけるプログラミング言語、IDE、AIツールの普及状況などのデータを掲載しました。

2025 年 7 月にもまもなく利用可能となるでしょう。

Nvidia 社がNVIDIA DGX Sparkの発売を控えています。これは Blackwell アーキテクチャを採用した小型 AI スーパーコンピュータで、128GB 以上の統一メモリと 1 PFLOPS の AI 性能を備えています。LLM を実行するに最適なデバイスです。

RAG を実装中ですか?Go のコードスニペットを紹介 - 2 部目

標準の Ollama には直接的なリランク API がないため、クエリ - ドキュメントペアのエンベッディングを生成してスコアリングを行うことで、Go 言語による Qwen3 Reranker を使ったリランキング を実装する必要があります。

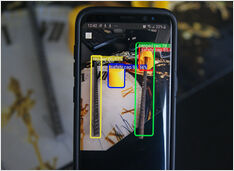

以前、オブジェクト検出AIのトレーニングを行いました。

ある寒い冬の7月の日… その日はオーストラリアにいた… 私は、未封のコンクリート補強筋を検出するためのAIモデルを訓練するという緊急の必要性を感じた…

Qwen3 8B、14Bおよび30B、Devstral 24B、Mistral Small 24B

このテストでは、Ollama上でホストされているさまざまなLLMがHugoページを英語からドイツ語に翻訳する方法を比較しています。英語からドイツ語への翻訳。

RAG の実装ですね。Golang 用のコードスニペットをいくつか紹介します。

この小さな Reranking Go コード例は、クエリと各候補ドキュメントの埋め込みを生成するために Ollama を呼び出し、 その後、コサイン類似度で降順にソートします。

LLM用に2番目のGPUをインストールすることを考慮していますか?

PCIe レーンがLLM性能に与える影響? タスクによります。トレーニングやマルチGPUの推論では、パフォーマンスの低下が顕著です。

LLMでHTMLからテキストを抽出する...

Ollama モデルライブラリには、HTML コンテンツを Markdown に変換できるモデルが存在します。これはコンテンツ変換タスクに役立ちます。このガイドは、2026年のドキュメンテーションツール: Markdown、LaTeX、PDFおよび印刷ワークフロー ハブの一部です。

あなたのタスクに適した AI 研究モードはどれですか?

Cursor AI vs GitHub Copilot vs Cline AI vs...

ここに、AI 支援コーディングツールと AI コーディングアシスタント の良い点についていくつかリストアップします。

LLMプロバイダーの短いリスト

LLMを使用することは非常に高価ではありません。新しい高性能なGPUを購入する必要がないかもしれません。LLMプロバイダーの一覧は、クラウド上のLLMプロバイダー で確認できます。それぞれが提供しているLLMについても記載されています。