LLMの要約能力の比較

8つのllama3(Meta+)および5つのphi3(Microsoft)LLMバージョン

パラメータ数や量子化の異なるモデルの挙動をテストしています。

8つのllama3(Meta+)および5つのphi3(Microsoft)LLMバージョン

パラメータ数や量子化の異なるモデルの挙動をテストしています。

Ollama の LLM モデルファイルは非常に多くのディスク領域を占有します。

ollama のインストール 後、すぐに Ollama を再設定して、新しい場所にモデルを保存するようにするのが良いでしょう。そうすれば、新しいモデルをプルした際に、古い場所にダウンロードされなくなります。

すべての広告を見るのは本当にうんざりです。

ブラウザの広告ブロッカーのプラグインやアドオンを、Google Chrome、Firefox、Safariなどにインストールできますが、それぞれのデバイスごとにこの操作を行う必要があります。ネットワーク全体で広告をブロックする方法が、私の最もお気に入りの解決策です。

非常に頻繁に表示されるエラーメッセージ...

gitリポジトリをクローンした後は、ローカルリポジトリの設定を行います。特にユーザー名とメールアドレスを設定してください。

Hugo は静的サイトジェネレーターです。

Hugo を使用してサイトを生成したら、次にホスティングプラットフォームへのデプロイが必要です。 ここでは、AWS S3 にプッシュし、AWS CloudFront CDN で配信する方法について解説します。

LLMのGPUとCPUでの速度をテストしてみましょう

いくつかのLLM(大規模言語モデル)のバージョン(llama3(メタ/Facebook)、phi3(マイクロソフト)、gemma(グーグル)、mistral(オープンソース))におけるCPUおよびGPUでの予測速度の比較。

さまざまなLLMの論理的誤謬検出の質をテストしましょう

ここではいくつかのLLMバージョンを比較しています:Llama3(Meta)、Phi3(Microsoft)、Gemma(Google)、Mistral Nemo(Mistral AI)、Qwen(Alibaba)。

これらの困難な時代には、何が起こるかわかりません。

ときどき、ただその場所にアイテムを追加するだけで済みます...

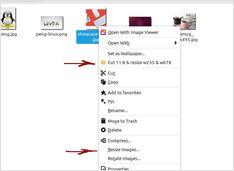

このブログの画像をトリミングし、リサイズし、境界線を追加する作業は、Linux Mint Cinnamonのコンテキストメニューにこの頻繁に使用される機能を追加するきっかけとなりました。

寒い冬の夜に、これほど心温まるものはありません。

この飲み物は「グリントワイン」として知られていますが、英語ではよりよく「ホットワイン」と呼ばれます。

結構多くの材料があり、独自の味わいがあります。大好きです!

一部ツールのコマンドラインパラメータ

非常に網羅的なリストではありませんが、私自身にとって有用な項目をいくつかまとめました

k8sでコンテナレジストリを使用するには、SSL経由でアクセスする必要があります。

私たちは、セキュアで使いやすいコンテナレジストリをホストしたいと考えています。Dockerイメージをそこにプッシュし、Kubernetesクラスターがこのレジストリからイメージをプルできるようにしたいのです。

そのため、SSLを介してGiteaを使用するというアイデアが浮かびました。

優れたオープンソースのGitサーバーを選ぶのは難しいです

プロジェクトをオープンクラウドのGitプロバイダーから移行し、ローカルで内部のGitサーバーを自社でホストすることを検討していますか?

私はi2pをテストしてみた。

動作は可能ですが、パフォーマンス、匿名性、信頼性については非常に疑問が残ります…

静的サイトに合わせて自動で画像サイズを調整する

Mainroad テーマは Hugo で使用する際、画像を自動でリサイズしない。 just copies from static folder に記載されているように、静的フォルダからコピーするだけである。 そのため、適切なサイズにリサイズおよびクロップするスクリプトを準備する必要がある。

メインロードにおけるハーゴ画像の詳細、種類とサイズ

システム、インフラ、AIエンジニアリングの新記事をお届けします。