PostgreSQL フルテキスト検索と Elasticsearch の比較

1 つのデータベースか、本物の検索スタックか

本当の議論の焦点は、PostgreSQL がテキスト検索できるかどうか、あるいは Elasticsearch がドキュメントを保存できるかどうかではありません。両者とも可能です。興味深いのは、検索の複雑性がどこに存在すべきかという点です。

1 つのデータベースか、本物の検索スタックか

本当の議論の焦点は、PostgreSQL がテキスト検索できるかどうか、あるいは Elasticsearch がドキュメントを保存できるかどうかではありません。両者とも可能です。興味深いのは、検索の複雑性がどこに存在すべきかという点です。

アラートは、ノイズシステムではなく、対応システムです。

アラート(通知)は、監視機能として説明されることがあまりにも多い。 その枠組みは便利だが、真の問題を隠蔽してしまう。

システム制御プレーンとしてのチャットプラットフォーム

チャットプラットフォームは、単なるメッセージングツールを超えて大きく進化しました。 現代のシステムでは、これらは自動化プロセスと人間の意思決定の間をつなぐインターフェースとして機能しています。

Discord を安全でインタラクティブなアラートバスに変えましょう。

Discord をシステムとして扱う場合、イベントを公開する場所、人間が意思決定を行い、自動化がワークフローを継続させる場として扱うことで、本格的な統合の土台となります。

Slack はワークフロー UI およびアラート配信レイヤーです。

Slack の統合は、1 つの HTTP コールでメッセージを送信できるため、欺瞞的に簡単に見えるかもしれません。 しかし、Slack を対話的で信頼性の高いものにする必要が出てきた時が、本物の面白い部分です。

統合、コード構造、データアクセスのパターン。

多くのアプリアーキテクチャのアドバイスは、適用するには抽象的すぎるか、スケールするには狭すぎるかのどちらかです。 ここでは、統合、コード構造、データアクセスにわたる本番環境システム向けの実践的なトレードオフを紹介します。

Claudeのサブスクリプションはエージェントの稼働に使用されなくなりました

エージェント実験の波を後押ししていた静かな抜け穴は、今、閉じられました。

ローカル LLM を活用したセルフホスティング AI 検索

Vane は、「出典付き AI 検索」領域において、より実用的な選択肢の一つです。これは、リアルタイムのウェブ取得とローカルまたはクラウド上の LLM(大規模言語モデル)を組み合わせた、セルフホスティング可能な回答エンジンであり、スタック全体をユーザーの管理下に置くことができます。

ローカルモデルバックエンドに対応したエージェンティックコーディング

Claude Codeは、マーケティングが上手な自動補完ツールではありません。これはエージェント型コーディングツールです。コードベースを読み取り、ファイルを編集し、コマンドを実行し、開発ツールと統合します。

Hermes Agentのインストールと開発者向けクイックスタート

Hermes Agent(ヘルメスエージェント)は、ローカルマシンや低コストのVPSで動作するセルフホスト型でモデル非依存のAIアシスタントです。ターミナルおよびメッセージングインターフェースを介して動作し、繰り返し行われるタスクを再利用可能なスキルに変換することで、時間とともに性能を向上させていきます。

TGI をインストールし、迅速にデプロイ、さらに高速にデバッグ。

Text Generation Inference (TGI) は、非常に特有の雰囲気を持っています。 推論の分野で最も新しい子供ではありませんが、すでに本番環境でのトラブルを学び、その教訓をデフォルト設定に焼き付けているのが TGI です。

llama.cpp の 16 GB VRAM におけるトークン生成速度(表)。

ここでは、VRAM 16GB の GPU で動作するいくつかの LLM の速度を比較し、セルフホスティングに最適なモデルを選定しています。

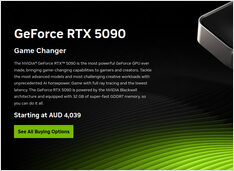

オーストラリアではRTX 5090は供給不足であり、価格が高騰しています。

オーストラリアにはRTX 5090の在庫があります。 ただし、ごくわずかです。 もし見つけたとしても、現実感の欠けた、莫大なプレミアム価格を支払わなければなりません。

公開ポートを使用しないリモート Ollama アクセス

Ollama は、ローカルデーモンとして扱われるときに最も快適に動作します。CLI とアプリケーションがループバック HTTP API と通信し、残りのネットワークにはその存在が知られない状態です。

トレースと連携可能なクエリ可能な JSON ログ。

ログは、システムが炎上している状況でも使用できるデバッグインターフェースです。 問題となるのは、プレーンテキストのログは古くなりやすいという点です。フィルタリング、集計、アラートが必要になった瞬間、文章をパースし始めることになります。

GPU および永続性を備えた Compose ファーストの Ollama サーバー。

Ollama は、メタル(物理マシン)上で非常に良好に動作します。それをサービスとして扱うと、さらに興味深くなります。安定したエンドポイント、固定されたバージョン、永続的なストレージ、そして GPU が利用可能か不可かの明確な状態が確保されます。

システム、インフラ、AIエンジニアリングの新記事をお届けします。