Ollamaを使用したPerplexicaのセルフホスティング

ローカルでCopilotスタイルのサービスを実行する?簡単!

とてもエキサイティングですね!

CopilotやPerplexity.aiに頼って、世界中に自分の目的を明かす代わりに、今や自らのPCや高性能なノートPC上で同様のサービスをホストできるようになりました!

ローカルでCopilotスタイルのサービスを実行する?簡単!

とてもエキサイティングですね!

CopilotやPerplexity.aiに頼って、世界中に自分の目的を明かす代わりに、今や自らのPCや高性能なノートPC上で同様のサービスをホストできるようになりました!

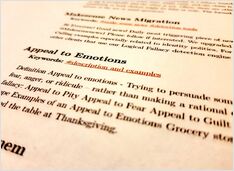

論理的誤謬の検出のテスト

最近、いくつかの新しいLLMがリリースされました。

非常にエキサイティングな時代です。

論理的誤謬の検出能力を確認するためにテストしてみましょう。

いくつかの試行錯誤が必要ですが、

まだ、LLMがあなたの意図を理解しようとする際に混乱しないようにするための、良いプロンプトを書くためのいくつかの一般的なアプローチがあります。

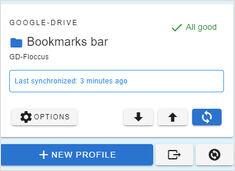

ラップトップとブラウザ間でブックマークを同期していますか?

さまざまなツールを試してきて、その中でもfloccusが最も気に入っていると結論付けました。

よく使用されるPythonコードの断片

時折必要になるが、すぐに見つからないことがある。

そのため、ここにすべてを保存しておく。

ラベリングとトレーニングには、ある程度の接着が必要です。

以前に オブジェクト検出AIのトレーニング を行った際、LabelImgは非常に役立つツールでしたが、 Label StudioからCOCOフォーマットへのエクスポートは MMDetectionフレームワークで受け入れられていませんでした。

8つのllama3(Meta+)および5つのphi3(Microsoft)LLMバージョン

パラメータ数や量子化の異なるモデルの挙動をテストしています。

OllamaのLLMモデルファイルは多くのスペースを占めます。

ollamaをインストールした後は、すぐにOllamaを再構成して、新しい場所にモデルを保存するように設定するのが良いでしょう。そうすることで、新しいモデルをプルした際にも、古い場所にダウンロードされません。

すべての広告を見るのは本当にうんざりです。

ブラウザの広告ブロッカーのプラグインやアドオンを、Google Chrome、Firefox、Safariなどにインストールできますが、それぞれのデバイスごとにこの操作を行う必要があります。ネットワーク全体で広告をブロックする方法が、私の最もお気に入りの解決策です。

非常に頻繁に表示されるエラーメッセージ...

gitリポジトリをクローンした後は、ローカルリポジトリの設定を行います。特にユーザー名とメールアドレスを設定してください。

LLMのGPUとCPUでの速度をテストしてみましょう

いくつかのLLM(大規模言語モデル)のバージョン(llama3(メタ/Facebook)、phi3(マイクロソフト)、gemma(グーグル)、mistral(オープンソース))におけるCPUおよびGPUでの予測速度の比較。

さまざまなLLMの論理的誤謬検出の質をテストしましょう

ここではいくつかのLLMバージョンを比較しています:Llama3(Meta)、Phi3(Microsoft)、Gemma(Google)、Mistral Nemo(Mistral AI)、Qwen(Alibaba)。

これらの困難な時代には、何が起こるかわかりません。

ときどき、ただその場所にアイテムを追加するだけで済みます...

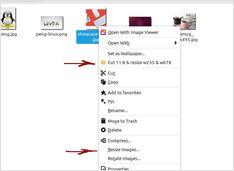

このブログの画像をトリミングし、リサイズし、境界線を追加する作業は、Linux Mint Cinnamonのコンテキストメニューにこの頻繁に使用される機能を追加するきっかけとなりました。

寒い冬の夜に、これほど心温まるものはありません。

この飲み物は「グリントワイン」として知られていますが、英語ではよりよく「ホットワイン」と呼ばれます。

結構多くの材料があり、独自の味わいがあります。大好きです!

いくつかのツールのコマンドラインパラメータ

非常に包括的なリストではありませんが、私にとって役に立ついくつかの項目です