Tutoriel sur la génération augmentée par récupération (RAG) : architecture, mise en œuvre et guide de production

Du RAG de base à la production : découpage, recherche vectorielle, ré-ranking et évaluation, le tout dans un guide.

Ce tutoriel sur la Génération Augmentée par Récupération (RAG) est un guide étape par étape, axé sur la production, pour construire des systèmes RAG réels.

Si vous recherchez :

- Comment construire un système RAG

- Explication de l’architecture RAG

- Tutoriel RAG avec exemples

- Comment implémenter RAG avec des bases de données vectorielles

- RAG avec reranking (réordonnancement)

- RAG avec recherche web

- Meilleures pratiques de production pour RAG

Vous êtes au bon endroit.

Ce guide consolide les connaissances pratiques d’implémentation RAG, les modèles architecturaux et les techniques d’optimisation utilisés dans les systèmes d’IA en production.

Carte du cluster RAG (À lire dans l’ordre)

Si vous souhaitez le chemin le plus rapide à travers le cluster RAG, utilisez cette carte :

- Vous êtes ici : Vue d’ensemble RAG + pipeline de bout en bout (cette page)

- Chunking (fondation de la qualité de récupération) : Stratégies de Chunking dans RAG

- Stores vectoriels (choix de stockage et d’indexation) : Comparaison des Stores Vectoriels pour RAG

- Profondeur de récupération (quand la “recherche” ne suffit pas) : Recherche vs DeepSearch vs Recherche Approfondie

- Reranking (souvent le gain de qualité le plus important) : Reranking avec des modèles d’embedding

- Embeddings + modèles reranker (implémentations pratiques) :

- Architectures avancées : Variantes RAG avancées : LongRAG, Self-RAG, GraphRAG

Qu’est-ce que la Génération Augmentée par Récupération (RAG) ?

La Génération Augmentée par Récupération (RAG) est un modèle de conception de système qui combine :

- La récupération d’informations

- L’augmentation du contexte

- La génération par un grand modèle de langage

En termes simples, un pipeline RAG récupère des documents pertinents et les injecte dans le prompt avant que le modèle ne génère une réponse.

Contrairement au fine-tuning, RAG :

- Fonctionne avec des données fréquemment mises à jour

- Prend en charge les bases de connaissances privées

- Réduit les hallucinations

- Évite le réentraînement des grands modèles

- Améliore l’ancrage des réponses

Les systèmes RAG modernes incluent plus que la recherche vectorielle. Une implémentation RAG complète peut inclure :

- La réécriture de requêtes

- La recherche hybride (BM25 + recherche vectorielle)

- Le reranking par cross-encoder

- La récupération multi-étapes

- L’intégration de la recherche web

- L’évaluation et la surveillance

Blueprint minimal RAG de production (Implémentation de référence)

Utilisez ceci comme modèle mental (et squelette de départ) pour un RAG de production.

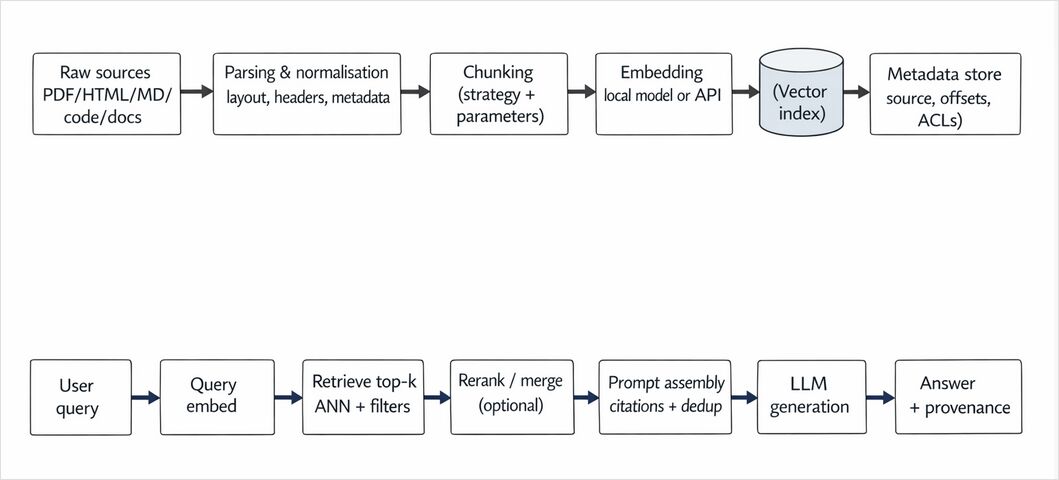

Pipeline d’ingestion (hors ligne ou continu)

- Collecter des sources (documents, tickets, pages web, PDFs, code)

- Normaliser (extraire le texte, nettoyer le contenu standard, dédoubler)

- Chunker (choisir la stratégie + chevauchement + métadonnées)

- Embarquer (embeddings versionnés)

- Upsert dans l’index (store vectoriel + champs de métadonnées)

- Stratégie de réindexation lorsque les embeddings ou le chunking changent

Pipeline de requête (en ligne)

- Parser / réécrire la requête (facultatif)

- Récupérer des candidats (vectoriel ou hybride + filtrage de métadonnées)

- Reranker le top-K avec un modèle cross-encoder / reranker

- Assembler le contexte (déduplication, ordre par pertinence, ajout de citations)

- Générer avec un prompt ancré (règles + comportement de refus)

- Journaliser (ensemble de récupération, ensemble reranké, contexte final, latence, coût)

- Évaluer (harnais en ligne/hors ligne)

Si vous n’améliorez qu’une seule chose dans un système RAG fonctionnel : ajoutez du reranking et un harnais d’évaluation.

Tutoriel RAG étape par étape : Comment construire un système RAG

Cette section décrit un flux de tutoriel RAG pratique pour les développeurs.

Étape 1 : Préparer et découper vos données

La qualité de la récupération dépend largement de la stratégie de chunking et de la conception de l’index : un bon RAG commence par un chunking approprié.

Le chunking détermine :

- Le rappel de récupération

- La latence

- Le bruit du contexte

- Le coût des tokens

- Le risque d’hallucination

Les stratégies de chunking RAG courantes incluent :

- Chunking de taille fixe

- Chunking par fenêtre glissante

- Chunking sémantique

- Chunking récursif

- Chunking hiérarchique

- Chunking conscient des métadonnées

Un mauvais chunking est l’une des causes les plus courantes de sous-performance des systèmes RAG.

Pour une plongée approfondie rigoureuse, axée sur l’ingénierie, sur les compromis du chunking, les dimensions d’évaluation, les matrices de décision et les implémentations Python exécutables, consultez :

Stratégies de Chunking dans RAG : Alternatives, Compromis et Exemples

Ce guide couvre les paramètres par défaut pratiques pour :

- Systèmes Q/R

- Pipelines de résumé

- Recherche de code

- Documents multimodaux

- Ingestion en streaming

- Documents multimodaux avec embeddings cross-modaux

Si vous prenez la performance RAG au sérieux, lisez ceci avant d’ajuster les embeddings ou le reranking.

Pour les systèmes RAG multimodaux qui font le pont entre le texte, les images et d’autres modalités, explorez Embeddings Cross-Modaux : Faire le pont entre les modalités IA

Étape 2 : Choisir une base de données vectorielle pour RAG

Une base de données vectorielle stocke les embeddings pour une recherche de similarité rapide.

Comparez les bases de données vectorielles ici :

Stores Vectoriels pour RAG - Comparaison

Lors de la sélection d’une base de données vectorielle pour un tutoriel RAG ou un système de production, considérez :

- Type d’index (HNSW, IVF, etc.)

- Support de filtrage

- Modèle de déploiement (cloud vs auto-hébergé)

- Latence de requête

- Scalabilité horizontale

- Exigences de multi-locataire et de contrôle d’accès

Étape 3 : Implémenter la récupération (Recherche vectorielle ou hybride)

La récupération RAG de base utilise la similarité des embeddings.

La récupération RAG avancée utilise :

- Recherche hybride (vectorielle + mots-clés)

- Filtrage de métadonnées

- Récupération multi-index

- Réécriture de requêtes

Pour une compréhension conceptuelle :

Recherche vs DeepSearch vs Recherche Approfondie

Comprendre la profondeur de la récupération est essentiel pour des pipelines RAG de haute qualité.

Étape 4 : Ajouter le reranking à votre pipeline RAG

Le reranking est souvent l’amélioration de qualité la plus importante dans une implémentation RAG.

Le reranking améliore :

- La précision

- La pertinence du contexte

- La fidélité

- Le rapport signal/bruit

Apprenez les techniques de reranking :

- Reranking avec des modèles d’embedding

- Qwen3 Embedding + Qwen3 Reranker sur Ollama

- Reranking avec Ollama + Qwen3 Embedding (Go)

- Reranking avec Ollama + Qwen3 Reranker en Go

Dans les systèmes RAG de production, le reranking compte souvent plus que le passage à un modèle plus grand.

Étape 5 : Intégrer la recherche web (Optionnel mais puissant)

La recherche web augmentée RAG permet une récupération de connaissances dynamique.

La recherche web est utile pour :

- Données en temps réel

- Assistants IA conscients de l’actualité

- Intelligence concurrentielle

- Réponses à des questions à domaine ouvert

Voir les implémentations pratiques :

Étape 6 : Construire un cadre d’évaluation RAG

Un tutoriel RAG sérieux doit inclure une évaluation. Sans elle, l’optimisation d’un système RAG devient du tir au jugulaire.

Ce qu’il faut mesurer

| Couche | Ce qu’il faut mesurer | Pourquoi c’est important |

|---|---|---|

| Ingestion | Couverture des chunks, taux de duplication, version des embeddings | Empêche la dérive silencieuse |

| Récupération | rappel@k, précision@k, MRR/NDCG | Vous dit si vous récupérez les bonnes preuves |

| Reranking | Delta de précision@k par rapport à la baseline | Valide le ROI du reranker |

| Génération | Fidélité / ancrage, précision des citations, qualité du refus | Réduit les hallucinations |

| Système | Latence p50/p95, coût par requête, taux de命中 du cache | Garde la production utilisable |

Harnais d’évaluation minimal (liste de contrôle pratique)

- Construisez un ensemble de test de requêtes (requêtes d’utilisateurs réelles si possible)

- Pour chaque requête, stockez :

- La réponse attendue ou les sources attendues

- Les sources autorisées (documents “gold”) lorsqu’elles sont disponibles

- Lancez un lot hors ligne :

- Récupérer des candidats

- Reranker

- Générer

- Noter (récupération + génération)

- Suivez les métriques dans le temps et échouez le build en cas de régression (même petite)

Commencez simple : 50–200 requêtes suffisent pour détecter les régressions majeures.

Architectures RAG avancées

Une fois que vous comprenez le RAG de base, explorez les modèles avancés :

Variantes RAG avancées : LongRAG, Self-RAG, GraphRAG

Les architectures avancées de Génération Augmentée par Récupération permettent :

- Raisonnement multi-sauts

- Récupération basée sur les graphes

- Boucles d’auto-correction

- Intégration de connaissances structurées

Ces architectures sont essentielles pour les systèmes d’IA de niveau entreprise.

Quand RAG échoue (Et comment le réparer)

La plupart des échecs RAG sont diagnostiquables si vous examinez le couche par couche du pipeline.

- Il retourne un contexte non pertinent → améliorer le chunking, ajouter des filtres de métadonnées, implémenter une recherche hybride, ajuster K.

- Il récupère les bons documents mais répond incorrectement → ajouter du reranking, réduire le bruit du contexte, améliorer les règles d’ancrage du prompt.

- Il hallucine malgré de bons documents → imposer des citations, ajouter un comportement de refus, ajouter un score de fidélité, réduire la température “créative”.

- Il est lent/coûteux → mettre en cache la récupération + les embeddings, réduire le K de reranking, limiter le contexte, regrouper les embeddings, ajuster les paramètres d’index ANN.

- Il fuit des données entre les locataires → implémenter un filtrage ACL au moment de la récupération (pas seulement dans le prompt), séparer les index ou utiliser des partitions par locataire.

Erreurs courantes d’implémentation RAG

Les erreurs courantes dans les tutoriels RAG pour débutants incluent :

- Utiliser des chunks de documents trop grands

- Sauter le reranking

- Surcharger la fenêtre de contexte

- Ne pas filtrer les métadonnées

- Aucun harnais d’évaluation

Corriger ces erreurs améliore considérablement la performance du système RAG.

RAG vs Fine-Tuning

Dans de nombreux tutoriels, RAG et fine-tuning sont confondus. Utilisez ce guide de décision :

| Vous devriez préférer… | Quand… |

|---|---|

| RAG | les connaissances changent fréquemment ; vous avez besoin de citations/traçabilité ; vous avez des documents privés ; vous voulez des mises à jour rapides sans réentraînement |

| Fine-tuning | vous avez besoin d’un ton/comportement cohérent ; vous voulez que le modèle suive un guide de style de domaine ; vos connaissances sont relativement statiques |

| Les deux | vous avez besoin de comportement de domaine et de connaissances fraîches/privées (courant en production) |

Utilisez RAG pour :

- Récupération de connaissances externes

- Données fréquemment mises à jour

- Risque opérationnel réduit

Utilisez le fine-tuning pour :

- Contrôle comportemental

- Cohérence de ton/style

- Adaptation de domaine lorsque les données sont statiques

La plupart des systèmes d’IA avancés combinent la Génération Augmentée par Récupération avec un fine-tuning sélectif.

Meilleures pratiques RAG de production

Si vous passez d’un tutoriel RAG à la production :

Récupération + qualité

- Utilisez la récupération hybride

- Ajoutez du reranking

- Utilisez le filtrage de métadonnées et la déduplication

- Suivez en continu les métriques de récupération (rappel@k / précision@k)

Coût + latence (ne sautez pas cette étape)

- Cache :

- Cache d’embedding (texte identique → embedding identique)

- Cache de récupération (requêtes populaires)

- Cache de réponse (pour les workflows déterministes)

- Ajustez les paramètres d’index ANN (HNSW/IVF) et les opérations par lot

- Contrôlez l’utilisation des tokens : contexte plus petit, moins de candidats, prompts structurés

Sécurité + confidentialité

- Faites le contrôle d’accès au moment de la récupération (filtres ACL / partitions par locataire)

- Redactez ou évitez d’indexer les données PII si possible

- Journalisez en toute sécurité (évitez de stocker les prompts sensibles bruts sauf si nécessaire)

Discipline opérationnelle

- Versionnez vos embeddings et votre stratégie de chunking

- Automatisez les pipelines d’ingestion

- Surveillez les métriques d’hallucination/fidélité

- Suivez le coût par requête

La Génération Augmentée par Récupération n’est pas seulement un concept de tutoriel - c’est une discipline d’architecture de production.

Pensées finales

Ce tutoriel RAG couvre à la fois l’implémentation pour débutants et la conception de systèmes avancés.

La Génération Augmentée par Récupération est la colonne vertébrale des applications IA modernes.

Maîtriser l’architecture RAG, le reranking, les bases de données vectorielles, la recherche hybride et l’évaluation déterminera si votre système d’IA reste une démo - ou devient prêt pour la production.

Ce sujet continuera de s’étendre à mesure que les systèmes RAG évoluent.