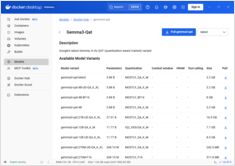

LocalAI QuickStart : Exécuter des LLM compatibles OpenAI localement

Hébergez des APIs compatibles avec OpenAI en local avec LocalAI en quelques minutes.

LocalAI est un serveur d’inférence auto-hébergé, conçu en priorité pour une utilisation locale, qui se comporte comme une API OpenAI de remplacement pour exécuter des charges de travail d’IA sur votre propre matériel (ordinateur portable, station de travail ou serveur sur site).