소비자용 하드웨어를 활용한 AI 인프라

오픈 모델로 저비용 하드웨어에서 엔터프라이즈 AI 배포

AI 의 민주화는 이제 현실이 되었습니다. Llama, Mistral, Qwen 과 같은 오픈소스 LLM 이 독점 모델들과 경쟁할 수준에 도달함에 따라, 팀들은 소비자용 하드웨어를 활용한 AI 인프라 구축 을 통해 비용을 절감하면서도 데이터 프라이버시와 배포에 대한 완전한 통제를 유지할 수 있게 되었습니다.

오픈 모델로 저비용 하드웨어에서 엔터프라이즈 AI 배포

AI 의 민주화는 이제 현실이 되었습니다. Llama, Mistral, Qwen 과 같은 오픈소스 LLM 이 독점 모델들과 경쟁할 수준에 도달함에 따라, 팀들은 소비자용 하드웨어를 활용한 AI 인프라 구축 을 통해 비용을 절감하면서도 데이터 프라이버시와 배포에 대한 완전한 통제를 유지할 수 있게 되었습니다.

LongRAG, Self-RAG, GraphRAG - 차세대 기법

검색 증강 생성 (RAG) 은 단순한 벡터 유사성 검색을 넘어 크게 진화했습니다. LongRAG, Self-RAG, GraphRAG 는 이러한 기능의 최전선을 대표합니다.

GGUF 양자화로 FLUX.1-dev 가속화

FLUX.1-dev 은 텍스트에서 이미지를 생성하는 강력한 모델로, 놀라운 결과를 제공하지만 24GB 이상의 메모리 요구 사항으로 인해 많은 시스템에서 실행하기 어렵습니다. GGUF quantization of FLUX.1-dev 은 메모리 사용량을 약 50% 줄이며 우수한 이미지 품질을 유지하는 해결책을 제공합니다.

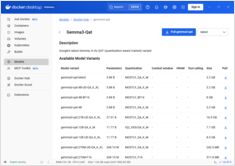

Docker 모델 러너에서 컨텍스트 크기 구성 및 대안 마련

Docker 모델 러너에서 컨텍스트 크기 구성은 예상보다 더 복잡한 경우가 많습니다.

텍스트 지시문으로 이미지를 강화하는 AI 모델

블랙 포레스트 랩스는 텍스트 지시문을 사용하여 기존 이미지를 향상시키는 고급 이미지에서 이미지로 생성하는 AI 모델인 FLUX.1-Kontext-dev를 출시했습니다.

NVIDIA CUDA 지원을 통해 Docker 모델 실행기에서 GPU 가속을 활성화하세요.

Docker Model Runner은 AI 모델을 로컬에서 실행하는 Docker의 공식 도구이지만,

Docker Model Runner에서 NVidia GPU 가속 기능 활성화

은 특정 설정이 필요합니다.

스마트 토큰 최적화로 LLM 비용을 80% 절감하세요

토큰 최적화는 예산을 소모하는 실험에서 비용 효율적인 LLM(대규모 언어 모델) 애플리케이션을 구분하는 핵심 기술입니다.

자체 호스팅된 AI 기반 백업에 저장된 사진

Immich는 사진 및 영상 관리에 대한 완전한 제어권을 제공하는 혁신적인 오픈소스, 자체 호스팅 솔루션입니다. 구글 포토와 경쟁할 수 있는 기능을 갖추고 있으며, AI 기반 얼굴 인식, 스마트 검색, 자동 모바일 백업을 포함하여 데이터를 개인 서버에서 안전하게 보호합니다.

GPT-OSS 120b의 세 AI 플랫폼에서의 벤치마크

저는 Ollama에서 실행되는 GPT-OSS 120b의 성능 테스트 결과를 NVIDIA DGX Spark, Mac Studio, RTX 4080 세 가지 플랫폼에서 확인해보았습니다. Ollama 라이브러리에서 제공하는 GPT-OSS 120b 모델의 크기는 65GB로, RTX 4080의 16GB VRAM에 맞지 않으며, 더 최근의 RTX 5080에도 맞지 않습니다.

AI 어시스턴트를 위한 MCP 서버를 Python 예제와 함께 구축하세요.

모델 컨텍스트 프로토콜(MCP)은 AI 어시스턴트가 외부 데이터 소스 및 도구와 상호 작용하는 방식을 혁신하고 있습니다. 이 가이드에서는 웹 검색 및 스크래핑 기능에 초점을 맞춘 MCP 서버를 Python으로 구축 방법을 살펴보겠습니다.

Docker Model Runner 명령어의 빠른 참조

Docker Model Runner (DMR)은 2025년 4월에 도입된 Docker의 공식 솔루션으로, 로컬에서 AI 모델을 실행하는 데 사용됩니다. 이 가이드는 모든 필수 명령, 구성 및 최선의 실천 방법을 위한 빠른 참조를 제공합니다.

로컬 LLM용 Docker Model Runner와 Ollama 비교

로컬에서 대규모 언어 모델(LLM) 실행 는 프라이버시, 비용 관리 및 오프라인 기능을 위해 점점 더 인기를 끌고 있습니다. 2025년 4월에 Docker가 Docker Model Runner (DMR), AI 모델 배포를 위한 공식 솔루션을 도입하면서 상황은 크게 변화했습니다.

ASIC 및 맞춤형 실리콘이 LLM 추론 속도와 효율성을 끌어올립니다.

6 개 국가의 가용성, 실제 소매 가격 및 Mac Studio 와의 비교.

NVIDIA DGX Spark 는 실존하며, 2025 년 10 월 15 일에 출시되어 통합 NVIDIA AI 스택을 갖춘 로컬 LLM 작업이 필요한 CUDA 개발자를 대상으로 합니다. 미국 권장 소매가 (MSRP) 는 3,999 달러이며, 영국/독일/일본의 소매가는 부가가치세 (VAT) 와 유통 채널 비용으로 인해 더 높습니다. 호주/한국의 공개 스티커 가격은 아직 널리 발표되지 않았습니다.

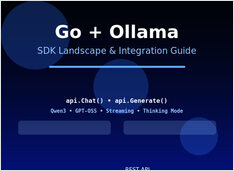

Ollama를 Go와 통합하기: SDK 가이드, 예제 및 프로덕션 최고 실천 방법

이 가이드는 사용 가능한 Ollama용 Go SDK에 대한 종합적인 개요를 제공하고, 그들의 기능 세트를 비교합니다.

이 두 모델의 속도, 파라미터 및 성능 비교

다음은 Qwen3:30b와 GPT-OSS:20b 사이의 비교입니다. 지시사항 준수 및 성능 파라미터, 사양 및 속도에 초점을 맞추고 있습니다.