자체 호스팅 Immich: 개인용 사진 클라우드

자체 호스팅된 AI 기반 백업에 저장된 사진

Immich는 사진 및 영상 관리에 대한 완전한 제어권을 제공하는 혁신적인 오픈소스, 자체 호스팅 솔루션입니다. 구글 포토와 경쟁할 수 있는 기능을 갖추고 있으며, AI 기반 얼굴 인식, 스마트 검색, 자동 모바일 백업을 포함하여 데이터를 개인 서버에서 안전하게 보호합니다.

자체 호스팅된 AI 기반 백업에 저장된 사진

Immich는 사진 및 영상 관리에 대한 완전한 제어권을 제공하는 혁신적인 오픈소스, 자체 호스팅 솔루션입니다. 구글 포토와 경쟁할 수 있는 기능을 갖추고 있으며, AI 기반 얼굴 인식, 스마트 검색, 자동 모바일 백업을 포함하여 데이터를 개인 서버에서 안전하게 보호합니다.

GPT-OSS 120b의 세 AI 플랫폼에서의 벤치마크

저는 Ollama에서 실행되는 GPT-OSS 120b의 성능 테스트 결과를 NVIDIA DGX Spark, Mac Studio, RTX 4080 세 가지 플랫폼에서 확인해보았습니다. Ollama 라이브러리에서 제공하는 GPT-OSS 120b 모델의 크기는 65GB로, RTX 4080의 16GB VRAM에 맞지 않으며, 더 최근의 RTX 5080에도 맞지 않습니다.

AI 어시스턴트를 위한 MCP 서버를 Python 예제와 함께 구축하세요.

모델 컨텍스트 프로토콜(MCP)은 AI 어시스턴트가 외부 데이터 소스 및 도구와 상호 작용하는 방식을 혁신하고 있습니다. 이 가이드에서는 웹 검색 및 스크래핑 기능에 초점을 맞춘 MCP 서버를 Python으로 구축 방법을 살펴보겠습니다.

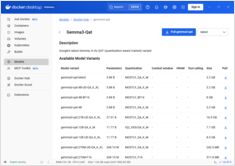

Docker Model Runner 명령어의 빠른 참조

Docker Model Runner (DMR)은 2025년 4월에 도입된 Docker의 공식 솔루션으로, 로컬에서 AI 모델을 실행하는 데 사용됩니다. 이 가이드는 모든 필수 명령, 구성 및 최선의 실천 방법을 위한 빠른 참조를 제공합니다.

로컬 LLM용 Docker Model Runner와 Ollama 비교

로컬에서 대규모 언어 모델(LLM) 실행 는 프라이버시, 비용 관리 및 오프라인 기능을 위해 점점 더 인기를 끌고 있습니다. 2025년 4월에 Docker가 Docker Model Runner (DMR), AI 모델 배포를 위한 공식 솔루션을 도입하면서 상황은 크게 변화했습니다.

전문적인 칩이 AI 추론을 더 빠르고 저렴하게 만들어가고 있습니다.

6 개 국가의 가용성, 실제 소매 가격 및 Mac Studio 와의 비교.

NVIDIA DGX Spark 는 실존하며, 2025 년 10 월 15 일에 출시되어 통합 NVIDIA AI 스택을 갖춘 로컬 LLM 작업이 필요한 CUDA 개발자를 대상으로 합니다. 미국 권장 소매가 (MSRP) 는 3,999 달러이며, 영국/독일/일본의 소매가는 부가가치세 (VAT) 와 유통 채널 비용으로 인해 더 높습니다. 호주/한국의 공개 스티커 가격은 아직 널리 발표되지 않았습니다.

Ollama를 Go와 통합하기: SDK 가이드, 예제 및 프로덕션 최고 실천 방법

이 가이드는 사용 가능한 Ollama용 Go SDK에 대한 종합적인 개요를 제공하고, 그들의 기능 세트를 비교합니다.

이 두 모델의 속도, 파라미터 및 성능 비교

다음은 Qwen3:30b와 GPT-OSS:20b 사이의 비교입니다. 지시사항 준수 및 성능 파라미터, 사양 및 속도에 초점을 맞추고 있습니다.

매우 좋지 않다.

Ollama의 GPT-OSS 모델은 특히 LangChain, OpenAI SDK, vllm과 같은 프레임워크와 함께 사용될 때 구조화된 출력을 처리하는 데 반복적으로 문제가 발생합니다.

Ollama에서 구조화된 출력을 얻는 몇 가지 방법

대규모 언어 모델(LLMs) 은 강력하지만, 실제 운영 환경에서는 일반적인 문장이 아닌 예측 가능한 데이터를 원합니다. 즉, 앱에 입력할 수 있는 속성, 사실 또는 구조화된 객체를 원합니다. 이에 대해 LLM 구조화된 출력을 살펴보겠습니다.

내가 직접 수행한 ollama 모델 스케줄링 테스트

여기에서 저는 새로운 버전의 Ollama가 모델에 얼마나 많은 VRAM을 할당하는지와 이전 버전의 Ollama를 비교하고 있습니다. 새로운 버전은 오히려 더 나빠졌습니다.

현재 Ollama 개발 상태에 대한 제 의견

Ollama은 LLM을 로컬에서 실행하는 데 사용되는 가장 인기 있는 도구 중 하나로 빠르게 자리 잡았습니다. 간단한 CLI와 스트리밍된 모델 관리 기능으로 인해 클라우드 외부에서 AI 모델을 다루고자 하는 개발자들에게 필수적인 선택지가 되었습니다.

2025년 Ollama의 가장 주목받는 UI에 대한 간략한 개요

로컬에서 호스팅된 Ollama는 자신의 기계에서 대규모 언어 모델을 실행할 수 있게 해주지만, 명령줄을 통해 사용하는 것은 사용자 친화적이지 않습니다.

다음은 로컬 Ollama에 연결되는 **ChatGPT 스타일 인터페이스**를 제공하는 여러 오픈소스 프로젝트입니다.

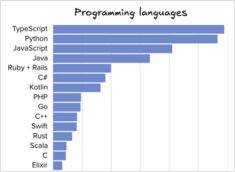

소프트웨어 엔지니어링 도구 및 언어 비교

The Pragmatic Engineer 뉴스레터가 며칠 전에 발표한 설문 조사 통계에 따르면, 2025년 중반의 프로그래밍 언어, IDE, AI 도구의 인기 및 기타 데이터가 포함되어 있습니다.

2025 년 7 월이면 곧 이용 가능할 것입니다.

Nvidia 가 곧 NVIDIA DGX Spark를 출시합니다. 128GB 이상의 통합 RAM 과 1 PFLOPS AI 성능을 갖춘 블랙웰 (Blackwell) 아키텍처 기반의 소형 AI 슈퍼컴퓨터입니다. LLM 을 실행하기에 훌륭한 기기입니다.