Ollama 上の Qwen3 埋め込みモデルとリランカーモデル:最先端のパフォーマンス

Ollama で利用可能な新しい素晴らしい LLM

Qwen3 埋め込みモデルとreranker モデル は、Qwen ファミリー最新リリースであり、高度なテキスト埋め込み、検索、再ランク付けタスクに特じて設計されています。

目を楽しませる

Qwen3 埋め込みモデルと reranker モデルは、多言語自然言語処理(NLP)における重要な進歩を表しており、テキスト埋め込みおよび再ランク付けタスクにおいて最先端の性能を提供します。アリババによって開発された Qwen シリーズの一部であるこれらのモデルは、意味検索からコード検索に至るまで、幅広いアプリケーションをサポートするように設計されています。この種の埋め込み機能は、検索拡張生成(RAG)チュートリアル:アーキテクチャ、実装、および製品化ガイド に詳細に記載されているように、効果的な RAG システムを構築するための基盤となります。一方、Ollamaは、大規模言語モデル(LLM)をホストおよびデプロイするための人気のオープンソースプラットフォームですが、Qwen3 モデルとの統合については公式ドキュメントに明示的に記載されていません。しかし、これらのモデルは Hugging Face、GitHub、ModelScope を介してアクセス可能であり、Ollama や同様のツールを介したローカルデプロイメントが可能となっています。

これらのモデルを使用した例

Ollama とこれらモデルを使用した Go 言語のサンプルコードをご覧ください:

- Ollama と Qwen3 埋め込みモデルを使用したテキストドキュメントの再ランク付け - Go 言語版

- Ollama と Qwen3 Reranker モデルを使用したテキストドキュメントの再ランク付け - Go 言語版

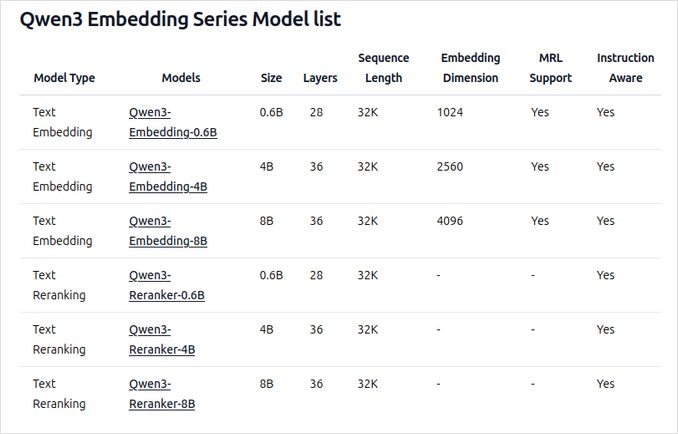

Ollama 上の新しい Qwen3 埋め込みおよび Reranker モデルの概要

これらのモデルは、さまざまなサイズで Ollama 上にデプロイ可能となり、言語およびコード関連の幅広いアプリケーションに対して最先端の性能と柔軟性を提供します。

主な機能と能力

-

モデルサイズと柔軟性

- 埋め込みおよび再ランク付けタスクの両方に、0.6B、4B、8B パラメータの複数のサイズで利用可能です。

- 8B 埋め込みモデルは現在、MTEB 多言語リーダーボードで第 1 位を誇っています(2025 年 6 月 5 日時点、スコア 70.58)。

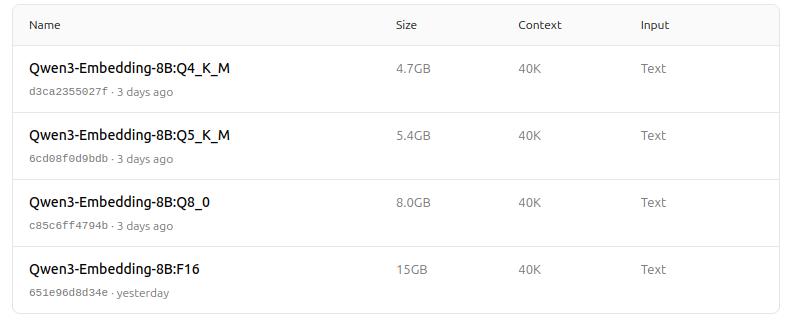

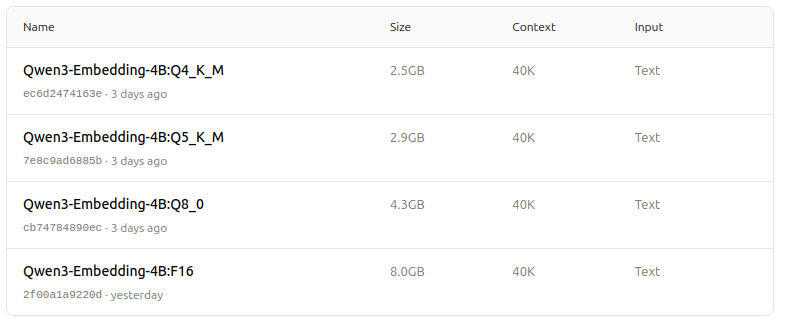

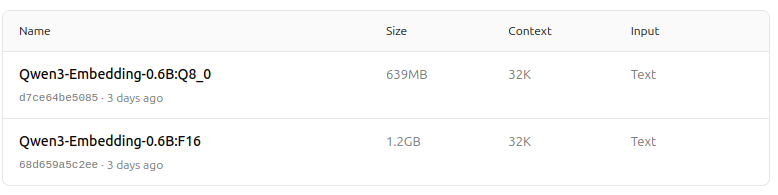

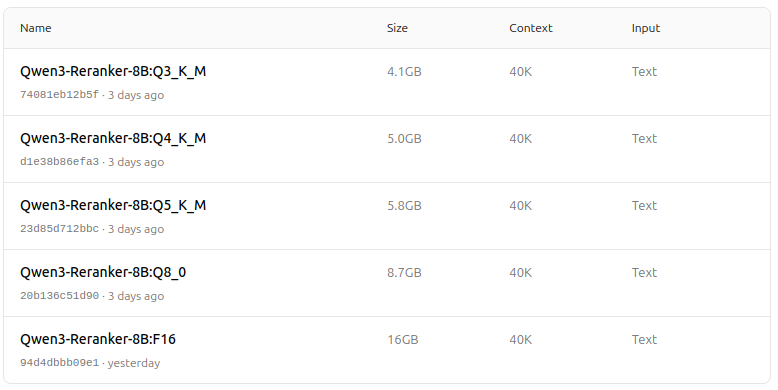

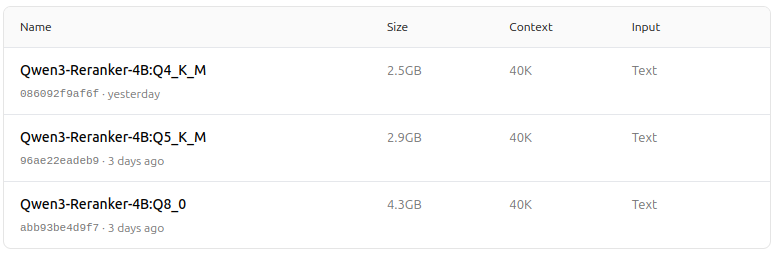

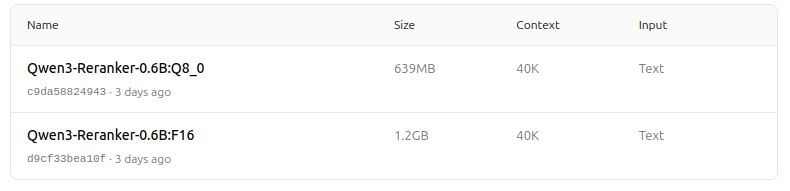

- パフォーマンス、メモリ使用量、速度のバランスを取るために、Q4、Q5、Q8 などの幅広い量子化オプションをサポートしています。Q5_K_M は、リソース効率を維持しながらモデル性能の大部分を保持するため、ほとんどのユーザーに推奨されます。

-

アーキテクチャとトレーニング

- Qwen3 基盤上に構築され、デュアルエンコーダー(埋め込み用)とクロスエンコーダー(再ランク付け用)の両方のアーキテクチャを活用しています。

- 埋め込みモデル:単一のテキストセグメントを処理し、最終隠れ状態から意味的な表現を抽出します。

- Reranker モデル:テキストペア(クエリとドキュメントなど)を受け取り、クロスエンコーダーアプローチを使用して関連性スコアを出力します。

- 埋め込みモデルは、対照事前学習、高品質データを用いた教師あり学習、最適な汎化能力と適応性のためのモデルマージという 3 段階のトレーニングパラダイムを使用します。

- Reranker モデルは、効率性と効果性を高めるために、高品質なラベル付きデータで直接トレーニングされています。

-

多言語およびマルチタスクサポート

- プログラミング言語を含む 100 以上の言語をサポートし、堅牢な多言語、クロス言語、コード検索機能を可能にします。

- 埋め込みモデルは、特定のタスクや言語に合わせたパフォーマンスを調整するための柔軟なベクトル定義とユーザー定義の指示を許可します。

- テキストを超えたマルチモーダル機能が必要なアプリケーションについては、クロスモーダル埋め込み:AI モダリティを橋渡しする をご覧ください。

-

パフォーマンスとユースケース

- テキスト検索、コード検索、分類、クラスタリング、バイテキストマイニングにおいて最先端の結果を提供します。

- Reranker モデルは、さまざまなテキスト検索シナリオで優れており、埋め込みモデルとシームレスに組み合わせて、エンドツーエンドの検索パイプラインを構築できます。

Ollama での使用方法

以下のコマンドを使用して、Ollama でこれらのモデルを実行できます:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

ハードウェアとパフォーマンス要件に最適な量子化バージョンを選択してください。

2025 年 12 月更新: 現在、Ollama は dengcao のリポジトリではなく、自社のリポジトリから標準の Qwen3 埋め込みモデルを提供しています:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

詳細はこちら:https://ollama.com/library/qwen3-embedding

まとめ表

| モデルタイプ | 利用可能なサイズ | 主な強み | 多言語サポート | 量子化オプション |

|---|---|---|---|---|

| 埋め込み | 0.6B, 4B, 8B | MTEB スコアトップ、柔軟、効率的、最先端 | はい(100 以上の言語) | Q4, Q5, Q6, Q8 など |

| Reranker | 0.6B, 4B, 8B | テキストペアの関連性で優れ、効率的、柔軟 | はい | F16, Q4, Q5 など |

素晴らしいニュース!

Ollama 上の Qwen3 埋め込みモデルと reranker モデルは、多言語・マルチタスクのテキストおよびコード検索能力において大きな飛躍を遂げました。柔軟なデプロイメントオプション、強力なベンチマークパフォーマンス、そして幅広い言語とタスクへのサポートにより、研究環境だけでなく製品環境にも適しています。

モデルズー - 現在では目を楽しませる

Qwen3 埋め込み

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

Qwen3 Reranker

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

素晴らしい!

有用なリンク

- Ollama と Qwen3 埋め込みモデルを使用したテキストドキュメントの再ランク付け - Go 言語版

- Ollama と Qwen3 Reranker モデルを使用したテキストドキュメントの再ランク付け - Go 言語版

- Ollama チートシート

- Ollama モデルを異なるドライブまたはフォルダに移動する

- Ollama を使用した Perplexica のセルフホスティング

- テスト:Ollama が Intel CPU パフォーマンスと効率的なコアをどのように使用しているか

- LLM スピードパフォーマンス比較

- LLM の要約能力比較

- クラウド LLM プロバイダー

- Ollama が並行リクエストをどのように処理するか

- Hugo ページ翻訳品質の比較 - Ollama 上の LLM