Confronto della idoneità delle GPU NVidia per l'AI

L'AI richiede molto potere...

Nel mezzo del caos del mondo moderno qui sto confrontando le specifiche tecniche di diverse schede adatte a compiti legati all’AI (Deep Learning, Rilevamento Oggetti e LLMs). Sono però tutte incredibilmente costose.

Per ulteriori informazioni su come la scelta della GPU influisce sul throughput degli LLM, sui limiti di VRAM e sui benchmark in diversi ambienti di esecuzione, vedi Prestazioni LLM: Benchmark, Colli di Bottiglia & Ottimizzazione.

Questo è un’immagine generata dall’AI. Non prenderla troppo seriamente…

Diamo un’occhiata ad altre opzioni, solo per fare un giro

| Scheda | VRAM | Larghezza Bus | Bandwidth della Memoria | CUDA Cores | Tensor Cores | Potenza (W) |

|---|---|---|---|---|---|---|

| RTX 4060 Ti 16GB | 16 GB | 128-bit | 288 GB/s | 4,352 | 136 | 165 |

| RTX 4070 Ti 16GB | 16 GB | 256-bit | 672 GB/s | 7,680 | 240 | 285 |

| RTX 4080 16GB | 16 GB | 256-bit | 716,8 GB/s | 9,728 | 304 | 320 |

| RTX 4080 Super 16GB | 16 GB | 256-bit | 736 GB/s | 10,240 | 320 | 320 |

| RTX 4090 24GB | 24 GB | 384-bit | 1008 GB/s | 16,384 | 512 | 450 |

| RTX 5060 Ti 16GB | 16 GB | 128-bit | 448 GB/s | 4,608 | 144 | 180 |

| RTX 5070 Ti 16GB | 16 GB | 256-bit | 896 GB/s | 8,960 | 280 | 300 |

| RTX 5080 16GB | 16 GB | 256-bit | 896 GB/s | 10,752 | 336 | ~320 |

| RTX 5090 32GB | 32 GB | 512-bit | 1792 GB/s | 21,760 | 680 | ~450 |

| RTX 2000 Ada | 16 GB | 128-bit | 224 GB/s | 2,816 | 88 | 70 |

| RTX 4000 Ada | 20 GB | 160-bit | 280 GB/s | 6,144 | 192 | 70 |

| RTX 4500 Ada | 24 GB | 192-bit | 432 GB/s | 7,680 | 240 | 210 |

| RTX 5000 Ada | 32 GB | 256-bit | 576 GB/s | 12,800 | 400 | 250 |

| RTX 6000 Ada | 48 GB | 384-bit | 960 GB/s | 18,176 | 568 | 300 |

Bandwidth della Memoria:

- RTX 5090 (1792 GB/s), seguito da RTX 4090 (1008 GB/s), seguito da RTX 6000 Ada (960 GB/s)

Tensor Cores:

- RTX 5090 (680), seguito da RTX 6000 Ada (568), seguito da RTX 4090 (512)

CUDA Cores

- RTX 5090 (21,760), seguito da RTX 6000 Ada (18,176), seguito da RTX 4090 (16,384)

RAM

- RTX 6000 Ada (48 GB), seguito da RTX 5090 e RTX 5000 Ada (32 GB), seguito da RTX 4090 (24 GB)

Prezzi in Australia

- RTX 6000 Ada: 12.000 AUD

- RTX 5090: 6.000 AUD

- RTX 5000 Ada: 7.000 AUD

- RTX 4090: esaurito

La migliore GPU consumer per LLM

Pensando comunque, ritengo che l’RTX 5090 sarebbe comunque la scelta migliore per l’apprendimento automatico, il deep learning, l’AI e anche per gli LLM :).

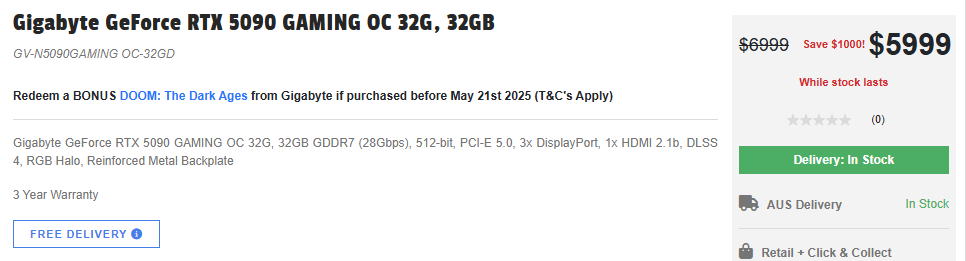

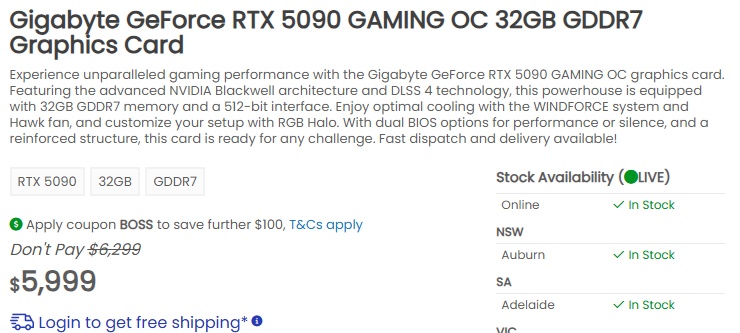

Prezzi reali

Un po’ costosi…

E i prezzi reali dell’RTX 5090 sono il 50% più alti del previsto. Guarda questo!

Questo è il 15/05/2025

Per esplorare i benchmark degli LLM, i requisiti di VRAM e l’ottimizzazione delle prestazioni su diverse GPU e ambienti di esecuzione, consulta il nostro Prestazioni LLM: Benchmark, Colli di Bottiglia & Ottimizzazione.