Spostare i modelli Ollama in una posizione diversa

I file del modello LLM Ollama occupano molto spazio.

Dopo aver installato ollama è meglio riconfigurare ollama per archiviarli in un nuovo posto fin da subito. In questo modo, dopo aver scaricato un nuovo modello, non verrà scaricato nella vecchia posizione.

Informazioni su Ollama

Ollama è un’interfaccia basata su testo per LLM AI Models e un’API che può ospitare anche questi modelli. Per un confronto più ampio tra Ollama, vLLM, Docker Model Runner, LocalAI e fornitori di cloud—compresi i trade-off di costo e infrastruttura—vedi LLM Hosting: Local, Self-Hosted & Cloud Infrastructure Compared.

Installa Ollama

Vai a https://ollama.com/download

Per installare Ollama su Linux:

curl -fsSL https://ollama.com/install.sh | sh

Ollama su Windows è sulla pagina: https://ollama.com/download/windows Ollama per Mac è lì: https://ollama.com/download/macOllamaSetup.exe

Scarica, elenca e rimuovi i modelli Ollama

Per scaricare alcuni modelli Ollama: Vai alla Libreria Ollama (https://ollama.com/library) e trova il modello che ti serve, lì puoi trovare anche i tag e le dimensioni dei modelli.

Poi esegui:

ollama pull gemma2:latest

# Oppure ottieni un modello leggermente più intelligente che si adatta comunque a 16 GB di VRAM:

ollama pull gemma2:27b-instruct-q3_K_S

# Oppure:

ollama pull llama3.1:latest

ollama pull llama3.1:8b-instruct-q8_0

ollama pull mistral-nemo:12b-instruct-2407-q6_K

ollama pull mistral-small:22b-instruct-2409-q4_0

ollama pull phi3:14b-medium-128k-instruct-q6_K

ollama pull qwen2.5:14b-instruct-q5_0

Per controllare i modelli Ollama presenti nel repository locale:

ollama list

Per rimuovere un modello non necessario:

ollama rm qwen2:7b-instruct-q8_0 # ad esempio

Posizione dei modelli Ollama

Per default i file dei modelli vengono archiviati:

- Windows: C:\Users%username%.ollama\models

- Linux: /usr/share/ollama/.ollama/models

- macOS: ~/.ollama/models

Configurazione del percorso dei modelli Ollama su Windows

Per creare una variabile di ambiente su Windows puoi seguire queste istruzioni:

- Apri le Impostazioni di Windows.

- Vai a Sistema.

- Seleziona Informazioni.

- Seleziona Impostazioni avanzate del sistema.

- Vai alla scheda Avanzate.

- Seleziona Variabili di ambiente…

- Clicca su Nuovo…

- Crea una variabile chiamata OLLAMA_MODELS che punti al luogo in cui desideri archiviare i modelli

Spostare i modelli Ollama su Linux

Modifica i parametri del servizio systemd di Ollama

sudo systemctl edit ollama.service

o

sudo xed /etc/systemd/system/ollama.service

Questo aprirà un editor.

Per ogni variabile di ambiente, aggiungi una riga Environment sotto la sezione [Service]:

[Service]

Environment="OLLAMA_MODELS=/specialplace/ollama/models"

Salva e esci.

Esiste anche una variabile di User e Group, queste devono avere accesso a questa cartella.

Ricarica systemd e riavvia Ollama:

sudo systemctl daemon-reload

sudo systemctl restart ollama

se qualcosa è andato storto

systemctl status ollama.service

sudo journalctl -u ollama.service

Overhead dei file su NTFS

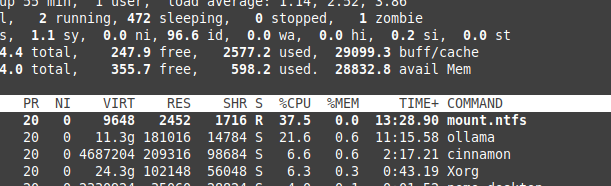

Presta attenzione al fatto che se stai eseguendo Linux e mantieni i tuoi modelli su un partizione formattata in NTFS, i tuoi modelli saranno caricati molto più lentamente—più del 20%.

Installa Ollama su Windows in una cartella specifica

Insieme ai modelli

.\OllamaSetup.exe /DIR=D:\OllamaDir

Espone l’API Ollama alla rete interna

Interno qui significa rete locale.

Aggiungi alla configurazione del servizio:

[Service]

Environment="OLLAMA_HOST=0.0.0.0"

Per vedere come Ollama si adatta ad altre opzioni locali e cloud LLM, consulta la nostra LLM Hosting: Local, Self-Hosted & Cloud Infrastructure Compared.

Link utili

- Test: Come Ollama utilizza le prestazioni del processore Intel e i core efficienti

- Come Ollama gestisce le richieste parallele

- Prestazioni LLM e canali PCIe: considerazioni chiave

- Confronto delle prestazioni LLM

- Confronto delle capacità di sintesi dei testi LLM

- Scrivere prompt efficaci per LLM

- Self-hosting di Perplexica con Ollama

- Fornitori di LLM su cloud