Interfacce di chat per istanze locali di Ollama

Panoramica rapida delle interfacce utente più prominenti per Ollama nel 2025

Locally hosted Ollama consente di eseguire modelli linguistici di grandi dimensioni sul proprio computer, ma l’utilizzo tramite riga di comando non è particolarmente utente-friendly. Ecco diversi progetti open-source che forniscono interfacce simili a ChatGPT che si connettono a un Ollama locale.

Queste interfacce utente supportano chat conversazionali, spesso con funzionalità come caricamento documenti per generazione assistita da recupero (RAG), e vengono eseguite come applicazioni web o desktop. Di seguito è riportata una comparazione delle opzioni principali, seguita da sezioni dettagliate su ciascuna. Per una visione più ampia su come l’Ollama locale si adatta a vLLM, Docker Model Runner, LocalAI e provider cloud – inclusi i compromessi di costo e infrastruttura – vedi LLM Hosting: Local, Self-Hosted & Cloud Infrastructure Compared.

Confronto tra UI compatibili con Ollama

| Strumento UI | Piattaforma | Supporto documenti | Integrazione con Ollama | Punti di forza | Limitazioni |

|---|---|---|---|---|---|

| Page Assist | Estensione del browser (Chrome, Firefox) | Sì – aggiungi file per l’analisi | Si connette a Ollama locale tramite la configurazione dell’estensione | Chat in-browser; gestione facile dei modelli e integrazione del contesto della pagina web. | Solo per browser; richiede l’installazione/configurazione di un’estensione. |

| Open WebUI | App web (self-hosted; Docker/PWA) | Sì – RAG integrato (carica documenti o aggiungi alla libreria) | Supporto diretto dell’API Ollama o server incluso (configura l’URL base) | Funzionalità ricche (multi-LLM, offline, generazione immagini); mobile-friendly (PWA). | Configurazione più pesante (Docker/K8s); l’ambito ampio può essere troppo per un uso semplice. |

| LobeChat | App web (self-hosted; supporto PWA) | Sì – “Knowledge Base” con caricamento file (PDF, immagini, ecc.) | Supporta Ollama come uno dei diversi backend AI (richiede l’abilitazione dell’API di Ollama) | Interfaccia elegante simile a ChatGPT; chat vocale, plugin e supporto multi-modello. | Set di funzionalità complesso; richiede l’ambiente di configurazione (es. cross-origin per Ollama). |

| LibreChat | App web (self-hosted; multi-utente) | Sì – “Chat con File” utilizzando RAG (tramite embedding) | Compatibile con Ollama e molti altri provider (switchabile per chat) | Interfaccia familiare simile a ChatGPT; funzionalità ricche (agenti, interprete di codice, ecc.). | Installazione/configurazione può essere impegnativa; progetto grande potrebbe essere più di quanto necessario per un uso base. |

| AnythingLLM | App desktop (Windows, Mac, Linux) o web (Docker) | Sì – RAG integrato: trascina e rilascia documenti (PDF, DOCX, ecc.) con citazioni | Ollama supportato come provider LLM (impostato nella configurazione o nell’ambiente Docker) | UI completa (ChatGPT privata con i tuoi documenti); costruttore di agenti senza codice, supporto multi-utente. | Utilizzo delle risorse più elevato (database degli embedding, ecc.); l’app desktop manca di alcune funzionalità multi-utente. |

| Chat-with-Notes | App web (server leggero Flask) | Sì – carica file di testo/PDF e chat con il loro contenuto | Utilizza Ollama per tutte le risposte AI (richiede che Ollama venga eseguito localmente) | Configurazione molto semplice e interfaccia focalizzata sulla domanda e risposta sui documenti; i dati rimangono locali. | UI e funzionalità basiche; singolo utente, un documento alla volta (nessun avanzato). |

Ogni uno di questi strumenti è attivamente mantenuto e open-source. Successivamente, approfondiamo i dettagli di ciascuna opzione, inclusi il modo in cui funzionano con Ollama, le funzionalità notevoli e i compromessi.

Page Assist (Estensione del browser)

Page Assist è un’estensione open-source per il browser che porta il chat con il modello locale al tuo browser. Supporta browser basati su Chromium e Firefox, offrendo un riquadro o una scheda simile a ChatGPT in cui puoi conversare con un modello. Page Assist può connettersi a Ollama in esecuzione localmente come provider AI, o ad altri backend locali, tramite le sue impostazioni. Notevolmente, ti permette di aggiungere file (es. PDF o testo) per l’analisi dell’AI all’interno della chat, abilitando i workflow RAG di base. Puoi persino farlo aiutare con il contenuto della pagina web corrente o eseguire ricerche web per informazioni.

L’installazione è semplice: installa l’estensione dal Chrome Web Store o Firefox Add-ons, assicurati che Ollama sia in esecuzione e seleziona Ollama come provider locale di AI nelle impostazioni di Page Assist. L’interfaccia include funzionalità come la cronologia della chat, la selezione del modello e un URL condivisibile opzionale per i risultati della chat. È disponibile anche un interfaccia web tramite un collegamento da tastiera se preferisci un’esperienza di chat a scheda completa.

Punti di forza: Page Assist è leggero e conveniente – poiché vive nel browser, non c’è nessun server separato da eseguire. È perfetto per contesti di navigazione (puoi aprirlo su qualsiasi pagina web) e supporta integrazione di ricerche internet e allegati di file per arricchire la conversazione. Fornisce anche funzionalità utili come scorci da tastiera per nuove chat e attivazione/disattivazione del riquadro laterale.

Limitazioni: Essendo un’estensione, è limitato all’ambiente del browser. L’interfaccia è più semplice e un po’ meno ricca di funzionalità rispetto a chat app autonome. Ad esempio, la gestione multi-utente o i plugin avanzati non rientrano nell’ambito. Inoltre, l’installazione iniziale potrebbe richiedere di costruire/caricare l’estensione se non è disponibile una versione preimballata per il tuo browser (il progetto fornisce istruzioni per il build utilizzando Bun o npm). In sintesi, Page Assist è ideale per l’uso individuale quando si desidera un accesso rapido al chat alimentato da Ollama durante la navigazione web, con capacità RAG moderate.

Open WebUI (App web self-hosted)

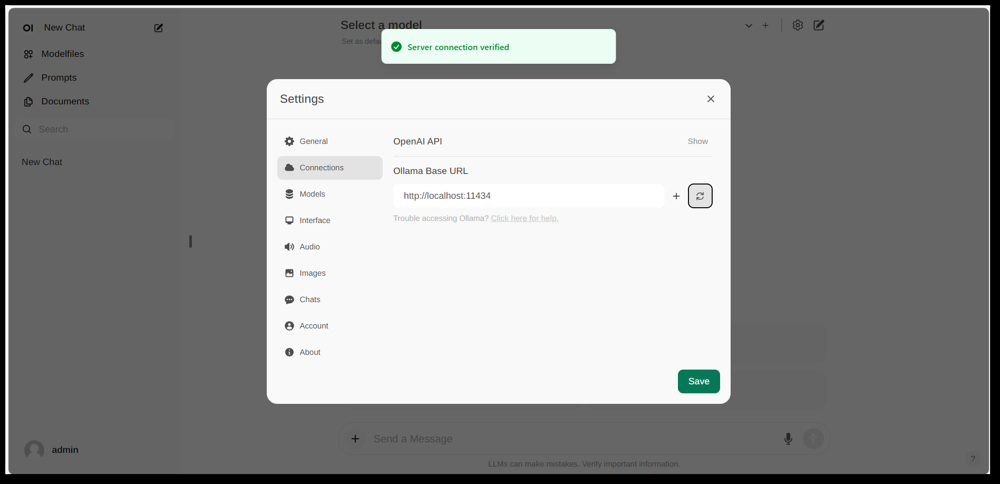

Interfaccia delle impostazioni di Open WebUI, mostrando una connessione Ollama configurata (URL base impostato sull’API locale di Ollama). L’interfaccia include una sezione Documenti, abilitando i workflow RAG.

Open WebUI è un potente frontend generico per chat originariamente creato per funzionare con Ollama, e ora espanso per supportare vari backend LLM. Funziona come un’applicazione web self-hosted e tipicamente viene distribuita tramite Docker o Kubernetes per una facile installazione. Una volta in esecuzione, puoi accedervi tramite il tuo browser (con supporto per l’installazione come Progressive Web App su dispositivi mobili).

Open WebUI offre un’interfaccia completa di chat con supporto multi-utente, gestione dei modelli e funzionalità estese. Criticamente, ha capacità RAG integrate – puoi caricare o importare documenti in una libreria di documenti e quindi porre domande con l’aggiornamento del recupero. L’interfaccia consente di caricare documenti direttamente in una sessione di chat o mantenere una libreria persistente di conoscenza. Supporta anche l’esecuzione di ricerche web e l’inserimento dei risultati nella conversazione per informazioni aggiornate.

Integrazione con Ollama: Open WebUI si connette a Ollama tramite la sua API. Puoi eseguire il container Docker di Open WebUI insieme a un server Ollama e impostare una variabile ambiente per puntare all’URL di Ollama, o utilizzare un’immagine Docker speciale che include Ollama con l’interfaccia web. Nella pratica, dopo aver avviato i container, visiterai Open WebUI nel tuo browser e vedrai il “Server connection verified” se configurato correttamente (come mostrato nell’immagine sopra). Questo significa che l’interfaccia è pronta per utilizzare i tuoi modelli Ollama locali per la chat. Open WebUI supporta anche endpoint compatibili con l’API di OpenAI, quindi può interfacciarsi con LM Studio, OpenRouter, ecc., oltre a Ollama.

Punti di forza: Questa soluzione è una delle più ricche di funzionalità e flessibili UI. Supporta multipli modelli simultanei e thread di conversazione, “personaggi” personalizzati o prompt di sistema, generazione di immagini e altro. L’implementazione RAG è robusta – ottieni un’interfaccia completa per la gestione dei documenti e anche la configurazione di quale archivio vettoriale o servizio di ricerca utilizzare per il recupero. Open WebUI è anche attivamente sviluppato (con una comunità estesa, come indicato dal numero elevato di stelle su GitHub) e progettato per estensibilità e scalabilità. È una buona scelta se desideri un’interfaccia completa di chat per modelli locali, specialmente in un contesto con multipli utenti o complessi casi d’uso.

Limitazioni: Con grandi poteri vengono maggiori complessità. Open WebUI può essere troppo pesante per un uso personale semplice – distribuire i container Docker e gestire la configurazione potrebbe essere intimidatorio se non sei familiare. Consuma più risorse di un’app leggera, poiché esegue un server web, un database opzionale per la cronologia delle chat, ecc. Inoltre, funzionalità come il controllo degli accessi basato sui ruoli e la gestione degli utenti, sebbene utili, indicano che è orientata a un setup server – un singolo utente su un PC domestico potrebbe non averne bisogno. In sintesi, l’installazione è più pesante e l’interfaccia potrebbe sembrare complessa se hai bisogno solo di un clone base di ChatGPT. Ma per coloro che ne hanno bisogno delle sue funzionalità ampie (o vogliono facilmente passare tra Ollama e altri fornitori di modelli in un’unica interfaccia), Open WebUI è un’ottima opzione.

LobeChat (Framework ChatGPT-like con plugin)

Banner dell’interfaccia di LobeChat che mostra “Ollama Supported” e diversi modelli locali. LobeChat ti permette di distribuire un’app web elegante simile a ChatGPT utilizzando Ollama o altri fornitori, con funzionalità come input vocale e plugin.

LobeChat è un framework di chat open-source che si concentra su un’esperienza utente raffinata e flessibilità. È essenzialmente un applicazione web simile a ChatGPT che puoi self-hostare, con supporto per diversi fornitori di AI – da OpenAI e Anthropic a modelli open-source tramite Ollama. LobeChat è progettato con la privacy in mente (lo esegui tu stesso) e ha un’interfaccia moderna che include convenienze come la memoria delle conversazioni, la modalità di conversazione vocale e persino la generazione di immagini testo tramite plugin.

Una delle funzionalità chiave di LobeChat è la sua capacità di Knowledge Base. Puoi caricare documenti (in formati come PDF, immagini, audio, video) e creare una knowledge base che può essere utilizzata durante la chat. Questo significa che puoi porre domande sul contenuto dei tuoi file – un workflow RAG che LobeChat supporta di serie. L’interfaccia fornisce la gestione di questi file/knowledge base e consente di attivare/disattivare il loro utilizzo nella conversazione, offrendo un’esperienza Q&A più ricca oltre il base LLM.

Per utilizzare LobeChat con Ollama, deployerai l’app LobeChat (ad esempio tramite un’immagine Docker fornita o uno script) e configurerai Ollama come backend. LobeChat riconosce Ollama come un provider di primo piano – offre persino uno script di deploy one-click tramite il browser Pinokio AI se lo utilizzi. Nella pratica, potresti dover modificare le impostazioni di Ollama (come abilitare CORS come indicato nella documentazione di LobeChat) in modo che l’interfaccia web di LobeChat possa accedere all’API HTTP di Ollama. Una volta configurato, puoi selezionare un modello Ollama-hosted nell’interfaccia di LobeChat e conversare con esso, incluso il query dei documenti caricati.

Punti di forza: L’interfaccia di LobeChat è spesso lodata per essere pulita e utente-friendly, molto simile a ChatGPT (che può facilitare l’adozione). Aggiunge valore con extra come input/output vocale per conversazioni parlate e un sistema di plugin per estendere le funzionalità (simile ai plugin di ChatGPT, abilitando cose come navigazione web o generazione immagini). Il supporto multi-modello significa che puoi facilmente passare tra, ad esempio, un modello locale Ollama e un modello API OpenAI nello stesso interfaccia. Supporta anche l’installazione come un PWA mobile-friendly, quindi puoi accedere al tuo chat locale in mobilità.

Limitazioni: Configurare LobeChat può essere più complesso di alcune alternative. È un’applicazione full-stack (spesso eseguita con Docker Compose), quindi c’è un po’ di overhead. In particolare, configurare l’integrazione con Ollama richiede abilitare le richieste cross-origin sul lato di Ollama e assicurare che le porte siano allineate – un compito una volta, ma tecnico. Inoltre, sebbene LobeChat sia molto potente, non tutte le funzionalità potrebbero essere necessarie per ogni utente; ad esempio, se non hai bisogno di supporto multi-fornitore o plugin, l’interfaccia potrebbe sembrare affollata rispetto a uno strumento minimalista. Infine, certe funzionalità avanzate come il deploy one-click presuppongono ambienti specifici (browser Pinokio o Vercel), che potresti o non usare. In sintesi, LobeChat è ideale se desideri un alternativa completa a ChatGPT che funziona localmente con Ollama, e non ti dispiace un po’ di configurazione iniziale per arrivare lì.

LibreChat (Clone di ChatGPT con supporto multi-fornitore)

LibreChat (noto in precedenza come ChatGPT-Clone o UI) è un progetto open-source che mira a replicare e estendere l’interfaccia e le funzionalità di ChatGPT. Può essere distribuito localmente (o sul tuo server) e supporta una varietà di backend AI – incluso modelli open-source tramite Ollama. In sostanza, LibreChat fornisce un’esperienza di chat familiare (interfaccia di dialogo con cronologia, messaggi utente e assistente) mentre ti permette di collegare diversi fornitori di modelli sul backend.

LibreChat supporta interazione con documenti e RAG tramite un add-on chiamato RAG API e servizi di embedding. Nell’interfaccia, puoi utilizzare funzionalità come “Chat with Files”, che ti permette di caricare documenti e poi porre domande su di essi. Dietro le quinte, questo utilizza embedding e un archivio vettoriale per recuperare contesto rilevante dai tuoi file. Questo significa che puoi ottenere un effetto simile a ChatGPT + conoscenza personalizzata, tutto localmente. Il progetto fornisce anche un repository separato per il servizio RAG se desideri self-hostarlo.

L’uso di LibreChat con Ollama tipicamente coinvolge l’esecuzione del server LibreChat (ad esempio tramite Node/Docker) e assicurare che possa raggiungere il servizio Ollama. LibreChat ha un’impostazione “Custom Endpoint” dove puoi inserire un URL dell’API compatibile con OpenAI. Poiché Ollama può esporre un’API locale compatibile con OpenAI, LibreChat può essere puntato a http://localhost:11434 (o dove Ollama sta ascoltando). In effetti, LibreChat elenca Ollama esplicitamente tra i suoi fornitori AI supportati – insieme ad altri come OpenAI, Cohere, ecc. Una volta configurato, puoi selezionare il modello (modello di Ollama) in un menu a discesa e chattare. LibreChat consente anche di passare tra modelli o fornitori anche durante la conversazione e supporta diversi preset di chat/contesti.

Punti di forza: Il principale vantaggio di LibreChat è l’ampia gamma di funzionalità costruite intorno all’esperienza di chat. Include cose come ramificazione della conversazione, ricerca dei messaggi, supporto integrato Code Interpreter (esecuzione sicura di codice in sandbox), e integrazioni di strumenti/agenti. È essenzialmente ChatGPT++, con la capacità di integrare modelli locali. Per chi apprezza l’interfaccia di ChatGPT, LibreChat sembrerà molto familiare e richiederà poco apprendimento. Il progetto è attivo e community-driven (come dimostrato dalle sue frequenti aggiornamenti e discussioni), e è molto flessibile: puoi connettermi a molti tipi di endpoint LLM o persino eseguirlo multi-utente con autenticazione per un ambiente di team.

Limitazioni: Con le sue molte funzionalità, LibreChat può essere più pesante da eseguire. L’installazione potrebbe richiedere di impostare un database per archiviare le chat e configurare variabili ambiente per diversi API. Se abiliti tutti i componenti (RAG, agenti, generazione immagini, ecc.), è una stack abbastanza complessa. Per un singolo utente che ha bisogno solo di una chat base con un singolo modello locale, LibreChat potrebbe essere troppo. Inoltre, l’interfaccia, sebbene familiare, non è particolarmente specializzata per Q&A sui documenti – fa il lavoro ma manca di un’interfaccia dedicata “libreria documenti” (i caricamenti sono tipicamente fatti all’interno di una chat o tramite API). In breve, LibreChat eccelle quando si desidera un ambiente simile a ChatGPT con una gamma di funzionalità in esecuzione localmente, ma soluzioni più semplici potrebbero bastare per casi d’uso focalizzati.

AnythingLLM (App desktop o server completa)

AnythingLLM è un’applicazione AI completa che si concentra su RAG e facilità d’uso. Ti permette di “chattare con i tuoi documenti” utilizzando modelli open-source LLM o persino modelli di OpenAI, tutto attraverso un’unica interfaccia unificata. Notevolmente, AnythingLLM è disponibile sia come app desktop multi-piattaforma (per Windows, Mac, Linux) e come server self-hosted (tramite Docker). Questa flessibilità significa che puoi eseguirlo come un’applicazione normale sul tuo PC, o deployarlo per più utenti su un server.

La gestione dei documenti è al centro di AnythingLLM. Puoi trascinare e rilasciare documenti (PDF, TXT, DOCX, ecc.) nell’app, e automaticamente li indizierà in un database vettoriale (viene fornito LanceDB di default). Nell’interfaccia di chat, quando poni domande, recupererà frammenti rilevanti dai tuoi documenti e fornirà risposte citate, così sai da quale file e sezione proviene l’informazione. Essenzialmente, costruisce una base di conoscenza privata per te e permette all’LLM di utilizzarla come contesto. Puoi organizzare i documenti in “workspace” (ad esempio, un workspace per progetto o argomento), isolando i contesti necessari.

L’uso di Ollama con AnythingLLM è semplice. Nella configurazione, scegli Ollama come provider LLM. Se si esegue tramite Docker, imposta le variabili ambiente come LLM_PROVIDER=ollama e fornisce OLLAMA_BASE_PATH (l’URL della tua istanza Ollama). Il server AnythingLLM invierà quindi tutte le query del modello a Ollama’s API. Ollama è ufficialmente supportato, e le note documentative indicano che puoi sfruttarlo per eseguire vari modelli open (come Llama 2, Mistral, ecc.) localmente. In effetti, gli sviluppatori sottolineano che combinare AnythingLLM con Ollama sblocca potenti capacità di RAG offline: Ollama gestisce l’inferenza del modello, e AnythingLLM gestisce gli embedding e la logica dell’interfaccia/agenti.

Punti di forza: AnythingLLM fornisce una soluzione completa per Q&A privati e chat. I punti di forza principali includono: un’installazione facile per RAG (il lavoro pesante di embedding e archiviazione vettoriale è automatizzato), supporto multi-documento con citazione chiara delle fonti, e funzionalità aggiuntive come Agenti AI (ha un costruttore di agenti senza codice dove puoi creare workflow personalizzati e utilizzo di strumenti). È anche multi-utente di default (soprattutto in modalità server), con account utente e permessi se necessario. L’interfaccia è progettata per essere semplice (chat box + sidebar di documenti/workspaces) ma potente sotto il cofano. Per l’uso personale, l’app desktop è un grande vantaggio – ottieni un’app nativa senza dover aprire un browser o eseguire comandi, e archivia i dati localmente per default.

Limitazioni: Poiché integra molti componenti (API LLM, modelli di embedding, database vettoriale, ecc.), AnythingLLM può essere intensivo in termini di risorse. Quando inghiotti documenti, potrebbe richiedere tempo e memoria per generare gli embedding (supporta persino l’utilizzo di Ollama stesso o modelli locali per gli embedding con modelli come nomic-embed). L’app desktop semplifica l’uso, ma se hai molti documenti o file molto grandi, aspettati un elaborazione pesante in background. Un’altra limitazione è che gli utenti avanzati potrebbero trovare meno configurabile rispetto all’assemblare il proprio stack – ad esempio, utilizza LanceDB o Chroma; se volevi un altro database vettoriale, dovresti immergerti nella configurazione o nel codice. Inoltre, sebbene supporti multi-fornitori, l’interfaccia è veramente orientata a un modello alla volta (cambieresti l’impostazione globale del fornitore se volessi usare un modello diverso). In sintesi, AnythingLLM è una soluzione eccellente pronta all’uso per la chat locale con documenti, specialmente con Ollama, ma è un’applicazione più grande da eseguire rispetto a UI minimali.

Chat-with-Notes (UI minimale per chat con documenti)

Chat-with-Notes è un’applicazione minimalista specificamente progettata per chattare con file di testo locali utilizzando modelli gestiti da Ollama. È essenzialmente un server web leggero Flask che esegui sul tuo PC, fornendo una semplice pagina web dove puoi caricare un documento e iniziare una chat su di esso. L’obiettivo di questo progetto è la semplicità: non ha molte funzionalità extra, ma fa il lavoro core di rispondere alle domande sui documenti con un LLM locale.

L’uso di Chat-with-Notes richiede prima di assicurarti che l’istanza Ollama stia eseguendo un modello (ad esempio, potresti avviare Ollama con ollama run llama2 o un altro modello). Poi avvii l’app Flask (python app.py) e apri il sito web locale. L’interfaccia ti chiederà di caricare un file (i formati supportati includono testo semplice, Markdown, file di codice, HTML, JSON e PDF). Una volta caricato, il contenuto del file viene visualizzato e puoi porre domande o chattare con l’AI su quel contenuto. La conversazione avviene in un formato tipico di chat bubble. Se carichi un nuovo file durante la conversazione, l’app ti chiederà se vuoi iniziare una chat fresca o mantenere il contesto attuale e aggiungere solo le informazioni del nuovo file. In questo modo, puoi parlare di diversi file in sequenza se necessario. Ci sono anche pulsanti per cancellare la chat o esportare la conversazione in un file di testo.

Sotto il cofano, Chat-with-Notes interroga l’API di Ollama per generare risposte. Ollama gestisce l’inferenza del modello, e Chat-with-Notes fornisce solo il prompt (che include parti rilevanti del testo caricato). Non utilizza un database vettoriale; invece, invia semplicemente l’intero contenuto del file (o frammenti di esso) insieme alla tua domanda al modello. Questo approccio funziona meglio per documenti di dimensioni ragionevoli che si adattano alla finestra di contesto del modello.

Punti di forza: L’app è estremamente semplice da deployare e utilizzare. Non c’è una configurazione complessa – se hai Python e Ollama configurati, puoi farlo funzionare in un paio di minuti. L’interfaccia è pulita e minimalista, focalizzata sul contenuto testuale e sul Q&A. Poiché è così focalizzata, assicura che tutti i dati rimangano locali e solo in memoria (nessun richiamo esterno tranne a Ollama su localhost). È una grande scelta se desideri specificamente chattare con file e non hai bisogno di conversazioni generali senza un documento.

Limitazioni: La minimalità di Chat-with-Notes significa che mancano molte funzionalità presenti in altre interfacce. Ad esempio, non supporta l’uso di diversi modelli o fornitori (è progettata per essere Ollama-only), e non mantiene una libreria a lungo termine di documenti – carichi i file come necessario per sessione, e non c’è un indice vettoriale persistente. L’adattamento a documenti molto grandi potrebbe essere problematico senza aggiustamenti manuali, poiché potrebbe cercare di includere molto testo nel prompt. Inoltre, l’interfaccia, sebbene funzionale, non è così raffinata (nessun modo scuro, nessun formattazione ricca delle risposte, ecc.). In sostanza, questo strumento è ideale per analisi rapide e uniche di file con un modello Ollama. Se le tue esigenze crescono (ad esempio, molti documenti, o desiderio di un’interfaccia più ricca), potresti superare Chat-with-Notes. Ma come punto di partenza o una soluzione personale “chiedi al mio PDF” sopra Ollama, è molto efficace.

Conclusione

Ogni uno di questi UI open-source può migliorare la tua esperienza con i modelli locali Ollama fornendo un’interfaccia di chat user-friendly e capacità extra come la risposta alle domande sui documenti. La scelta migliore dipende dalle tue esigenze e comfort tecnico:

- Per un setup rapido e utilizzo nel browser: Page Assist è una buona scelta, integrandosi direttamente nella tua navigazione web con poca fatica.

- Per un ambiente web app completo: Open WebUI o LibreChat offrono funzionalità estese e flessibilità multi-modello, adatti agli utenti avanzati o a setup multi-utente.

- Per un’alternativa a ChatGPT ben raffinata con potenziale plugin: LobeChat fornisce un buon equilibrio tra usabilità e funzionalità in un pacchetto self-hosted.

- Per interazioni focalizzate sui documenti: AnythingLLM fornisce una soluzione completa (soprattutto se ti piace avere un’app desktop), mentre Chat-with-Notes offre un approccio minimalista per le Q&A su singoli documenti.

Poiché tutti questi strumenti sono attivamente mantenuti, puoi aspettarti miglioramenti e supporto della comunità. Scegliendo uno di questi UI, sarai in grado di chattare con i tuoi modelli Ollama locali in modo conveniente – sia che stia analizzando documenti, coding con assistenza, o semplicemente abbia un AI conversazionale disponibile senza dipendenze cloud. Ogni soluzione sopra è open-source, quindi puoi personalizzarle ulteriormente per le tue esigenze o anche contribuire allo sviluppo.

Per vedere come Ollama locale più queste UI si adatta ad altre opzioni locali e cloud, consulta la nostra guida LLM Hosting: Local, Self-Hosted & Cloud Infrastructure Compared.

Buone chat con il tuo LLM locale!