Modèles d'embedding et de reranking Qwen3 sur Ollama : des performances de pointe

Nouveaux LLM impressionnants disponibles dans Ollama

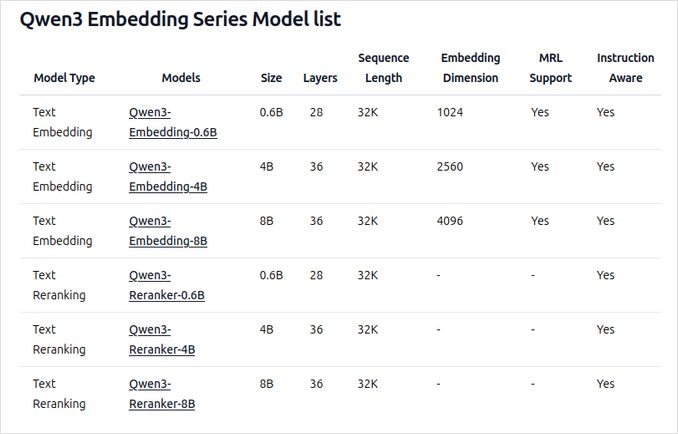

Les modèles Qwen3 Embedding et Reranker sont les dernières publications de la famille Qwen, conçues spécifiquement pour les tâches avancées d’incorporation de texte (embedding), de récupération et de reranking.

Un régal pour les yeux

Les modèles Qwen3 Embedding et Reranker représentent une avancée significative dans le traitement du langage naturel (NLP) multilingue, offrant des performances de pointe dans les tâches d’incorporation de texte et de reranking. Ces modèles, faisant partie de la série Qwen développée par Alibaba, sont conçus pour supporter une large gamme d’applications, de la recherche sémantique à la recherche de code. Ce type de capacité d’incorporation est fondamental pour la construction de systèmes RAG efficaces, comme détaillé dans le Tutoriel sur la Génération par Récupération Augmentée (RAG) : Architecture, Mise en œuvre et Guide de Production. Bien que Ollama soit une plateforme open-source populaire pour l’hébergement et le déploiement de grands modèles de langage (LLM), l’intégration des modèles Qwen3 avec Ollama n’est pas explicitement détaillée dans la documentation officielle. Cependant, les modèles sont accessibles via Hugging Face, GitHub et ModelScope, permettant un déploiement local potentiel via Ollama ou des outils similaires.

Exemples d’utilisation de ces modèles

Veuillez consulter le code exemple en Go utilisant ollama avec ces modèles :

- Reranking de documents textuels avec Ollama et le modèle Qwen3 Embedding - en Go

- Reranking de documents textuels avec Ollama et le modèle Qwen3 Reranker - en Go

Aperçu des nouveaux modèles Qwen3 Embedding et Reranker sur Ollama

Ces modèles sont désormais disponibles pour le déploiement sur Ollama dans diverses tailles, offrant des performances de pointe et une flexibilité pour une large gamme d’applications liées au langage et au code.

Fonctionnalités et capacités clés

-

Tailles de modèles et flexibilité

- Disponibles en plusieurs tailles : 0,6B, 4B et 8B paramètres pour les tâches d’incorporation et de reranking.

- Le modèle d’incorporation de 8B se classe actuellement N°1 sur le tableau de bord multilingue MTEB (au 5 juin 2025, avec un score de 70,58).

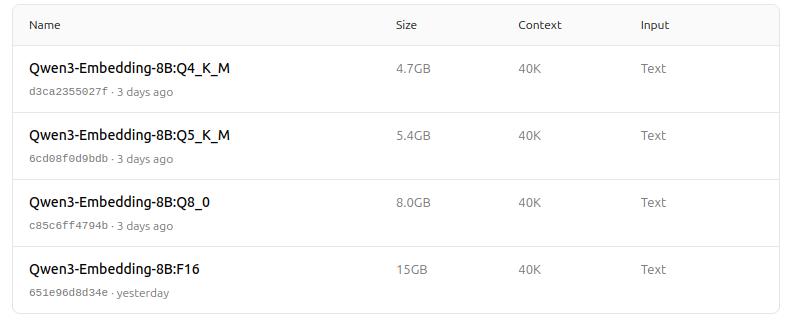

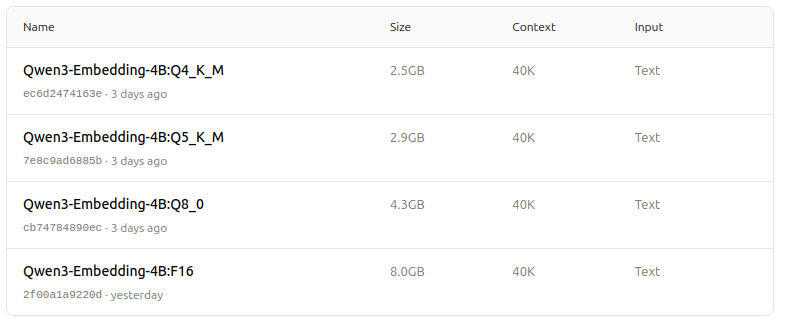

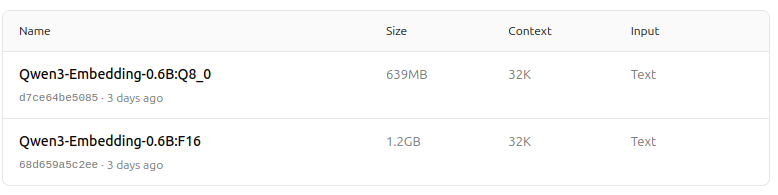

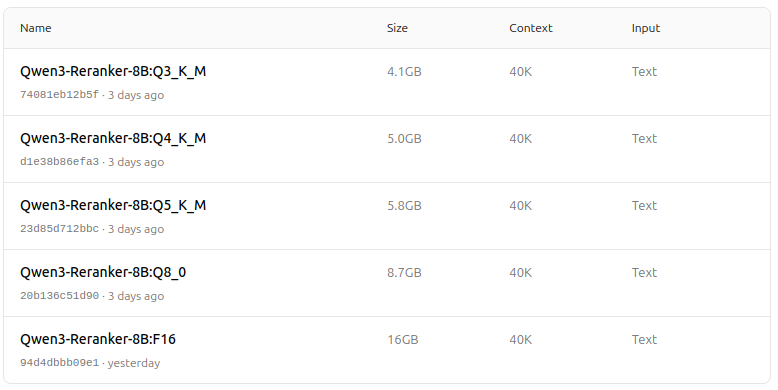

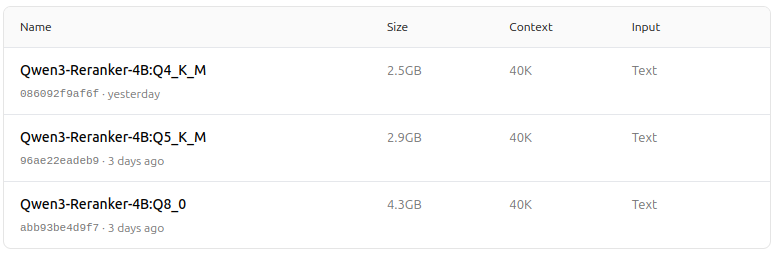

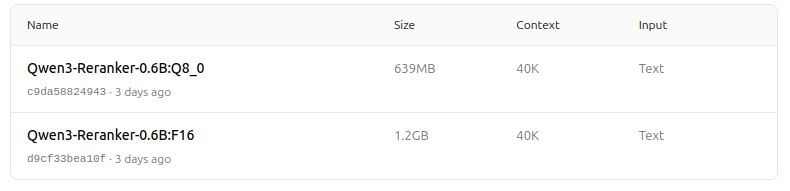

- Prend en charge une gamme d’options de quantification (Q4, Q5, Q8, etc.) pour équilibrer les performances, l’utilisation de la mémoire et la vitesse. Q5_K_M est recommandé pour la plupart des utilisateurs car il préserve la majorité des performances du modèle tout en étant économe en ressources.

-

Architecture et formation

- Construits sur la base Qwen3, exploitant à la fois les architectures d’encodeur double (pour les incorporations) et d’encodeur croisé (pour le reranking).

- Modèle d’incorporation : Traite des segments de texte uniques, extrayant les représentations sémantiques à partir de l’état caché final.

- Modèle Reranker : Prend des paires de texte (par exemple, requête et document) et produit un score de pertinence en utilisant une approche d’encodeur croisé.

- Les modèles d’incorporation utilisent un paradigme d’entraînement en trois étapes : pré-entraînement contrastif, entraînement supervisé avec des données de haute qualité et fusion de modèles pour une généralisation et une adaptabilité optimales.

- Les modèles Reranker sont entraînés directement avec des données étiquetées de haute qualité pour l’efficacité et l’efficience.

-

Support multilingue et multitâche

- Prend en charge plus de 100 langues, y compris les langages de programmation, permettant des capacités robustes de recherche multilingue, interlingue et de code.

- Les modèles d’incorporation permettent des définitions de vecteurs flexibles et des instructions définies par l’utilisateur pour adapter les performances à des tâches ou langues spécifiques.

- Pour les applications nécessitant des capacités multimodales au-delà du texte, voir Incorporations inter-modales : Relier les modalités IA.

-

Performances et cas d’usage

- Résultats de pointe dans la récupération de texte, la récupération de code, la classification, le regroupement (clustering) et l’extraction de bitextes.

- Les modèles Reranker excellent dans divers scénarios de récupération de texte et peuvent être combinés de manière transparente avec les modèles d’incorporation pour des pipelines de récupération de bout en bout.

Comment utiliser sur Ollama

Vous pouvez exécuter ces modèles sur Ollama avec des commandes comme :

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

Choisissez la version de quantification qui correspond le mieux à vos besoins matériels et de performances.

Mise à jour décembre 2025 : Maintenant, Ollama fournit des modèles d’incorporation Qwen3 standards, depuis son propre dépôt, et non pas celui de dengcao :

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

Voir plus : https://ollama.com/library/qwen3-embedding

Tableau récapitulatif

| Type de modèle | Tailles disponibles | Forces clés | Support multilingue | Options de quantification |

|---|---|---|---|---|

| Embedding | 0.6B, 4B, 8B | Meilleurs scores MTEB, flexible, efficace, SOTA | Oui (+100 langues) | Q4, Q5, Q6, Q8, etc. |

| Reranker | 0.6B, 4B, 8B | Excellente pertinence des paires de texte, efficace, flexible | Oui | F16, Q4, Q5, etc. |

Excellentes nouvelles !

Les modèles Qwen3 Embedding et Reranker sur Ollama représentent un bond significatif dans les capacités de récupération de texte et de code multilingues et multitâches. Avec des options de déploiement flexibles, de solides performances dans les tests de référence et un support pour une large gamme de langues et de tâches, ils sont parfaitement adaptés aux environnements de recherche et de production.

Zoo de modèles - un régal pour les yeux maintenant

Qwen3 Embedding

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

Qwen3 Reranker

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

Super !

Liens utiles

- Reranking de documents textuels avec Ollama et le modèle Qwen3 Embedding - en Go

- Reranking de documents textuels avec Ollama et le modèle Qwen3 Reranker - en Go

- Fiche de référence Ollama

- Déplacer les modèles Ollama vers un autre lecteur ou dossier

- Auto-hébergement de Perplexica - avec Ollama

- Test : Comment Ollama utilise les cœurs de performance et efficaces du CPU Intel

- Comparaison des performances de vitesse des LLM

- Comparaison des capacités de résumé des LLM

- Fournisseurs LLM Cloud

- Comment Ollama gère les demandes parallèles

- Comparaison de la qualité de traduction de page Hugo - LLMs sur Ollama