PostgreSQL 풀 텍스트 검색과 Elasticsearch 비교

하나의 데이터베이스 또는 진정한 검색 스택

실제 논쟁의 핵심은 PostgreSQL 이 텍스트를 검색할 수 있는지, 혹은 Elasticsearch 가 문서를 저장할 수 있는지 여부입니다. 둘 다 가능합니다. 흥미로운 질문은 검색의 복잡성이 어디에 존재해야 하는가입니다.

하나의 데이터베이스 또는 진정한 검색 스택

실제 논쟁의 핵심은 PostgreSQL 이 텍스트를 검색할 수 있는지, 혹은 Elasticsearch 가 문서를 저장할 수 있는지 여부입니다. 둘 다 가능합니다. 흥미로운 질문은 검색의 복잡성이 어디에 존재해야 하는가입니다.

경보는 소음 시스템이 아닌 응답 시스템입니다.

알람 (Alerting) 은 너무 자주 모니터링 기능으로 묘사됩니다. 그런 틀을 잡는 것은 편리하지만, 실제 문제를 가립니다.

시스템용 제어 평면으로서의 채팅 플랫폼

채팅 플랫폼은 단순한 메시징 도구를 넘어 크게 진화했습니다. 현대 시스템에서는 자동화된 프로세스와 인간의 의사 결정 사이를 잇는 인터페이스로 작동합니다.

디스코드를 안전하고 상호작용 가능한 알림 버스(Alert Bus)로 만드세요.

Discord 는 이를 하나의 시스템으로 대할 때 진정한 통합 표면이 됩니다: 시스템이 이벤트를 게시하고, 인간이 결정을 내리며, 자동화가 워크플로우를 이어가는 곳입니다.

Slack 는 워크플로우 UI 와 알림 전송 레이어입니다.

Slack 통합은 하나의 HTTP 호출로 메시지를 게시할 수 있기 때문에 속임수처럼 보일 정도로 간단해 보입니다. 하지만 Slack 을 상호작용적이고 신뢰할 수 있는 시스템으로 만들려고 할 때 흥미로운 부분이 시작됩니다.

통합, 코드 구조 및 데이터 액세스를 위한 패턴.

대부분의 앱 아키텍처 조언은 적용하기엔 너무 추상적이거나 확장하기엔 너무 제한적입니다. 여기 통합, 코드 구조, 데이터 접근에 걸쳐 프로덕션 시스템에 적용할 수 있는 실용적인 절충안들이 있습니다.

클로드 구독은 더 이상 에이전트를 구동하지 않습니다

에이전트 실험의 물결을 이끈 조용한 루트가 이제 막혔습니다.

로컬 LLM을 활용한 자체 호스팅 AI 검색

Vane 은 “인용된 AI 검색” 분야에서 더 실용적인 솔루션 중 하나입니다. 이는 실시간 웹 검색과 로컬 또는 클라우드 LLM 을 결합하면서도 전체 스택을 사용자의 통제 하에 두는 자체 호스팅형 답변 엔진입니다.

로컬 모델 백엔드를 갖춘 에이전틱 코딩

Claude Code는 마케팅만 뛰어난 자동 완성 도구가 아닙니다. 이것은 에이전트 기반 코딩 도구입니다. 코드베이스를 읽고, 파일을 편집하며, 명령을 실행하고, 개발 도구와 통합됩니다.

개발자를 위한 Hermes 에이전트 설치 및 빠른 시작

Hermes 에이전트는 로컬 머신이나 저가형 VPS에서 실행되는 자체 호스팅(self-hosted) 및 모델에 구애받지 않는 AI 어시스턴트입니다. 터미널과 메시징 인터페이스를 통해 작동하며, 반복적인 작업을 재사용 가능한 스킬(skill)로 변환함으로써 시간이 지남에 따라 지속적으로 성능을 개선합니다.

TGI 를 설치하고 빠르게 배포하며 더 빠르게 디버깅하세요.

Text Generation Inference(TGI) 는 매우 특유의 에너지를 지니고 있습니다. 추론 분야에서 가장 새로운 기술은 아니지만, 이미 프로덕션 환경에서 발생하는 문제를 잘 이해하고 있습니다.

16GB VRAM에서의 llama.cpp 토큰 속도 (표).

VRAM 16GB GPU 에서 여러 LLM 의 속도를 비교하고, 자체 호스팅에 가장 적합한 모델을 선택했습니다.

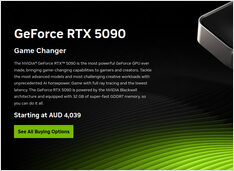

호주에서는 RTX 5090 가 품귀 현상을 보이고 가격이 비쌉니다.

호주에 RTX 5090 재고가 있습니다. 마침내. 하지만 하나를 찾아도 현실과 동떨어진 프리미엄 가격을 지불해야 합니다.

공용 포트를 사용하지 않는 원격 Ollama 접근

Ollama 는 로컬 데몬 (daemon) 으로 취급될 때 가장 행복해합니다: CLI 와 애플리케이션이 루프백 HTTP API 와 통신하며, 나머지 네트워크는 Ollama 의 존재를 전혀 알지 못합니다.

트레이스에 연결되는 쿼리 가능한 JSON 로그

로그는 시스템이 화재 상태일 때도 여전히 사용할 수 있는 디버깅 인터페이스입니다. 문제는 평문 텍스트 로그는 시간이 지날수록 관리하기 어려워진다는 점입니다. 필터링, 집계, 알림이 필요해지자마자 문장을 파싱하게 됩니다.

GPU 와 영속성을 갖춘 Compose 우선 Ollama 서버

Ollama 는 베어 메탈 (bare metal) 환경에서 훌륭하게 작동합니다. 이를 서비스처럼 다룰 때 더욱 흥미로운데, 안정적인 엔드포인트, 고정된 버전, 영구 저장소, 그리고 GPU 가 있거나 없는 명확한 상태를 보장받기 때문입니다.

시스템, 인프라, AI 엔지니어링에 관한 새 글을 받아보세요.