자체 호스팅 Perplexica - Ollama와 함께

로컬에서 코파일럿 스타일 서비스를 실행하나요? 간단하죠!

이것은 매우 흥미로운 일입니다!

Copilot이나 perplexity.ai를 호출하고 세상에 당신이 무엇을 원하는지 말하는 대신,

이제 자신의 PC나 강력한 노트북에서 유사한 서비스를 호스팅할 수 있습니다!

로컬에서 코파일럿 스타일 서비스를 실행하나요? 간단하죠!

이것은 매우 흥미로운 일입니다!

Copilot이나 perplexity.ai를 호출하고 세상에 당신이 무엇을 원하는지 말하는 대신,

이제 자신의 PC나 강력한 노트북에서 유사한 서비스를 호스팅할 수 있습니다!

논리적 오류 탐지 테스트

최근 몇몇 새로운 LLM이 출시되었습니다. 흥미로운 시기입니다. 논리적 오류를 감지하는 데 이 모델들이 어떻게 수행되는지 테스트해 보겠습니다.

일부 실험을 필요로 하지만

아직도 LLM이 당신이 원하는 것을 이해하려고 애를 쓰지 않도록 하기 위해 효과적인 프롬프트를 작성하는 데 사용되는 일반적인 접근 방법이 몇 가지 있습니다.

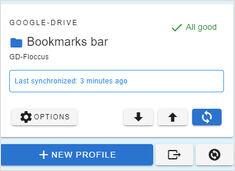

노트북과 브라우저 간 북마크를 동기화하려고 하시나요?

다양한 도구를 사용해보았고, 그 중에서도 floccus를 가장 좋아하게 되었습니다.

자주 사용되는 파이썬 코드 조각

가끔은 필요하지만 바로 찾기 어려운 경우가 있습니다.

그래서 모두 여기에 모아두었습니다.

레이블링 및 훈련에는 일정한 접착이 필요하다.

언제 제가 object detector AI 훈련 했을 때, LabelImg는 매우 유용한 도구였지만, Label Studio에서 COCO 형식으로 내보내는 것이 MMDetection 프레임워크에 의해 수용되지 않았습니다.

8개의 llama3 (Meta+) 및 5개의 phi3 (Microsoft) LLM 버전

다양한 파라미터 수와 양자화된 모델들이 어떻게 작동하는지 테스트해보았습니다.

Ollama LLM 모델 파일은 많은 공간을 차지합니다.

ollama 설치 후에는 즉시 ollama를 재구성하여 새 위치에 저장하는 것이 좋습니다.

이렇게 하면 새로운 모델을 끌어다 사용할 때 이전 위치에 다운로드되지 않습니다.

모든那些 광고를 보는 건 정말 짜증나요

구글 크롬, 파이어폭스, 사파리 등에서 브라우저 광고 차단 플러그인 또는 애드온을 설치할 수 있지만, 각 기기에서 따로 설정해야 합니다. 네트워크 전체에 걸쳐 광고를 차단하는 방법은 제일 좋아하는 해결책입니다.

매우 빈번한 오류 메시지...

깃 저장소를 클론한 후, 로컬 저장소 설정을 수행하되, 특히 사용자 이름과 이메일 주소를 설정해야 합니다.

GPU 대 CPU에서 LLM의 속도를 테스트해 보겠습니다.

다양한 버전의 LLM(llama3, phi3, gemma, mistral)의 예측 속도를 CPU와 GPU에서 비교합니다.

다양한 LLM의 논리적 오류 탐지 품질을 테스트해 보겠습니다.

여기에서 저는 여러 LLM 버전을 비교하고 있습니다: Llama3 (Meta), Phi3 (Microsoft), Gemma (Google), Mistral Nemo(Mistral AI), Qwen(Alibaba).

이 어려운 시기에 어떤 일이든 일어날 수 있습니다.

데이터베이스, 파일 저장소, 기타 Gitea 관련 파일 등을 백업해야 합니다. 바로 시작합니다.

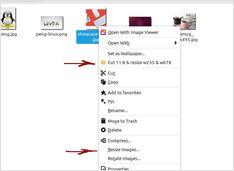

가끔은 그곳에 항목을 추가하기만 하면 됩니다...

이 블로그에 사용되는 이미지에 대한 자르기, 크기 조정, 테두리 추가 작업은 Linux Mint Cinnamon의 컨텍스트 메뉴에 이 자주 사용되는 기능을 추가하게 만들었습니다.

추운 겨울 밤에 이렇게 따뜻한 것이 정말 감사합니다.

이 음료는 “Glintwein"으로 알고 있었지만, 영어로는 더 흔히 “Mulled Wine"이라고 불립니다.

재료가 많고 원래의 맛이 특별해서 정말 좋아요!

일부 도구의 명령줄 매개변수

이 목록은 매우 포괄적이지 않으며, 저에게 유용한 것들만 포함되어 있습니다.