molntjänstleverantörer för LLM

Kort lista över LLM-leverantörer

Användning av LLM:er är inte särskilt kostsam, det kan inte behövas köpa nya fantastiska GPU:er. Här är en lista över LLM-leverantörer i molnet med LLM:er de värdar.

Kort lista över LLM-leverantörer

Användning av LLM:er är inte särskilt kostsam, det kan inte behövas köpa nya fantastiska GPU:er. Här är en lista över LLM-leverantörer i molnet med LLM:er de värdar.

Ollama på Intel CPU: Effektivitet vs prestandaenheter

Jag har en teori att testa – om man använder alla kärnor på Intel CPU skulle det öka hastigheten hos LLMs? Det är irriterande att den nya gemma3 27-bit model (gemma3:27b, 17GB på ollama) inte passar in i min GPU:s 16GB VRAM och delvis kör på CPU.

AI kräver mycket kraft...

I mitt håll i den moderna världens kaos här är jag jämförande tekniska specifikationer av olika kort som är lämpliga för AI uppgifter (Deep Learning, Objektidentifiering och LLM). De är alla otroligt dyra dock.

Konfigurera ollama för parallell exekvering av begäranden.

När Ollama-servern får två begäranden samtidigt, beror dess beteende på dess konfiguration och tillgängliga systemresurser.

AI-assisterad kodning där du beskriver istället för att skriva.

Vibe coding är ett AI-drivet programmeringssätt där utvecklare beskriver önskad funktionalitet på naturligt språk och låter AI-verktyg generera koden automatiskt – med minimal direkt kodning.

Jämföra två deepseek-r1-modeller med två basmodeller

DeepSeek’s första generation av resonemodeller med jämförbar prestanda med OpenAI-o1, inklusive sex tätmodeller distillerade från DeepSeek-R1 baserade på Llama och Qwen.

Uppdaterad kommandolista för Ollama – ls, ps, run, serve m.fl.

Denna Ollama CLI-snabbkurs fokuserar på kommandon du använder varje dag (ollama ls, ollama serve, ollama run, ollama ps, hantering av modeller och vanliga arbetsflöden), med exempel du kan kopiera och klistra in.

Nästa omgång av LLM-testerna

Inte för länge sedan släpptes. Låt oss uppdatera och

testa hur Mistral Small presterar jämfört med andra LLMs.

En pythonkod för RAG-omrankning

Nyckelfull ny AI-modell för att skapa bilder från text

Nyligen publicerade Black Forest Labs en uppsättning text-till-bild AI-modeller. Dessa modeller sägs ha mycket högre utdata kvalitet. Låt oss prova dem

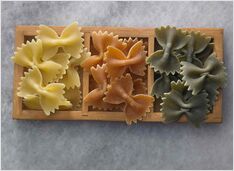

Jämförelse av två självhuserade AI-sökmotorer

Underbar mat är också en njutning för ögonen. Men i detta inlägg jämför vi två AI-baserade söksystem, Farfalle och Perplexica.

Kör en Copilot-tjänst lokalt? Det är enkelt!

Det är väldigt spännande! Istället för att ringa Copilot eller perplexity.ai och berätta för hela världen vad du letar efter, kan du nu värdshålla en liknande tjänst på din egen PC eller bärbara dator!

Testa upptäckt av logiska fall

Nyligen har vi sett flera nya LLM:er släppas. Spännande tider. Låt oss testa och se hur de presterar när de upptäcker logiska fall.

Kräver lite experimenterande men

Även om det finns några vanliga metoder för att skriva bra instruktioner så att LLM inte blir förvirrad när den försöker förstå vad du vill ha av den.

8 llama3 (Meta+) och 5 phi3 (Microsoft) LLM-versioner

Testa hur modeller med olika antal parametrar och kvantisering beter sig.

Ollama LLM-modellfiler tar mycket plats.

Efter att ha installerat Ollama är det bättre att omedelbart omkonfigurera Ollama så att den lagrar modellerna på en ny plats. Så när vi drar ner en ny modell, laddas den inte ner till den gamla platsen.