Farfalle vs Perplexica

Jämförelse av två självhämtade AI-sökmotorer

Läcker mat är också en njutning för ögonen. Men i den här posten kommer vi att jämföra två AI-baserade söksystem, Farfalle och Perplexica.

Jämförelse av två självhämtade AI-sökmotorer

Läcker mat är också en njutning för ögonen. Men i den här posten kommer vi att jämföra två AI-baserade söksystem, Farfalle och Perplexica.

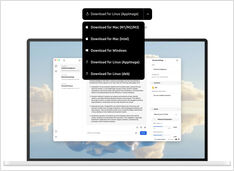

Kör en copilot-stil tjänst lokalt? Enkelt!

Det är mycket spännande! I stället för att anropa copilot eller perplexity.ai och berätta för hela världen vad du eftersträvar, kan du nu värd en liknande tjänst på din egen dator eller laptop!

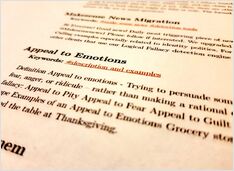

Testa upptäckt av logiska fall

Nyligen har vi sett flera nya LLM:er släppas. Spännande tider. Låt oss testa och se hur de presterar när de upptäcker logiska fall.

Inte så många att välja mellan men ändå...

När jag började experimentera med LLMs var gränssnitten för dem i aktiv utveckling och nu är några av dem verkligen bra.

Kräver lite experimenterande men

Även om det finns några vanliga metoder för att skriva bra instruktioner så att LLM inte blir förvirrad när den försöker förstå vad du vill ha av den.

8 llama3 (Meta+) och 5 phi3 (Microsoft) LLM-versioner

Testa hur modeller med olika antal parametrar och kvantisering beter sig.

Ollama LLM-modellfilerna tar mycket utrymme

Efter att ha installerat ollama är det bättre att omkonfigurera ollama direkt så att de lagras i en ny plats. Så efter att vi hämtar en ny modell, kommer den inte att laddas ner till den gamla platsen.

Låt oss testa LLM:s hastighet på GPU jämfört med CPU

Jämförelse av förutsägelsehastighet hos flera versioner av LLMs: llama3 (Meta/Facebook), phi3 (Microsoft), gemma (Google), mistral (open source) på CPU och GPU.

Låt oss testa kvaliteten på logiska felslutdetektering hos olika LLMs

Här jämför jag flera LLM-versioner: Llama3 (Meta), Phi3 (Microsoft), Gemma (Google), Mistral Nemo (Mistral AI) och Qwen (Alibaba).