Ollama GPT-OSS Strukturerade utgångsproblem

Ingenstans särskilt fin.

Ollama’s GPT-OSS modeller har återkommande problem med att hantera strukturerad utdata, särskilt när de används med ramverk som LangChain, OpenAI SDK, vllm och andra.

Ingenstans särskilt fin.

Ollama’s GPT-OSS modeller har återkommande problem med att hantera strukturerad utdata, särskilt när de används med ramverk som LangChain, OpenAI SDK, vllm och andra.

Några sätt att få strukturerad utdata från Ollama

Stora språkmodeller (LLMs) är kraftfulla, men i produktion vill vi sällan ha fritt formulerade stycken. Istället vill vi ha förutsägbart data: attribut, fakta eller strukturerade objekt som du kan mata in i en app. Det är LLM Strukturerad Utdata.

Min egen test av ollama-modellplanering

Här jämför jag hur mycket VRAM den nya versionen av Ollama allokerar för modellen hur mycket VRAM den nya versionen av Ollama allokerar för modellen med den tidigare versionen av Ollama. Den nya versionen är sämre.

Min syn på den nuvarande utvecklingen av Ollama

Ollama har snabbt blivit en av de mest populära verktygen för att köra LLM:er lokalt. Dess enkla CLI och streamlina modellhantering har gjort det till ett förfrågat alternativ för utvecklare som vill arbeta med AI-modeller utanför molnet.

Snabb översikt över de mest framträdande UI:erna för Ollama år 2025

Lokalt värd Ollama möjliggör att köra stora språkmodeller på din egen dator, men att använda den via kommandoraden är inte användarvänligt. Här är flera öppen källkodprojekt som tillhandahåller ChatGPT-stilgränssnitt som ansluter till en lokal Ollama.

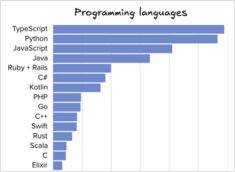

Jämförelse av mjukvaruutvecklingsverktyg och programmeringsspråk

The Pragmatic Engineer-nytt publicerade för några dagar sedan undersökningsstatistik om populariteten för programmeringsspråk, IDE:er, AI-verktyg och andra data för mitten av 2025.

I juli 2025 kommer det snart att vara tillgängligt.

Nvidia är på väg att släppa NVIDIA DGX Spark – en liten AI-superdator med Blackwell-arkitektur, 128+ GB enhetligt minne och 1 PFLOPS AI-prestation. En bra enhet att köra LLM på.

Implementerar du RAG? Här finns några kodexempel på Go – del 2...

Eftersom standard Ollama inte har en direkt rerank-API, behöver du implementera omrankning med Qwen3 Reranker i GO genom att generera inbäddningar (embeddings) för par av fråga-dokument och sedan betygsätta dem.

qwen3 8b, 14b och 30b, devstral 24b, mistral small 24b

I denna test jämför jag hur olika LLM:er som är värd på Ollama översätter Hugo-sidor från engelska till tyska: jämföra hur olika LLM:er värd på Ollama översätter Hugo-sida.

Implementerar du RAG? Här är några kodsnuttar i Golang..

Detta lilla Reranking-kodexempel i Go anropar Ollama för att generera inbäddningar för frågan och för varje kandidatdokument, och sorterar sedan i fallande ordning baserat på kosinussimilaritet.

Tänker du på att installera en andra GPU för LLM:er?

Hur påverkar PCIe-laner LLM-prestanda? Beroende på uppgiften. För träning och fler-GPU-inferens – prestandaförändringen är betydande.

LLM för att extrahera text från HTML...

I Ollama modellbiblioteket finns det modeller som kan konvertera HTML-innehåll till Markdown, vilket är användbart för innehållskonverteringsuppgifter. Den här guiden är en del av vår Dokumentationsverktyg 2026: Markdown, LaTeX, PDF & Skrivningsflöden hub.

Vilket AI-forskningsläge passar din uppgift?

Cursor AI jämfört med GitHub Copilot jämfört med Cline AI jämfört med...

Här listas några AI-assisterade kodverktyg och AI-kodassistenten samt deras fördelar.

Kort lista över LLM-leverantörer

Användning av LLM:er är inte särskilt kostsam, det kan inte behövas köpa nya fantastiska GPU:er. Här är en lista över LLM-leverantörer i molnet med LLM:er de värdar.

Ollama på Intel CPU: Effektivitet vs prestandaenheter

Jag har en teori att testa – om man använder alla kärnor på Intel CPU skulle det öka hastigheten hos LLMs? Det är irriterande att den nya gemma3 27-bit model (gemma3:27b, 17GB på ollama) inte passar in i min GPU:s 16GB VRAM och delvis kör på CPU.