Handledning om Retrieval-Augmented Generation (RAG): Arkitektur, implementering och guide för produktion

Från grundläggande RAG till produktion: uppdelning, vektorsökning, omrangering och utvärdering i en guide.

Denna tutorials för Retrieval-Augmented Generation (RAG) är en steg-för-steg-guide med fokus på produktion för att bygga verkliga RAG-system.

Om du söker efter:

- Hur man bygger ett RAG-system

- RAG-arkitektur förklarad

- RAG-tutorial med exempel

- Hur man implementerar RAG med vektordatabaser

- RAG med omrankning (reranking)

- RAG med webbsökning

- Bästa praxis för RAG i produktion

så befinner du dig på rätt ställe.

Denna guide sammanfattar praktisk kunskap om RAG-implementering, arkitektoniska mönster och optimeringstekniker som används i produktionsanvända AI-system.

Kort karta över RAG-klustret (Läs i denna ordning)

Om du vill ha den snabbaste vägen genom RAG-klustret, använd denna karta:

- Du är här: RAG-översikt + pipeline från början till slut (denna sida)

- Avsnittning (grund för hämtningens kvalitet): Strategier för avsnittning i RAG

- Vektorlagring (val av lagring och indexering): Jämförelse av vektorlagring för RAG

- Hämtningens djup (när “sökning” inte räcker): Sökning vs Djupsökning vs Djupforskning

- Omrankning (ofta största kvalitetsvinsten): Omrankning med inbäddningsmodeller

- Inbäddningar + omrankningsmodeller (praktiska implementeringar):

- Avancerade arkitekturer: Avancerade RAG-varianters: LongRAG, Self-RAG, GraphRAG

Vad är Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) är ett systemdesignmönster som kombinerar:

- Informationshämtning

- Kontextökning

- Generering med stora språkmodeller

Med enkla ord hämtar en RAG-pipeline relevanta dokument och injicerar dem i prompten innan modellen genererar ett svar.

Till skillnad från finjustering (fine-tuning) gör RAG:

- Att fungera med data som uppdateras ofta

- Stöd för privata kunskapsbaser

- Minskar hallucinationer

- Undviker omtränning av stora modeller

- Förbättrar svarens grundläggning

Moderna RAG-system innehåller mer än bara vektorsökning. En komplett RAG-implementering kan inkludera:

- Omformulering av frågor

- Hybrid sökning (BM25 + vektorsökning)

- Omrankning med cross-encoder

- Flerstegshämtning

- Integration av webbsökning

- Utvärdering och övervakning

Minimalt RAG-blåprynt för produktion (Referensimplementering)

Använd detta som en mental modell (och en startskiss) för RAG i produktion.

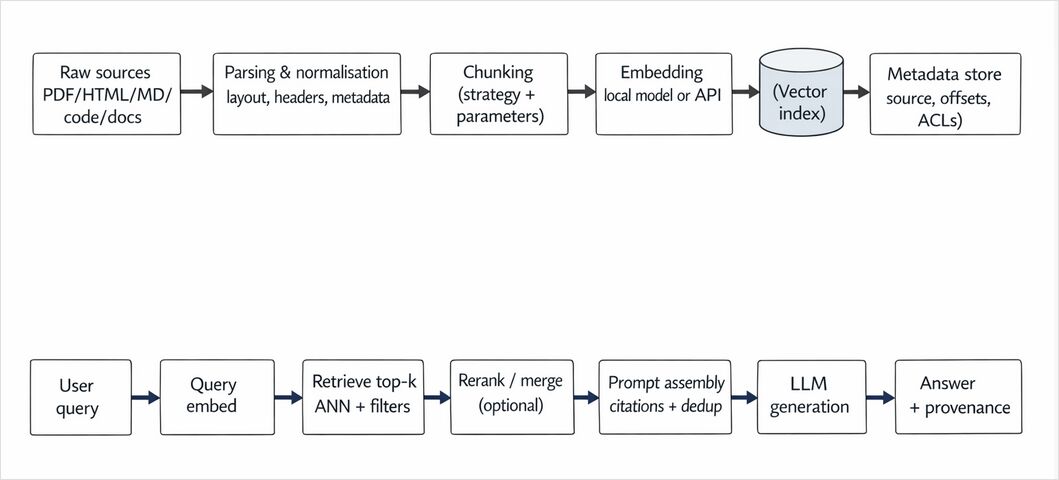

Inmatningspipeline (offline eller kontinuerlig)

- Samla källor (dokument, ärenden, webbsidor, PDF-filer, kod)

- Normalisera (extrahera text, rensa standardtext, ta bort dubletter)

- Avsnitta (välj strategi + överlappning + metadata)

- Inbädda (versionerade inbäddningar)

- Uppdatera i index (vektorlagring + metadatafält)

- Strategi för omindexering när inbäddningar eller avsnittning ändras

Frågepipeline (online)

- Parse / omformulera frågan (valfritt)

- Hämta kandidater (vektor eller hybrid + metadatafiltrering)

- Omranka topp-K med en cross-encoder / omrankningsmodell

- Samla ihop kontext (ta bort dubletter, sortera efter relevans, lägg till referenser)

- Generera med en grundad prompt (regler + vägranbeteende)

- Logga (hämtat set, omrankat set, slutlig kontext, latens, kostnad)

- Utvärdera (online/offline-harness)

Om du bara förbättrar en sak i ett fungerande RAG-system: lägg till omrankning och en utvärderingsharness.

Steg-för-steg RAG-tutorial: Hur man bygger ett RAG-system

Denna sektion beskriver ett praktiskt RAG-tutorials flöde för utvecklare.

Steg 1: Förbered och avsnitta dina data

Hämtningens kvalitet beror mycket på avsnittningsstrategi och indexdesign: bra RAG börjar med korrekt avsnittning.

Avsnittning bestämmer:

- Hämtningens återkallning (recall)

- Latens

- Kontextbrus

- Tokenkostnad

- Risk för hallucinationer

Vanliga RAG-avsnittningsstrategier inkluderar:

- Avsnittning med fast storlek

- Avsnittning med glidande fönster

- Semantisk avsnittning

- Rekursiv avsnittning

- Hierarkisk avsnittning

- Avsnittning med medvetenhet om metadata

Dålig avsnittning är en av de vanligaste orsakerna till dåligt presterande RAG-system.

För en rigorös, ingeniörsförsta djupdykning i avsnittningens avvägningar, utvärderingsdimensioner, beslutsmatriser och körbara Python-implementeringar, se:

Strategier för avsnittning i RAG: Alternativ, avvägningar och exempel

Den guiden täcker praktiska standardinställningar för:

- Frågesvarssystem

- Sammanfattningspipelines

- Kodsökning

- Multimodala dokument

- Ströminmatning

- Multimodala dokument med inbäddningar över modaliteter

Om du är allvarlig med RAG-prestation, läs den innan du justerar inbäddningar eller omrankning.

För multimodala RAG-system som broar text, bilder och andra modaliteter, utforska Inbäddningar över modaliteter: Att broa AI-modaliteter

Steg 2: Välj en vektordatabas för RAG

En vektordatabas lagrar inbäddningar för snabb likhetssökning.

Jämför vektordatabaser här:

Jämförelse av vektorlagring för RAG

När du väljer en vektordatabas för en RAG-tutorial eller ett produktionssystem, överväg:

- Indextyp (HNSW, IVF, etc.)

- Stöd för filtrering

- Implementeringsmodell (moln vs självhöst)

- Frågelatens

- Horisontell skalbarhet

- Krav på multi-uthyrning och åtkomstkontroll

Steg 3: Implementera hämtning (vektorsökning eller hybridsökning)

Grundläggande RAG-hämtning använder inbäddningslikhet.

Avancerad RAG-hämtning använder:

- Hybridsökning (vektor + nyckelord)

- Metadatafiltrering

- Hämtning från flera index

- Omformulering av frågor

För konceptuell förankring:

Sökning vs Djupsökning vs Djupforskning

Att förstå hämtningens djup är avgörande för högkvalitativa RAG-pipelines.

Steg 4: Lägg till omrankning i din RAG-pipeline

Omrankning är ofta den största kvalitetsförbättringen i en RAG-implementering.

Omrankning förbättrar:

- Precision

- Kontextens relevans

- Trovärdighet

- Signal-brus-förhållande

Lär dig omrankningstekniker:

- Omrankning med inbäddningsmodeller

- Qwen3 Inbäddning + Qwen3 Omrankare på Ollama

- Omrankning med Ollama + Qwen3 Inbäddning (Go)

- Omrankning med Ollama + Qwen3 Omrankare i Go

I produktionssystem för RAG spelar omrankning ofta en större roll än att byta till en större modell.

Steg 5: Integrera webbsökning (valfritt men kraftfullt)

Webbsökning med RAG möjliggör dynamisk kunskapsinhämtning.

Webbsökning är användbar för:

- Data i realtid

- Nysnälla AI-assistenters

- Konkurrensanalys

- Svar på frågor inom öppna domäner

Se praktiska implementeringar:

Steg 6: Bygg en RAG-utvärderingsram

En seriös RAG-tutorial måste inkludera utvärdering. Utan den blir optimering av ett RAG-system gissningsarbete.

Vad som ska mätas

| Lager | Vad som ska mätas | Varför det är viktigt |

|---|---|---|

| Inmatning | täckning av avsnitt, andel dubletter, version av inbäddning | förhindrar tyst drift |

| Hämtning | recall@k, precision@k, MRR/NDCG | berättar om du hämtar rätt bevis |

| Omrankning | delta i precision@k jämfört med baslinje | validerar omrankarens ROI |

| Generering | trovärdighet / grundläggning, noggrannhet i citat, kvalitet i vägran | minskar hallucinationer |

| System | latens p50/p95, kostnad per fråga, cache-hit-hastighet | håller produktionen användbar |

Minimal utvärderingsharness (praktisk checklista)

- Bygg en testset av frågor (verkliga användarfrågor om möjligt)

- För varje fråga, lagra:

- förväntat svar eller förväntade källor

- tillåtna källor (guld-dokument) när de finns tillgängliga

- Kör en offline-batch:

- hämta kandidater

- omranka

- generera

- poängsätt (hämtning + generering)

- Spårning av metrik över tid och misslyckas med bygget vid regressioner (även små)

Börja enkelt: 50–200 frågor räcker för att upptäcka stora regressioner.

Avancerade RAG-arkitekturer

När du förstått grundläggande RAG, utforska avancerade mönster:

Avancerade RAG-varianters: LongRAG, Self-RAG, GraphRAG

Avancerade arkitekturer för Retrieval-Augmented Generation möjliggör:

- Resonemang över flera hopp

- Hämtning baserad på grafer

- Självkorrigerande loopar

- Integration av strukturerad kunskap

Dessa arkitekturer är avgörande för företagsspecifika AI-system.

När RAG misslyckas (och hur du fixar det)

De flesta RAG-misslyckanden är diagnostiserbara om du tittar på pipeline-lagret för lager.

- Det returnerar irrelevant kontext → förbättra avsnittning, lägg till metadatafiltrering, implementera hybridsökning, justera K.

- Det hämtar rätt dokument men svarar felaktigt → lägg till omrankning, minska kontextbrus, förbättra promptens regler för grundläggning.

- Det hallucinerar trots bra dokument → kräv citat, lägg till vägranbeteende, lägg till poängsättning för trovärdighet, minska “kreativ” temperatur.

- Det är långsamt/dyrt → cacha hämtning och inbäddningar, minska omranknings-K, begränsa kontext, batcha inbäddningar, justera ANN-indexparametrar.

- Det läcker data mellan uthyrningar → implementera ACL-filtrering vid hämtningstid (inte bara i prompten), separata index eller partitioner per uthyrning.

Vanliga RAG-implementeringsfel

Vanliga fel i inledande RAG-tutorials inkluderar:

- Användning av för stora dokumentavsnitt

- Att hoppa över omrankning

- Att överbelasta kontextfönstret

- Att inte filtrera metadata

- Ingen utvärderingsharness

Att åtgärda dessa förbättrar dramatiskt prestanda hos RAG-system.

RAG vs Fine-tuning

I många tutorials förväxlas RAG och fine-tuning. Använd denna beslutsguide:

| Du bör föredra… | När… |

|---|---|

| RAG | kunskapen ändras ofta; du behöver citat/revisibilitet; du har privata dokument; du vill ha snabba uppdateringar utan omtränning |

| Fine-tuning | du behöver konsekvent ton/beteende; du vill att modellen ska följa en domänstilguide; din kunskap är relativt statisk |

| Båda | du behöver domänbeteende och färsk/privat kunskap (vanligt i produktion) |

Använd RAG för:

- Hämtning av extern kunskap

- Data som uppdateras ofta

- Lägre operativ risk

Använd fine-tuning för:

- Beteendekontroll

- Konsekvent ton/stil

- Domänanpassning när data är statisk

De flesta avancerade AI-system kombinerar Retrieval-Augmented Generation med selektiv fine-tuning.

Bästa praxis för RAG i produktion

Om du går från en RAG-tutorial till produktion:

Hämtning + kvalitet

- Använd hybridhämtning

- Lägg till omrankning

- Använd metadatafiltrering och borttagning av dubletter

- Spår hämtningsmetriker (recall@k / precision@k) kontinuerligt

Kostnad + latens (hoppa inte över detta)

- Cacha:

- Inbäddningscache (identisk text → identisk inbäddning)

- Hämtningscache (populära frågor)

- Svars-cache (för deterministiska arbetsflöden)

- Justera ANN-indexparametrar (HNSW/IVF) och batch-operationer

- Kontrollera tokenanvändning: mindre kontext, färre kandidater, strukturerade prompts

Säkerhet + integritet

- Gör åtkomstkontroll vid hämtningstid (ACL-filtrering / partitioner per uthyrning)

- Redigera eller undvik indexering av PII där det är möjligt

- Logga säkert (undvik att lagra rå känsliga prompts om det inte krävs)

Operativ disciplin

- Versionera dina inbäddningar och avsnittningsstrategi

- Automatisera inmatningspipelines

- Övervak hallucination/trovärdighetsmetriker

- Spår kostnad per fråga

Retrieval-Augmented Generation är inte bara ett tutorials-koncept – det är en disciplin för produktionarkitektur.

Slutord

Denna RAG-tutorial täcker både inledande implementering och avancerad systemdesign.

Retrieval-Augmented Generation är ryggmärgen i moderna AI-applikationer.

Att behärska RAG-arkitektur, omrankning, vektordatabaser, hybridsökning och utvärdering kommer att avgöra om ditt AI-system förblir en demo – eller blir redo för produktion.

Detta ämne kommer att fortsätta att expandera när RAG-system utvecklas.