Minska LLM-kostnader: Strategier för tokenoptimering

Minska LLM-kostnader med 80% genom smart tokenoptimering

Tokenoptimering är den kritiska färdigheten som skiljer kostnadseffektiva LLM-applikationer från budgetdrainande experiment.

Minska LLM-kostnader med 80% genom smart tokenoptimering

Tokenoptimering är den kritiska färdigheten som skiljer kostnadseffektiva LLM-applikationer från budgetdrainande experiment.

Bygg MCP-server för AI-assistenter med Python-exempel

Model Context Protocol (MCP) revolutionerar hur AI-assistenter interagerar med externa datorkällor och verktyg. I den här guiden kommer vi att utforska hur man bygger MCP servrar i Python, med exempel som fokuserar på webbsökning och skrapning.

Lätt olika API:er kräver en särskild tillvägagångssätt.

Här är en sida vid sida jämförelse av stöd för strukturerad utdata (att få tillförlitligt JSON tillbaka) över populära LLM-leverantörer (https://www.glukhov.org/sv/llm-performance/benchmarks/structured-output-comparison-popular-llm-providers/ “strukturerad utdata över populära LLM-leverantörer”), plus minimala Python exempel

Några sätt att få strukturerad utdata från Ollama

Stora språkmodeller (LLMs) är kraftfulla, men i produktion vill vi sällan ha fritt formulerade stycken. Istället vill vi ha förutsägbart data: attribut, fakta eller strukturerade objekt som du kan mata in i en app. Det är LLM Strukturerad Utdata.

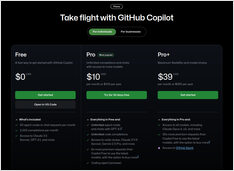

Beskrivning, planer, kommandon och tangentbordsgenvägar

Här är en uppdaterad GitHub Copilot cheat sheet, som täcker viktiga genvägar, kommandon, användningstips och kontextfunktioner för Visual Studio Code och Copilot Chat

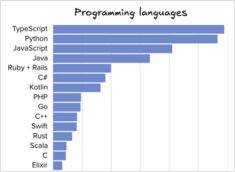

Jämförelse av mjukvaruutvecklingsverktyg och programmeringsspråk

The Pragmatic Engineer-nytt publicerade för några dagar sedan undersökningsstatistik om populariteten för programmeringsspråk, IDE:er, AI-verktyg och andra data för mitten av 2025.

I juli 2025 kommer det snart att vara tillgängligt.

Nvidia är på väg att släppa NVIDIA DGX Spark – en liten AI-superdator med Blackwell-arkitektur, 128+ GB enhetligt minne och 1 PFLOPS AI-prestation. En bra enhet att köra LLM på.

Långläsning om MCP-specifikationer och implementering i GO

Här har vi en beskrivning av The Model Context Protocol (MCP), korta anteckningar om hur man implementerar en MCP-server i Go, inklusive meddelandestruktur och protokollspecificeringar.

Implementerar du RAG? Här finns några kodexempel på Go – del 2...

Eftersom standard Ollama inte har en direkt rerank-API, behöver du implementera omrankning med Qwen3 Reranker i GO genom att generera inbäddningar (embeddings) för par av fråga-dokument och sedan betygsätta dem.

Implementerar du RAG? Här är några kodsnuttar i Golang..

Detta lilla Reranking-kodexempel i Go anropar Ollama för att generera inbäddningar för frågan och för varje kandidatdokument, och sorterar sedan i fallande ordning baserat på kosinussimilaritet.

Nya fantastiska LLM:er tillgängliga i Ollama

Qwen3-inkapslings- och omklassificeringsmodeller är de senaste tillägg i Qwen-familjen, specifikt utformade för avancerade uppgifter inom textinkapsling, hämtning och omklassificering (reranking).

Vad är denna trendiga AI-assisterade kodning?

Vibe kodning är en AI-driven programmeringsmetod där utvecklare beskriver önskad funktionalitet på naturligt språk, vilket tillåter AI-verktyg att generera kod automatiskt.

Hela uppsättningen av MM*-verktyg är på EOL...

Jag har använt MMDetection (mmengine, mdet, mmcv), och nu ser det ut som att det är ur spel. Det är synd. Jag gillade deras modellzoo.

Nyckelfull ny AI-modell för att skapa bilder från text

Nyligen publicerade Black Forest Labs en uppsättning text-till-bild AI-modeller. Dessa modeller sägs ha mycket högre utdata kvalitet. Låt oss prova dem

Jämförelse av två självhämtade AI-sökmotorer

Läcker mat är också en njutning för ögonen. Men i den här posten kommer vi att jämföra två AI-baserade söksystem, Farfalle och Perplexica.

Inte så många att välja mellan men ändå...

När jag började experimentera med LLMs var gränssnitten för dem i aktiv utveckling och nu är några av dem verkligen bra.