Poradnik Retrieval-Augmented Generation (RAG): architektura, implementacja i wdrożenie w produkcji

Od podstawowego RAG do wdrożenia produkcyjnego: fragmentowanie, wyszukiwanie wektorowe, ponowne rankingowanie i ocena – wszystko w jednym przewodniku.

Od podstawowego RAG do wdrożenia produkcyjnego: fragmentowanie, wyszukiwanie wektorowe, ponowne rankingowanie i ocena – wszystko w jednym przewodniku.

Kontroluj dane i modele za pomocą samodzielnie hostowanych LLMów

Autonomiczne hostowanie modeli językowych (LLM) umożliwia kontrolę nad danymi, modelami i wnioskowaniem – praktyczna droga do autonomii w zakresie AI dla zespołów, przedsiębiorstw i narodów.

Test prędkości LLM na RTX 4080 z 16 GB VRAM

Uruchamianie dużych modeli językowych lokalnie zapewnia prywatność, możliwość pracy offline oraz zero kosztów API.

Ten benchmark pokazuje dokładnie, co można się spodziewać od 14 popularnych

LLM na Ollama na RTX 4080.

Trendowe repozytoria Pythona – styczeń 2026

Ekosystem Python w tym miesiącu jest zdominowany przez Claude Skills oraz narzędzia dla agentów AI. Ten przegląd analizuje topowe repozytoria Pythona na GitHubie.

Popularne repozytoria Rust z stycznia 2026

Ekostruktura Rusta eksploduje z innowacyjnych projektów, szczególnie w narzędziach do kodowania AI i aplikacjach terminalowych. Ten przegląd analizuje najpopularniejsze repozytoria Rusta na GitHubie w tym miesiącu.

Popularne repozytoria Go na styczniu 2026

Ekosystem Go nadal rozwija się dzięki innowacyjnym projektom obejmującym narzędzia AI, aplikacje samozhostowane oraz infrastrukturę dla programistów. Niniejszy przegląd analizuje najbardziej popularne repozytoria Go na GitHub w tym miesiącu.

Wybierz odpowiedni menedżer pakietów Pythona

Ta kompleksowa przewodnik oferuje tło oraz szczegółowy porównanie Anaconda, Miniconda i Mamba – trzy potężne narzędzia, które stały się nieodzowne dla programistów Pythona i naukowców danych pracujących z złożonymi zależnościami i środowiskami obliczeniowymi.

Autonomiczna alternatywa do ChatGPT dla lokalnych modeli językowych

Open WebUI to potężny, rozszerzalny i bogaty w funkcje samozostawiana aplikacja webowa do interakcji z dużymi modelami językowymi.

Nieodzowny kalendarz technologiczny Melbourne na 2026 rok

Społeczność technologiczna w Melbourne nadal rozwija się w 2026 roku, oferując imponującą listę konferencji, spotkań i warsztatów obejmujących rozwój oprogramowania, obliczenia w chmurze, sztuczną inteligencję, bezpieczeństwo informacyjne oraz technologie przyszłości.

Szybkie wnioskowanie LLM z wykorzystaniem API OpenAI

vLLM to wysokioprądowy, oszczędny pamięciowo silnik inferencji i serwowania dla Dużych Modeli Językowych (LLM), opracowany przez Laboratorium Obliczeń Nieba UC Berkeley.

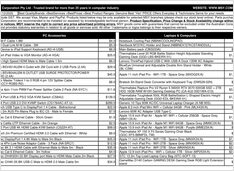

Prawdziwe ceny w AUD od australijskich sprzedawców już teraz.

NVIDIA DGX Spark](https://www.glukhov.org/pl/hardware/ai/nvidia-dgx-spark/ “NVIDIA DGX Spark - mały superkomputer AI”) (GB10 Grace Blackwell) jest dostępny w Australii w głównych sklepach z komputerami, z miejscowym zapasem. Jeśli śledzicie ceny i dostępność DGX Spark na świecie, zainteresuje Was zapewne, że ceny w Australii wahają się od 6 249 do 7 999 AUD w zależności od konfiguracji pamięci masowej i sprzedawcy.

Techniczny przewodnik po wykrywaniu treści wygenerowanych przez AI

Proliferacja treści wygenerowanych przez AI stworzyła nowe wyzwania: rozróżnianie rzeczywistego pisania ludzkiego od “AI slop” - niskiej jakości, masowo produkowanej syntetycznej treści.

Testowanie Cognee z lokalnymi modelami LLM - rzeczywiste wyniki

Cognee to framework w Pythonie do budowania grafów wiedzy z dokumentów za pomocą LLM. Ale działa on z modelami samozhostowanymi?

Bezpieczne pod względem typów wyniki z LLM z użyciem BAML i Instructora

Pracując z modelami dużych języków w środowisku produkcyjnym, uzyskiwanie strukturalnych, typowo bezpiecznych wyjść jest krytyczne. Dwa popularne frameworki – BAML i Instructor – podejmują różne podejścia do rozwiązywania tego problemu.