Ollama 에서 지원하는 Qwen3 임베딩 및 리랭커 모델: 최첨단 성능

Ollama 에서 제공되는 새로운 놀라운 LLM 들

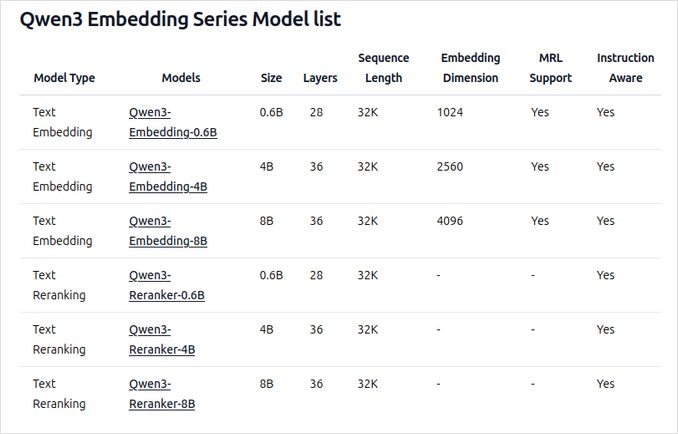

Qwen3 임베딩 및 리랭커 모델 은 Qwen 시리즈의 최신 릴리스로, 고급 텍스트 임베딩, 검색 및 재랭킹 작업을 위해 특별히 설계되었습니다.

시각적으로도 즐거운 모델

Qwen3 임베딩 및 리랭커 모델은 다국어 자연어 처리 (NLP) 의 중요한 진보를 대표하며, 텍스트 임베딩 및 재랭킹 작업에서 최첨단 성능을 제공합니다. 알리바바에서 개발한 Qwen 시리즈의 일부인 이 모델들은 의미론적 검색부터 코드 검색에 이르기까지 다양한 애플리케이션을 지원하도록 설계되었습니다. 이러한 임베딩 기능은 검색 증강 생성 (RAG) 튜토리얼: 아키텍처, 구현 및 프로덕션 가이드 에서 자세히 다루는 효과적인 RAG 시스템 구축의 핵심 요소입니다. Ollama는 대규모 언어 모델 (LLM) 을 호스팅하고 배포하기 위한 인기 있는 오픈소스 플랫폼이지만, Qwen3 모델과의 통합에 대한 내용은 공식 문서에서 명시적으로 다루고 있지 않습니다. 그러나 이 모델들은 Hugging Face, GitHub, ModelScope 를 통해 접근 가능하며, 이를 통해 Ollama 또는 유사한 도구를 활용한 로컬 배포가 가능합니다.

모델 사용 예시

다음은 이러한 모델과 ollama 를 사용하여 작성된 Go 언어의 샘플 코드를 참조하세요:

올라마의 새로운 Qwen3 임베딩 및 리랭커 모델 개요

이 모델들은 다양한 크기로 Ollama 에서 배포할 수 있으며, 다양한 언어 및 코드 관련 애플리케이션에 대한 최첨단 성능과 유연성을 제공합니다.

주요 기능 및 능력

-

모델 크기 및 유연성

- 임베딩 및 재랭킹 작업 모두에 대해 0.6B, 4B, 8B 매개변수 크기로 제공됩니다.

- 8B 임베딩 모델은 현재 MTEB 다국어 리더보드에서 1 위를 차지하고 있습니다 (2025 년 6 월 5 일 기준, 점수 70.58).

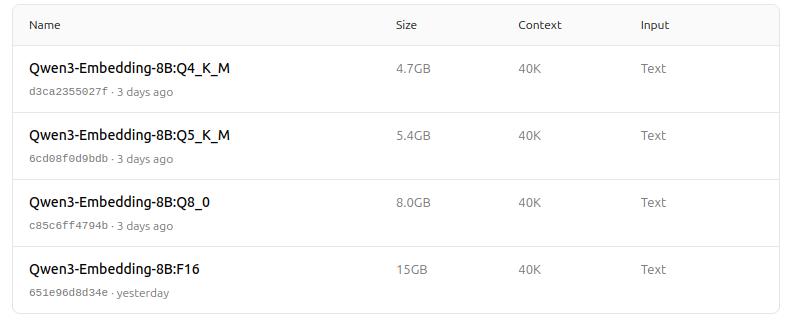

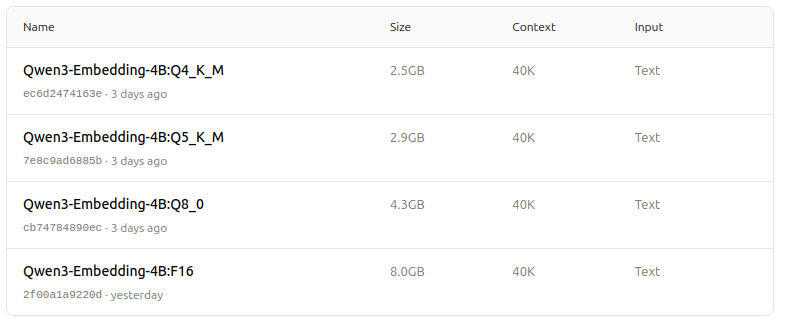

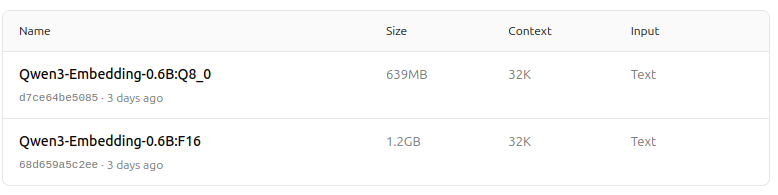

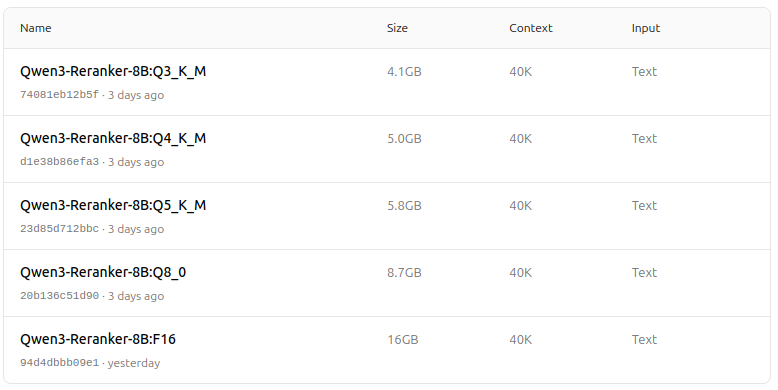

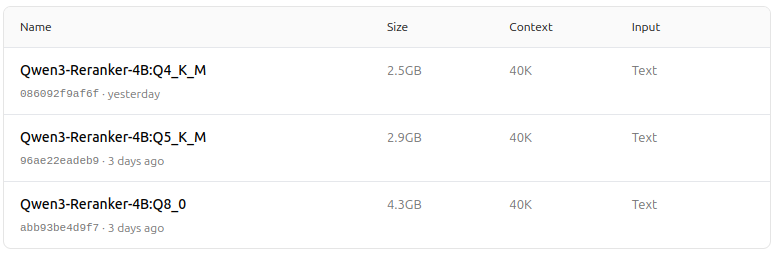

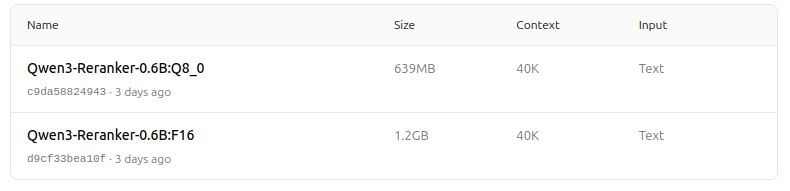

- 성능, 메모리 사용량, 속도의 균형을 맞추기 위해 다양한 양자화 옵션 (Q4, Q5, Q8 등) 을 지원합니다. 대부분의 사용자에게 Q5_K_M 을 권장하며, 이는 자원 효율성을 유지하면서도 모델 성능의 대부분을 보존합니다.

-

아키텍처 및 학습

- Qwen3 기반에 구축되었으며, 임베딩을 위한 듀얼 인코더와 재랭킹을 위한 크로스 인코더 아키텍처를 모두 활용합니다.

- 임베딩 모델: 단일 텍스트 세그먼트를 처리하여 최종 은닉 상태 (hidden state) 에서 의미론적 표현을 추출합니다.

- 리랭커 모델: 텍스트 쌍 (예: 쿼리와 문서) 을 입력으로 받아 크로스 인코더 방식을 통해 관련성 점수를 출력합니다.

- 임베딩 모델은 최적의 일반화 및 적응력을 위해 대비 사전 학습, 고품질 데이터로 감독 학습, 모델 병합이라는 3 단계 학습 패러다임을 사용합니다.

- 리랭커 모델은 효율성과 효과성을 위해 고품질 라벨링된 데이터로 직접 학습됩니다.

-

다국어 및 다중 작업 지원

- 프로그래밍 언어를 포함하여 100 개 이상의 언어를 지원하여 강력한 다국어, 교차 언어 및 코드 검색 기능을 제공합니다.

- 임베딩 모델은 특정 작업이나 언어에 맞게 성능을 조정할 수 있도록 유연한 벡터 정의와 사용자 정의 지침을 허용합니다.

- 텍스트를 넘어선 멀티모달 기능이 필요한 애플리케이션의 경우 크로스 모달 임베딩: AI 모달리티 연결 을 참조하세요.

-

성능 및 사용 사례

- 텍스트 검색, 코드 검색, 분류, 클러스터링, 이문장 마이닝 분야에서 최첨단 결과를 제공합니다.

- 리랭커 모델은 다양한 텍스트 검색 시나리오에서 뛰어난 성능을 발휘하며, 임베딩 모델과 매끄럽게 결합되어 종단간 검색 파이프라인을 구성할 수 있습니다.

Ollama 에서 사용하는 방법

다음과 같은 명령어로 Ollama 에서 이 모델들을 실행할 수 있습니다:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

하드웨어 및 성능 요구 사항에 가장 적합한 양자화 버전을 선택하세요.

2025 년 12 월 업데이트: 현재 Ollama 는 dengcao 의 리포지토리가 아닌 자체 리포지토리에서 표준 Qwen3 임베딩 모델을 제공합니다:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

자세한 내용은 여기에서 확인하세요: https://ollama.com/library/qwen3-embedding

요약 테이블

| 모델 유형 | 제공 크기 | 주요 강점 | 다국어 지원 | 양자화 옵션 |

|---|---|---|---|---|

| 임베딩 | 0.6B, 4B, 8B | 최고 MTEB 점수, 유연성, 효율성, 최첨단 (SOTA) | 예 (100+ 언어) | Q4, Q5, Q6, Q8 등 |

| 리랭커 | 0.6B, 4B, 8B | 텍스트 쌍 관련성에서 우수, 효율적, 유연함 | 예 | F16, Q4, Q5 등 |

기쁜 소식!

Ollama 의 Qwen3 임베딩 및 리랭커 모델은 다국어, 다중 작업 텍스트 및 코드 검색 기능에서 중요한 도약을 의미합니다. 유연한 배포 옵션, 강력한 벤치마크 성능, 다양한 언어 및 작업 지원으로 인해 연구 및 프로덕션 환경 모두에 적합합니다.

모델 동물원 - 이제 시각적으로도 즐거움

Qwen3 임베딩

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

Qwen3 리랭커

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

훌륭합니다!

유용한 링크

- Ollama 와 Qwen3 임베딩 모델을 활용한 텍스트 문서 재랭킹 - Go 언어

- Ollama 와 Qwen3 리랭커 모델을 활용한 텍스트 문서 재랭킹 - Go 언어

- Ollama 치트시트

- Ollama 모델을 다른 드라이브 또는 폴더로 이동하기

- Perplexica 자체 호스팅 - Ollama 와 함께

- 테스트: Ollama 가 Intel CPU 성능 및 효율 코어를 사용하는 방법

- LLM 속도 성능 비교

- LLM 요약 능력 비교

- 클라우드 LLM 프로바이더

- Ollama 가 병렬 요청을 처리하는 방법

- Hugo 페이지 번역 품질 비교 - Ollama 의 LLM