Ejecutar FLUX.1-dev GGUF Q8 en Python

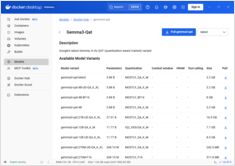

Acelere FLUX.1-dev con cuantización GGUF

FLUX.1-dev es un modelo poderoso de generación de imágenes a partir de texto que produce resultados asombrosos, pero su requisito de memoria de 24GB+ hace que sea difícil de ejecutar en muchos sistemas. GGUF quantization of FLUX.1-dev ofrece una solución, reduciendo el uso de memoria en aproximadamente un 50% mientras se mantiene una excelente calidad de imagen.