Qwen3-inbäddnings- och omklassificeringsmodeller på Ollama: branschledande prestanda

Nya fantastiska LLM:er tillgängliga i Ollama

Qwen3-inkapslings- och omklassificeringsmodeller är de senaste tillägg i Qwen-familjen, specifikt utformade för avancerade uppgifter inom textinkapsling, hämtning och omklassificering (reranking).

Ögonfröjd

Qwen3-inkapslings- och omklassificeringsmodellerna representerar en betydande framsteg inom flerspråkig bearbetning av naturligt språk (NLP) och erbjuder branschledande prestanda i uppgifter för textinkapsling och omklassificering. Dessa modeller, som är en del av Qwen-serien utvecklad av Alibaba, är designade för att stödja ett brett spektrum av tillämpningar, från semantisk hämtning till kodsökning. Denna typ av inkapslingskapabilitet är grundläggande för att bygga effektiva RAG-system, vilket behandlas i detalj i Vägledning för Retrieval-Augmented Generation (RAG): Arkitektur, Implementering och Produktionsguide. Även om Ollama är en populär öppen källkodsplattform för att värdshålla och distribuera stora språkmodeller (LLM), är integrationen av Qwen3-modeller med Ollama inte explicit detaljerad i officiell dokumentation. Modellerna är dock tillgängliga via Hugging Face, GitHub och ModelScope, vilket möjliggör potentiell lokal distribution genom Ollama eller liknande verktyg.

Exempel på användning av dessa modeller

Se exempelkod på Go som använder ollama med dessa modeller:

- Omklassificering av textdokument med Ollama och Qwen3 Embedding-modellen - på Go

- Omklassificering av textdokument med Ollama och Qwen3 Reranker-modellen - på Go

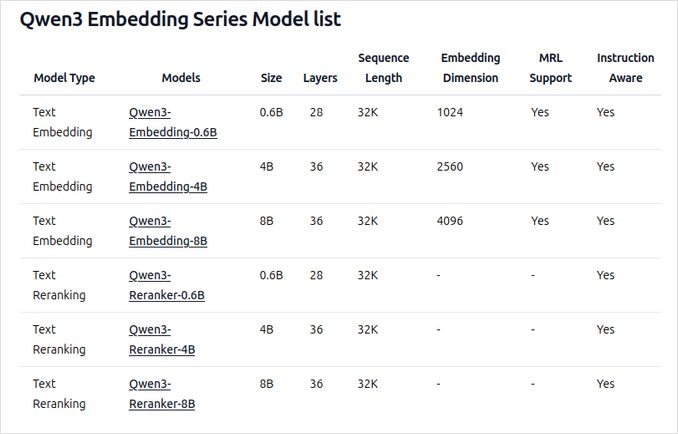

Översikt över nya Qwen3-inkapslings- och omklassificeringsmodeller på Ollama

Dessa modeller är nu tillgängliga för distribution på Ollama i olika storlekar och erbjuder branschledande prestanda och flexibilitet för ett brett spektrum av språk- och kodrelaterade tillämpningar.

Nyckelfunktioner och möjligheter

-

Modellstorlekar och flexibilitet

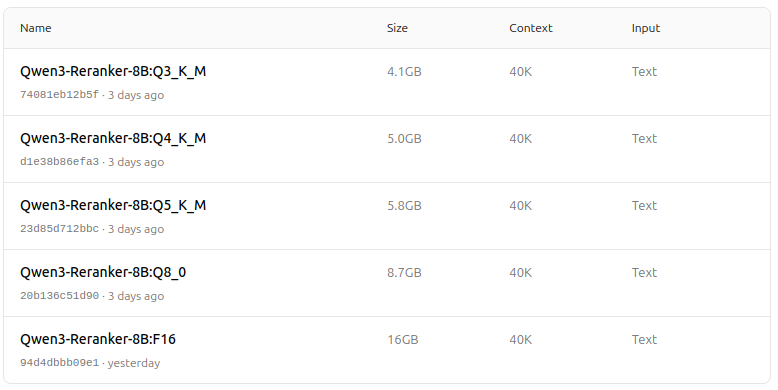

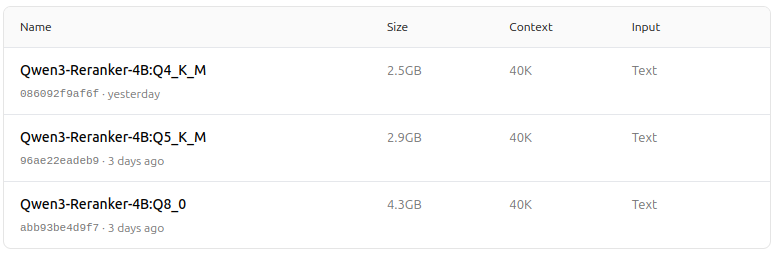

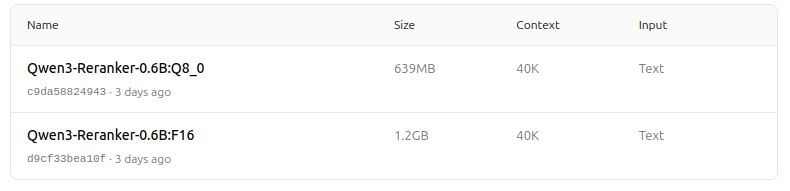

- Tillgängliga i flera storlekar: 0,6B, 4B och 8B parametrar för både inkapsling och omklassificering.

- 8B-inkapslingsmodellen rankas för närvarande som nummer 1 på MTEB:s flerspråkiga ledarlista (per den 5 juni 2025, med ett poäng på 70,58).

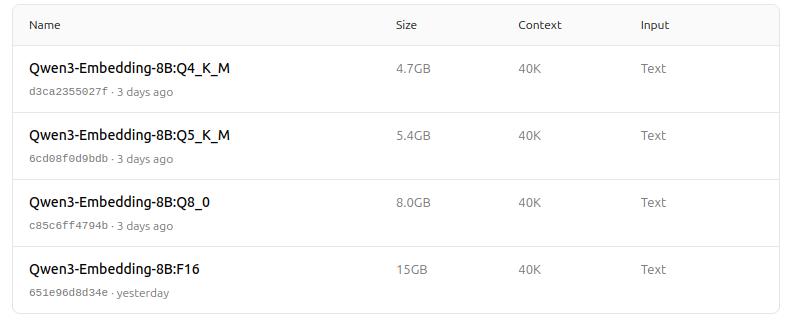

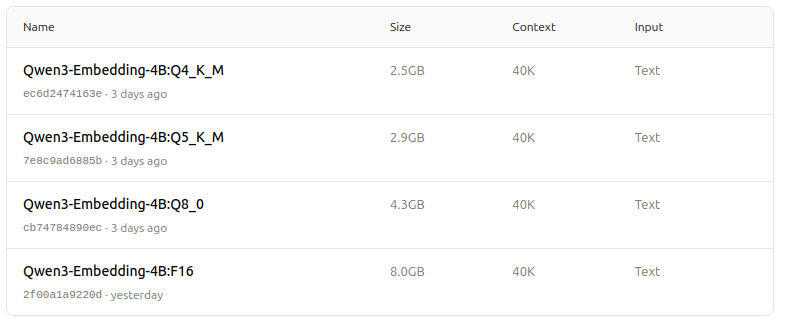

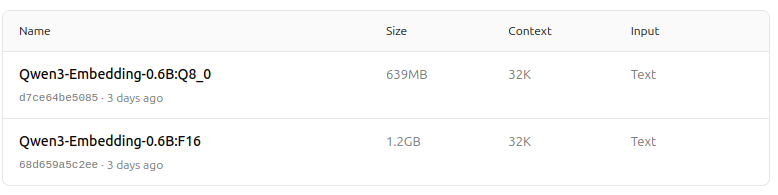

- Stöder ett utbud av kvantiseringsalternativ (Q4, Q5, Q8 etc.) för att balansera prestanda, minnesanvändning och hastighet. Q5_K_M rekommenderas för de flesta användare eftersom den bevarar mestadels modellens prestanda samtidigt som den är resurseffektiv.

-

Arkitektur och träning

- Byggd på Qwen3-grundval och utnyttjar både dual-encoder (för inkapsling) och cross-encoder (för omklassificering) arkitekturer.

- Inkapslingsmodell: Bearbetar enskilda textsegment och extraherar semantiska representationer från det slutgiltiga dolda tillståndet.

- Omklassificeringsmodell: Tar emot textpar (t.ex. fråga och dokument) och ger ett relevanspoäng med en cross-encoder-metod.

- Inkapslingsmodeller använder en trestegs träningsparadigm: kontrastiv förträning, övervakad träning med högkvalitativa data och modellfusion för optimal generalisering och anpassningsförmåga.

- Omklassificeringsmodeller tränas direkt med högkvalitativa märkta data för effektivitet och verkan.

-

Stöd för flera språk och uppgifter

- Stöder över 100 språk, inklusive programmeringsspråk, vilket möjliggör robusta flerspråkiga, krosspråkliga och kodbaserade hämtningskapabiliteter.

- Inkapslingsmodeller tillåter flexibla vektordefinitioner och användardefinierade instruktioner för att anpassa prestanda för specifika uppgifter eller språk.

- För tillämpningar som kräver multimodala förmågor utöver text, se Cross-Modal Embeddings: Att brygga AI-modaliteter.

-

Prestanda och användningsområden

- Branschledande resultat inom texthämtning, kodhämtning, klassificering, klusteranalys och bitext-mining.

- Omklassificeringsmodeller excellerar i olika texthämtningsscenarier och kan sömlöst kombineras med inkapslingsmodeller för end-to-end hämtningspipelinear.

Hur man använder på Ollama

Du kan köra dessa modeller på Ollama med kommandon som:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

Välj kvantiseringsversionen som bäst passar din hårdvara och dina prestandabehov.

Uppdatering december 2025: Ollama tillhandahåller nu standard Qwen3-inkapslingsmodeller från sitt eget repo, inte dengcaos:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

Se mer: https://ollama.com/library/qwen3-embedding

Sammanfattande tabell

| Modelltyp | Tillgängliga storlekar | Nyckelstyrkor | Flerspråkigt stöd | Kvantiseringsalternativ |

|---|---|---|---|---|

| Inkapsling | 0,6B, 4B, 8B | Topp MTEB-poäng, flexibel, effektiv, SOTA | Ja (100+ språk) | Q4, Q5, Q6, Q8 etc. |

| Omklassificering | 0,6B, 4B, 8B | Excellerar i textparrelevans, effektiv, flexibel | Ja | F16, Q4, Q5 etc. |

Fantastiskt nytt!

Qwen3-inkapslings- och omklassificeringsmodellerna på Ollama representerar ett betydande hopp i flerspråkiga, fleroppgiftsrelaterade text- och kodhämtningskapabiliteter. Med flexibla distributionsalternativ, stark benchmark-prestanda och stöd för ett brett utbud av språk och uppgifter är de väl lämpade för både forsknings- och produktionsmiljöer.

Modellzoo - ögonfröjd nu

Qwen3 Inkapsling

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

Qwen3 Omklassificering

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

Fint!

Nyttiga länkar

- Omklassificering av textdokument med Ollama och Qwen3 Embedding-modellen - på Go

- Omklassificering av textdokument med Ollama och Qwen3 Reranker-modellen - på Go

- Ollama cheatsheet

- Flytta Ollama-modeller till annan enhet eller mapp

- Self-hosting Perplexica - med Ollama

- Test: Hur Ollama använder Intel CPU-prestanda och Efficient Cores

- Jämförelse av LLM-hastighet och prestanda

- Jämförelse av LLM:s sammanfattningsförmåga

- Cloud LLM-leverantörer

- Hur Ollama hanterar parallella förfrågningar

- Jämförelse av Hugo-sidöversättningskvalitet - LLMs på Ollama