GPU- en RAM-prijzen stijgen in Australië: RTX 5090 met 15%, RAM met 38% - januari 2026

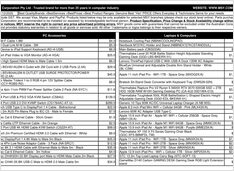

Controle van GPU- en RAM-prijzen in januari 2025

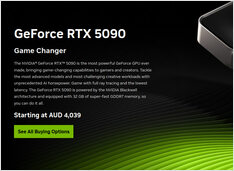

Vandaag kijken we naar de top-level consumentengrafische kaarten en RAM-modules. Specifiek kijk ik naar RTX-5080 en RTX-5090-prijzen, en 32GB (2x16GB) DDR5 6000.