Open WebUI: zelfgehoste LLM-interface

Zelfgehoste alternatief voor ChatGPT voor lokale LLMs

Open WebUI is een krachtig, uitbreidbaar en functierijk zelfgehost webinterface voor het communiceren met grote taalmodellen.

Zelfgehoste alternatief voor ChatGPT voor lokale LLMs

Open WebUI is een krachtig, uitbreidbaar en functierijk zelfgehost webinterface voor het communiceren met grote taalmodellen.

Melbournes essentiële techkalender 2026

Melbournes technologische gemeenschap blijft in 2026 bloeien met een indrukwekkende lijst van conferenties, ontmoetingsbijeenkomsten en workshops die zich uitstrekken over softwareontwikkeling, cloudcomputing, AI, cybersecurity en opkomende technologieën.

Snel LLM-inferentie met de OpenAI API

vLLM is een inference- en serving-engine met hoge doorvoer en geheugenefficiëntie voor Large Language Models (LLM’s), ontwikkeld door het Sky Computing Lab van UC Berkeley.

Real AUD-prijzen van Australische retailers, nu.

De NVIDIA DGX Spark (GB10 Grace Blackwell) is nu in Australië beschikbaar bij grote PC-handelaars met lokale voorraad. Als u de welvaartsprijzen en beschikbaarheid van de DGX Spark wereldwijd volgt, bent u misschien geïnteresseerd om te weten dat de prijzen in Australië variëren van $6.249 tot $7.999 AUD, afhankelijk van de opslagconfiguratie en de handelaar.

Technische gids voor het detecteren van AI-generatieerde inhoud

De verspreiding van AI-generatieerde inhoud heeft een nieuw probleem geschapen: het onderscheiden van echte menselijke schrijving van “AI slop” - laagwaardige, massaproduceerde synthetische tekst.

Cognee testen met lokale LLMs - reële resultaten

Cognee is een Python-framework voor het bouwen van kennisgrafieken uit documenten met behulp van LLMs. Werkt het echter met zelfgehoste modellen?

Typeveilig LLM-uitvoer met BAML en Instructor

Bij het werken met grote taalmodellen in productie is het verkrijgen van gestructureerde, typeveilige uitvoer van kritiek belang. Twee populaire frameworks - BAML en Instructor - nemen verschillende benaderingen om dit probleem op te lossen.

Overdenkingen over LLMs voor self-hosted Cognee

Kiezen voor de Beste LLM voor Cognee vereist het balanceren van de kwaliteit van het bouwen van grafieken, hallucinatiepercentages en hardwarebeperkingen. Cognee excelleert met grotere modellen met lage hallucinatiepercentages (32B+) via Ollama, maar middelgrote opties werken voor lichtere opstellingen.

Essentiële snelkoppelingen en magische opdrachten

Start de Jupyter Notebook productiviteit op met essentiële sneltoetsen, magische commando’s en workflow-tips die uw data science- en ontwikkelingservaring kunnen transformeren.

Maak AI-zoekagents aan met Python en Ollama

De Ollama Python-bibliotheek bevat nu native OLlama web zoekfunctie mogelijkheden. Met slechts een paar regels code kunt u uw lokale LLMs verrijken met real-time informatie van het web, waardoor hallucinaties worden verminderd en de nauwkeurigheid wordt verbeterd.

Kies de juiste vector database voor uw RAG-stack

Het kiezen van de juiste vectorstore kan prestaties, kosten en schaalbaarheid van uw RAG-toepassing bepalen. Deze uitgebreide vergelijking dekt de meest populaire opties in 2024-2025.

Maak AI zoekagents met Go en Ollama

Ollama’s Web Search API laat je lokale LLMs verrijken met real-time webinformatie. Deze gids laat je zien hoe je web zoekfunctionaliteiten in Go kunt implementeren, van eenvoudige API-aanroepen tot volledig uitgeruste zoekagenten.

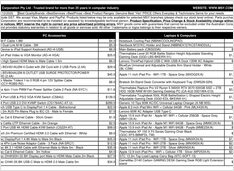

RAM-prijzen stijgen met 163-619% door de vraag naar AI die de aanvoer onder druk zet.

De geheugenmarkt ervaart eind 2025 ongekende prijsschommelingen, waarbij RAM-prijzen dramatisch stijgen in alle segmenten.

Vergelijk de beste lokale LLM-hostingtools van 2026. API-maturiteit, hardware-ondersteuning, tool calling en gebruiksscenario's in de praktijk.

Lokaal draaien van LLM’s is nu praktisch voor ontwikkelaars, startups en zelfs enterprise-teams.

Het kiezen van het juiste instrument — Ollama, vLLM, LM Studio, LocalAI of anderen — hangt echter af van uw doelen:

Maak robuuste AI/ML-pijplijnen met Go-microservices

Aan de slag met AI- en ML-werkbelastingen die steeds complexer worden, is het belangrijk dat er robuuste orkestratiesystemen zijn. De eenvoud, prestaties en gelijktijdigheid van Go maken het ideaal om de orkestratielag van ML-pijplijnen te bouwen, zelfs als de modellen zelf in Python zijn geschreven.

Vereenig tekst, afbeeldingen en audio in gedeelde embedding-ruimtes

Cross-modale ingebedden stellen een doorbraak voor in de kunstmatige intelligentie, waardoor begrip en redeneren mogelijk worden over verschillende gegefstypen binnen een gedeelde representatie-ruimte.