Handleiding voor Retrieval-Augmented Generation (RAG): architectuur, implementatie en gids voor productie

Van basis RAG tot productie: chunking, vectorzoeken, herschikken en evaluatie in één gids.

Van basis RAG tot productie: chunking, vectorzoeken, herschikken en evaluatie in één gids.

Beheer gegevens en modellen met zelfgehoste LLMs

Self-hosting van LLMs houdt gegevens, modellen en inferentie onder jouw controle - een praktische weg naar AI-sovereiniteit voor teams, bedrijven en naties.

LLM-snelheidstest op RTX 4080 met 16 GB VRAM

Het lokaal uitvoeren van grote taalmodellen biedt privacy, offline mogelijkheden en nul API-kosten. Deze benchmark laat precies zien wat men kan verwachten van 14 populaire LLMs op Ollama op een RTX 4080.

Python-repositories die januari 2026 trending zijn

Het Python-ecosysteem wordt deze maand gedomineerd door Claude Skills en tooling voor AI-agents. Deze analyse bespreekt de top trending Python-repositories op GitHub.

Populaire Rust-repos januari 2026

De Rust-ecosysteem explodeert met innovatieve projecten, vooral in AI-coderings-tools en terminaltoepassingen. Deze overzicht analyseert de top trending Rust-repositories op GitHub deze maand.

Populaire Go-repos januari 2026

De Go-ecosysteem blijft bloeien met innovatieve projecten die zich uitstrekken over AI-tools, zelfgehoste toepassingen en ontwikkelaarsinfrastructuur. Deze overzicht analyseert de top trending Go-repositories op GitHub deze maand.

Kies het juiste Python-pakketbeheerder

Deze uitgebreide gids biedt achtergrondinformatie en een gedetailleerde vergelijking van Anaconda, Miniconda en Mamba - drie krachtige tools die essentieel zijn geworden voor Python-ontwikkelaars en data scientists die werken met complexe afhankelijkheden en wetenschappelijke berekeningsomgevingen.

Zelfgehoste alternatief voor ChatGPT voor lokale LLMs

Open WebUI is een krachtig, uitbreidbaar en functierijk zelfgehost webinterface voor het communiceren met grote taalmodellen.

Melbournes essentiële techkalender 2026

Melbournes technologische gemeenschap blijft in 2026 bloeien met een indrukwekkende lijst van conferenties, ontmoetingsbijeenkomsten en workshops die zich uitstrekken over softwareontwikkeling, cloudcomputing, AI, cybersecurity en opkomende technologieën.

Snel LLM-inferentie met de OpenAI API

vLLM is een inference- en serving-engine met hoge doorvoer en geheugenefficiëntie voor Large Language Models (LLM’s), ontwikkeld door het Sky Computing Lab van UC Berkeley.

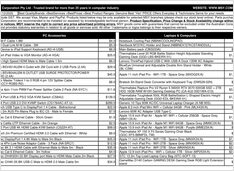

Real AUD-prijzen van Australische retailers, nu.

De NVIDIA DGX Spark (GB10 Grace Blackwell) is nu in Australië beschikbaar bij grote PC-handelaars met lokale voorraad. Als u de welvaartsprijzen en beschikbaarheid van de DGX Spark wereldwijd volgt, bent u misschien geïnteresseerd om te weten dat de prijzen in Australië variëren van $6.249 tot $7.999 AUD, afhankelijk van de opslagconfiguratie en de handelaar.

Technische gids voor het detecteren van AI-generatieerde inhoud

De verspreiding van AI-generatieerde inhoud heeft een nieuw probleem geschapen: het onderscheiden van echte menselijke schrijving van “AI slop” - laagwaardige, massaproduceerde synthetische tekst.

Cognee testen met lokale LLMs - reële resultaten

Cognee is een Python-framework voor het bouwen van kennisgrafieken uit documenten met behulp van LLMs. Werkt het echter met zelfgehoste modellen?

Typeveilig LLM-uitvoer met BAML en Instructor

Bij het werken met grote taalmodellen in productie is het verkrijgen van gestructureerde, typeveilige uitvoer van kritiek belang. Twee populaire frameworks - BAML en Instructor - nemen verschillende benaderingen om dit probleem op te lossen.