Handleiding voor Retrieval-Augmented Generation (RAG): architectuur, implementatie en gids voor productie

Van basis RAG tot productie: chunking, vectorzoeken, herschikken en evaluatie in één gids.

Dit handleiding voor Generatie met Versterkte Opzoeking (RAG) is een stap-voor-stap, op productie gericht gids voor het bouwen van RAG-systemen die in de praktijk werken.

Als u op zoek bent naar:

- Hoe u een RAG-systeem bouwt

- RAG-architectuur uitgelegd

- RAG-handleiding met voorbeelden

- Hoe u RAG implementeert met vectordatabases

- RAG met her-ranking

- RAG met webzoeken

- Best practices voor RAG in productie

Dan bent u hier op de juiste plek.

Deze gids consolideert praktische kennis over RAG-implementatie, architectonische patronen en optimalisatietechnieken die worden gebruikt in productie-AI-systemen.

RAG-clusterkaart (Lees dit in volgorde)

Als u de snelste route door het RAG-cluster wilt, gebruik dan deze kaart:

- U bent hier: RAG-overzicht + end-to-end pipeline (deze pagina)

- Chunking (basis voor opzoekingskwaliteit): Chunking-strategieën in RAG

- Vectoropslag (opslag- en indexkeuzes): Vergelijking van Vector Stores voor RAG

- Opzoekingsdiepte (wanneer ‘zoeken’ niet genoeg is): Zoeken vs DeepSearch vs Deep Research

- Reranking (vaak de grootste kwaliteitswinst): Reranking met Embedding-modellen

- Embeddings + reranker-modellen (praktische implementaties):

- Geavanceerde architecturen: Geavanceerde RAG-varianten: LongRAG, Self-RAG, GraphRAG

Wat is Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) is een systeemontwerppatroon dat de volgende elementen combineert:

- Informatie-opzoeking

- Contextversterking

- Generatie door grote taalmodellen

In eenvoudige termen haalt een RAG-pipeline relevante documenten op en voegt ze toe aan de prompt voordat het model een antwoord genereert.

In tegenstelling tot fine-tuning:

- Werkt RAG met frequent bijgewerkte gegevens

- Ondersteunt het private kennisbases

- Vermindert het hallucinaties

- Vermijdt het opnieuw trainen van grote modellen

- Verbeterd het onderbouwen van antwoorden

Moderne RAG-systemen omvatten meer dan alleen vectorzoeken. Een volledige RAG-implementatie kan het volgende bevatten:

- Query-herformulering

- Hybride zoeken (BM25 + vectorzoeken)

- Cross-encoder reranking

- Meestap-opzoeking

- Integratie met webzoeken

- Evaluatie en monitoring

Minimale RAG-productieblauwdruk (Referentie-implementatie)

Gebruik dit als mentaal model (en een startgerust) voor productie-RAG.

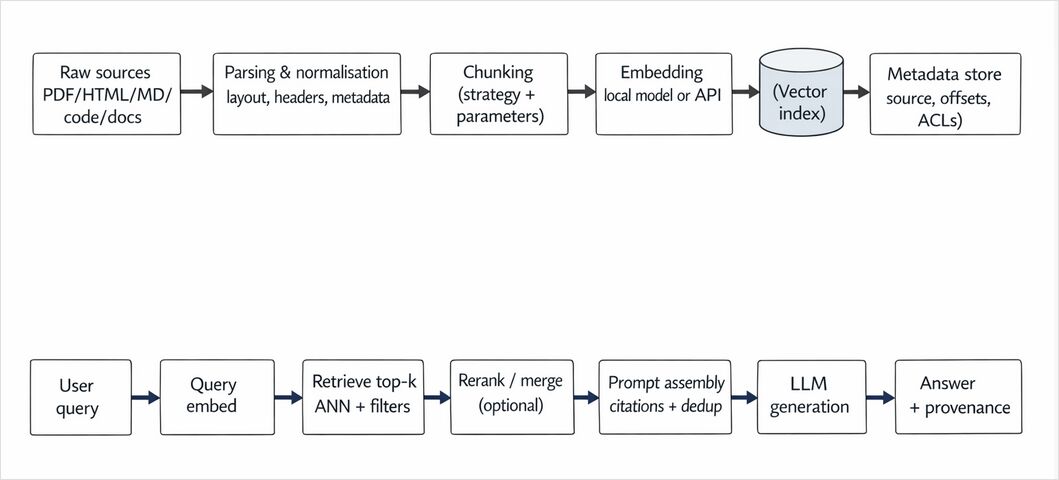

Inname-pipeline (offline of continu)

- Verzamelen bronnen (documenten, tickets, webpagina’s, PDF’s, code)

- Normaliseren (tekst extraheren, boilerplate schoonmaken, duplicaten verwijderen)

- Chunken (strategie + overlap + metadata kiezen)

- Inbedden (geversieerde embeddings)

- Opslaan in index (vectorstore + metadata-velden)

- Strategie voor opnieuw indexeren wanneer embeddings of chunking veranderen

Query-pipeline (online)

- Parse / herschrijven query (optioneel)

- Opzoeken kandidaten (vector of hybride + metadata-filtering)

- Reranken top-K met een cross-encoder / reranker-model

- Context samenstellen (duplicaten verwijderen, sorteren op relevantie, bronvermeldingen toevoegen)

- Genereren met onderbouwd prompt (regels + weigeringsgedrag)

- Loggen (opgezette set, her-rankede set, finale context, latentie, kosten)

- Evalueren (online/offline harnas)

Als u in een werkend RAG-systeem maar één ding verbetert: voeg reranking en een evaluatieharnas toe.

Stap-voor-stap RAG-handleiding: Hoe u een RAG-systeem bouwt

Dit gedeelte schetst een praktische RAG-handleidingstroom voor ontwikkelaars.

Stap 1: Bereid en chunk uw gegevens

Opzoekingskwaliteit hangt sterk af van de chunking-strategie en indexontwerp: goede RAG begint met correcte chunking.

Chunking bepaalt:

- Opzoekingsherinnering (recall)

- Latentie

- Contextruis

- Tokenkosten

- Risico op hallucinaties

Veelvoorkomende RAG-chunkingstrategieën zijn:

- Chunking met vaste grootte

- Chunking met glijdend venster

- Semantische chunking

- Recursieve chunking

- Hiërarchische chunking

- Metadata-bewuste chunking

Slechte chunking is een van de meest voorkomende oorzaken van onderpresterende RAG-systemen.

Voor een rigoureuze, engineeringsgerichte diepte-dive in chunking-afwegingen, evaluatiedimensies, beslissingsmatrices en uitvoerbare Python-implementaties, zie:

Chunking-strategieën in RAG: Alternatieven, afwegingen en voorbeelden

Die gids dekt praktische standaarden voor:

- QA-systemen

- Samenvattingspipelines

- Codezoeken

- Multimodale documenten

- Streaming-inname

- Multimodale documenten met cross-modale embeddings

Als u serieus bent over RAG-prestaties, lees dit voordat u embeddings of reranking aanpast.

Voor multimodale RAG-systemen die tekst, afbeeldingen en andere modaliteiten verbinden, verkent u Cross-Modale Embeddings: Bridging AI Modalities

Stap 2: Kies een Vectordatabase voor RAG

Een vectordatabase slaat embeddings op voor snel zoeken op similariteit.

Vergelijk vectordatabases hier:

Vergelijking van Vector Stores voor RAG

Bij het selecteren van een vectordatabase voor een RAG-handleiding of productie-systeem, overweeg:

- Indextype (HNSW, IVF, enz.)

- Filterondersteuning

- Implementatiemodel (cloud vs. self-hosted)

- Query-latentie

- Horizontale schaalbaarheid

- Vereisten voor multi-tenancy en toegangscontrole

Stap 3: Implementeer Opzoeken (Vectorzoeken of Hybride Zoeken)

Basis-RAG-opzoeken gebruikt embedding-similariteit.

Geavanceerd RAG-opzoeken gebruikt:

- Hybride zoeken (vector + trefwoord)

- Metadata-filtering

- Meervoudig-index-opzoeken

- Query-herformulering

Voor conceptuele onderbouwing:

Zoeken vs DeepSearch vs Deep Research

Begrip van opzoekingsdiepte is essentieel voor hoogwaardige RAG-pipelines.

Stap 4: Voeg Reranking toe aan uw RAG-pipeline

Reranking is vaak de grootste kwaliteitsverbetering in een RAG-implementatie.

Reranking verbetert:

- Precisie

- Contextrelevantie

- Trouw (faithfulness)

- Signaal-ruisverhouding

Leer reranking-technieken:

- Reranking met Embedding-modellen

- Qwen3 Embedding + Qwen3 Reranker op Ollama

- Reranking met Ollama + Qwen3 Embedding (Go)

- Reranking met Ollama + Qwen3 Reranker in Go

In productie-RAG-systemen telt reranking vaak meer dan het overschakelen naar een groter model.

Stap 5: Integreer Webzoeken (Optioneel maar Krachtig)

RAG met webzoeken maakt dynamische kennisopzoeking mogelijk.

Webzoeken is nuttig voor:

- Realtime-gegevens

- Nieuwsbewuste AI-assistenten

- Concurrentie-informatie

- Open domeinvragen

Zie praktische implementaties:

Stap 6: Bouw een RAG-evaluatiekader

Een serieuze RAG-handleiding moet evaluatie bevatten. Zonder dit wordt het optimaliseren van een RAG-systeem giswerk.

Wat te meten

| Laag | Wat te meten | Waarom het belangrijk is |

|---|---|---|

| Inname | chunk-dekking, duplicatiegraad, embedding-versie | voorkomt stille drift |

| Opzoeken | recall@k, precisie@k, MRR/NDCG | laat zien of u de juiste bewijsvoering ophaalt |

| Reranking | delta in precisie@k vs. basislijn | valideert reranker-ROI |

| Generatie | trouw / onderbouwing, nauwkeurigheid van bronvermeldingen, kwaliteit van weigering | vermindert hallucinaties |

| Systeem | latentie p50/p95, kosten per query, cache-hitrate | houdt productie bruikbaar |

Minimaal evaluatieharnas (praktische checklist)

- Bouw een testset van queries (indien mogelijk echte gebruikersqueries)

- Sla voor elke query op:

- verwacht antwoord of verwachte bronnen

- toegestane bronnen (gouden documenten) indien beschikbaar

- Voer een offline batch uit:

- opzoeken kandidaten

- reranken

- genereren

- scoren (opzoeken + generatie)

- Volg metingen over tijd en faal de build bij regressies (zelfs kleine)

Begin simpel: 50–200 queries is voldoende om grote regressies op te sporen.

Geavanceerde RAG-architecturen

Zodra u basis-RAG begrijpt, verkent u geavanceerde patronen:

Geavanceerde RAG-varianten: LongRAG, Self-RAG, GraphRAG

Geavanceerde Retrieval-Augmented Generation-architecturen maken mogelijk:

- Multi-hop redenering

- Grafiekgebaseerd opzoeken

- Zelfcorrigerende lussen

- Geïntegreerde gestructureerde kennis

Deze architecturen zijn essentieel voor enterprise-grade AI-systemen.

Wanneer RAG faalt (en hoe u het oplost)

De meeste RAG-falen zijn diagnoseerbaar als u laag voor laag naar de pipeline kijkt.

- Het retourneert irrelevante context → verbeter chunking, voeg metadata-filters toe, implementeer hybride zoeken, pas K aan.

- Het haalt de juiste documenten op maar antwoordt onjuist → voeg reranking toe, verminder contextruis, verbeter prompt-onderbouwingregels.

- Het hallucineert ondanks goede documenten → forceer bronvermeldingen, voeg weigeringsgedrag toe, voeg trouw-scoring toe, verlaag de ‘creatieve’ temperatuur.

- Het is traag/duur → cache opzoeken + embeddings, verlaag rerank-K, beperk context, batch-embeds, pas ANN-indexparameters aan.

- Het lekt gegevens tussen tenants → implementeer ACL-filtering op opzoekmoment (niet alleen in prompt), gebruik gescheiden indexes of per-tenant-partities.

Veelgemaakte RAG-implementatiefouten

Veelgemaakte fouten in beginnende RAG-handleidingen zijn:

- Gebruik van te grote documentchunks

- Reranking overslaan

- Het contextvenster overladen

- Geen filtering van metadata

- Geen evaluatieharnas

Het oplossen hiervan verbetert de prestaties van RAG-systemen drastisch.

RAG vs Fine-tuning

In veel handleidingen worden RAG en fine-tuning verward. Gebruik deze beslissingsgids:

| U zou moeten prefereren… | Wanneer… |

|---|---|

| RAG | kennis verandert frequent; u hebt bronvermeldingen/controleerbaarheid nodig; u hebt private documenten; u wilt snelle updates zonder opnieuw trainen |

| Fine-tuning | u consistente toon/gedrag nodig heeft; u wilt dat het model een domeinstijlgids volgt; uw kennis relatief statisch is |

| Beide | u domeingedrag en verse/private kennis nodig heeft (veelvoorkomend in productie) |

Gebruik RAG voor:

- Externe kennisopzoeking

- Frequent bijgewerkte gegevens

- Lager operationeel risico

Gebruik fine-tuning voor:

- Gedragscontrole

- Consistentie in toon/stijl

- Domeinanpassing wanneer gegevens statisch zijn

De meeste geavanceerde AI-systemen combineren Retrieval-Augmented Generation met selectieve fine-tuning.

Best Practices voor RAG in productie

Als u verder gaat dan een RAG-handleiding naar productie:

Opzoeken + kwaliteit

- Gebruik hybride opzoeken

- Voeg reranking toe

- Gebruik metadata-filtering en duplicaatverwijdering

- Volg continu opzoekingsmetrieken (recall@k / precisie@k)

Kosten + latentie (sla dit niet over)

- Cache:

- Embedding-cache (identieke tekst → identieke embedding)

- Opzoek-cache (populaire queries)

- Antwoord-cache (voor deterministische workflows)

- Pas ANN-indexparameters (HNSW/IVF) aan en batch-operaties

- Beheer tokengebruik: kleinere context, minder kandidaten, gestructureerde prompts

Beveiliging + privacy

- Voer toegangscontrole uit op opzoekmoment (ACL-filters / per-tenant-partities)

- Redacteer of vermijd het indexeren van PII waar mogelijk

- Log veilig (slaat geen ruwe gevoelige prompts tenzij vereist)

Operationele discipline

- Versie uw embeddings en chunking-strategie

- Automatiseer innamepipelines

- Monitor hallucinatie/trouwmetrieken

- Volg kosten per query

Retrieval-Augmented Generation is niet alleen een handleidingconcept - het is een productie-architectuurdiscipline.

Eindgedachten

Deze RAG-handleiding dekt zowel beginnende implementatie als geavanceerd systeemontwerp.

Retrieval-Augmented Generation is de ruggengraat van moderne AI-toepassingen.

Het beheersen van RAG-architectuur, reranking, vectordatabases, hybride zoeken en evaluatie zal bepalen of uw AI-systeem een demo blijft - of productieklare wordt.

Dit onderwerp zal blijven uitbreiden naarmate RAG-systemen evolueren.