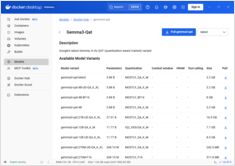

LocalAI QuickStart: Voer OpenAI-compatibele LLM's lokaal uit

Host OpenAI-compatibele API's in enkele minuten met LocalAI.

LocalAI is een self-hosted, local-first inference server die ontworpen is om te gedragen als een drop-in OpenAI API voor het uitvoeren van AI-werklasten op uw eigen hardware (laptop, workstation of on-premise server).