RAG-Tutorial: Architektur, Implementierung und Produktionsleitfaden

Von RAG-Grundlagen bis zur Produktion: Chunking, Vektorsuche, Reranking und Evaluation in einer Anleitung.

Dieser Retrieval-Augmented Generation (RAG)-Tutorial ist eine schrittweise, produktionsorientierte Anleitung zum Aufbau praxisnaher RAG-Systeme.

Wenn Sie nach Folgendem suchen:

- Wie man ein RAG-System erstellt

- Erklärung der RAG-Architektur

- RAG-Tutorial mit Beispielen

- Implementierung von RAG mit Vektordatenbanken

- RAG mit Neuranking (Reranking)

- RAG mit Websuche

- Best Practices für RAG in der Produktion

Sie sind hier genau richtig.

Dieser Leitfaden bündelt praktisches Wissen zur RAG-Implementierung, architektonische Muster und Optimierungstechniken, die in produktionsreifen KI-Systemen eingesetzt werden.

RAG-Cluster-Karte (in dieser Reihenfolge lesen)

Wenn Sie den schnellsten Weg durch den RAG-Cluster finden möchten, nutzen Sie diese Karte:

- Sie sind hier: RAG-Übersicht + End-to-End-Pipeline (diese Seite)

- Chunking (Grundlage der Abrufqualität): Chunking-Strategien in RAG

- Vektor-Speicher (Speicher- und Indexierungsentscheidungen): Vergleich von Vektor-Speichern für RAG

- Abruftiefe (wenn „Suche" nicht ausreicht): Suche vs. DeepSearch vs. Deep Research

- Neuranking (oft der größte Qualitätsgewinn): Neuranking mit Embedding-Modellen

- Embeddings + Neuranking-Modelle (praktische Implementierungen):

- Erweiterte Architekturen: Erweiterte RAG-Varianten: LongRAG, Self-RAG, GraphRAG

Was ist Retrieval-Augmented Generation (RAG)?

Retrieval-Augmented Generation (RAG) ist ein Systemdesignmuster, das Folgendes kombiniert:

- Informationsabruf

- Kontextanreicherung

- Generierung durch große Sprachmodelle

Einfach ausgedrückt: Eine RAG-Pipeline ruft relevante Dokumente ab und fügt sie dem Prompt hinzu, bevor das Modell eine Antwort generiert.

Im Gegensatz zum Feinabstimmen (Fine-Tuning) bietet RAG:

- Funktionsfähigkeit mit häufig aktualisierten Daten

- Unterstützung privater Wissensbasen

- Verringerung von Halluzinationen

- Vermeidung des Neutraining großer Modelle

- Verbesserte Fundierung der Antworten

Moderne RAG-Systeme umfassen mehr als nur die Vektorsuche. Eine vollständige RAG-Implementierung kann folgende Elemente enthalten:

- Umformulierung von Abfragen (Query Rewriting)

- Hybride Suche (BM25 + Vektorsuche)

- Cross-Encoder-Neuranking

- Mehrstufiger Abruf

- Integration der Websuche

- Evaluierung und Überwachung

Minimaler RAG-Blaupause für die Produktion (Referenzimplementierung)

Nutzen Sie dies als mentales Modell (und als Startgerüst) für RAG in der Produktion.

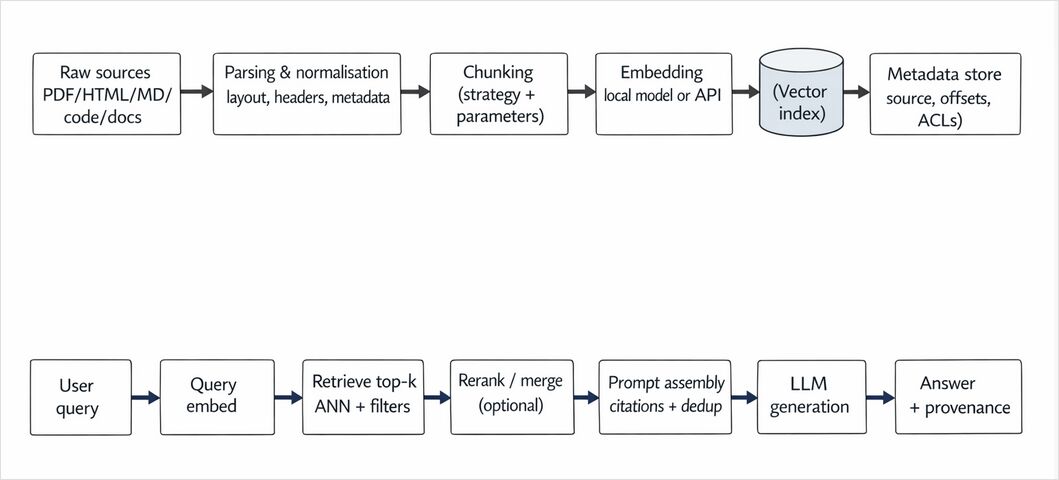

Eingabepipeline (offline oder kontinuierlich)

- Sammeln von Quellen (Dokumente, Tickets, Webseiten, PDFs, Code)

- Normalisieren (Textextraktion, Bereinigung von Standardtexten, Deduplizierung)

- Chunking (Wahl der Strategie + Überlappung + Metadaten)

- Einbetten (versionierte Embeddings)

- Upsert in den Index (Vektorspeicher + Metadatenfelder)

- Reindexierungsstrategie, wenn sich Embeddings oder Chunking ändern

Abfragepipeline (online)

- Parsen / Umformulieren der Abfrage (optional)

- Abrufen von Kandidaten (Vektor- oder hybride Suche + Metadatenfilterung)

- Neuranking der Top-K-Ergebnisse mit einem Cross-Encoder / Reranker-Modell

- Kontext zusammenstellen (Deduplizierung, Sortierung nach Relevanz, Hinzufügen von Zitaten)

- Generieren mit fundiertem Prompt (Regeln + Verwehrt-Verhalten)

- Protokollieren (Abrufmenge, neu rangierte Menge, endgültiger Kontext, Latenz, Kosten)

- Evaluieren (Online-/Offline-Harness)

Wenn Sie in einem funktionierenden RAG-System nur eine Sache verbessern: Fügen Sie Neuranking und einen Evaluierungs-Harness hinzu.

Schritt-für-Schritt-RAG-Tutorial: Wie man ein RAG-System erstellt

Dieser Abschnitt skizziert einen praktischen RAG-Tutorial-Ablauf für Entwickler.

Schritt 1: Daten vorbereiten und in Chunks aufteilen

Die Abrufqualität hängt stark von der Chunking-Strategie und dem Indexdesign ab: Ein gutes RAG beginnt mit korrektem Chunking.

Chunking bestimmt:

- Abruf-Recall

- Latenz

- Kontextrauschen

- Token-Kosten

- Risiko von Halluzinationen

Zu den gängigen RAG-Chunking-Strategien gehören:

- Chunking mit fester Größe

- Sliding-Window-Chunking

- Semantisches Chunking

- Rekursives Chunking

- Hierarchisches Chunking

- Metadaten-bewusstes Chunking

Schlechtes Chunking ist eine der häufigsten Ursachen für unterdurchschnittliche RAG-Systeme.

Für eine gründliche, ingenieurwissenschaftlich fundierte Analyse von Chunking-Abwägungen, Evaluierungsdimensionen, Entscheidungsmatrizen und ausführbaren Python-Implementierungen lesen Sie:

Chunking-Strategien in RAG: Alternativen, Abwägungen und Beispiele

Dieser Leitfaden deckt praktische Standardwerte ab für:

- QA-Systeme

- Zusammenfassungspipelines

- Codesuche

- Multimodale Dokumente

- Streaming-Eingabe

- Multimodale Dokumente mit cross-modalem Embeddings

Wenn Sie ernsthaft an der RAG-Leistung interessiert sind, lesen Sie dies, bevor Sie Embeddings oder Neuranking optimieren.

Für multimodale RAG-Systeme, die Text, Bilder und andere Modalitäten verbinden, erkunden Sie Cross-Modal Embeddings: Brückenschlag zwischen KI-Modalitäten

Schritt 2: Wählen Sie eine Vektordatenbank für RAG

Eine Vektordatenbank speichert Embeddings für eine schnelle Ähnlichkeitssuche.

Vergleichen Sie Vektordatenbanken hier:

Vektor-Speicher für RAG - Vergleich

Bei der Auswahl einer Vektordatenbank für einen RAG-Tutorial oder ein Produktionssystem sollten Sie Folgendes berücksichtigen:

- Indextyp (HNSW, IVF usw.)

- Unterstützung von Filtern

- Bereitstellungsmodell (Cloud vs. Self-Hosted)

- Abfragelatenz

- Horizontale Skalierbarkeit

- Anforderungen an Multi-Tenancy und Zugriffskontrolle

Schritt 3: Implementieren Sie den Abruf (Vektorsuche oder hybride Suche)

Grundlegender RAG-Abruf nutzt Embedding-Ähnlichkeit.

Erweiterte RAG-Abruftechniken nutzen:

- Hybride Suche (Vektor + Keyword)

- Metadatenfilterung

- Abruf über mehrere Indizes

- Umformulierung von Abfragen

Für das konzeptionelle Fundament:

Suche vs. DeepSearch vs. Deep Research

Das Verständnis der Abruftiefe ist für hochwertige RAG-Pipelines unerlässlich.

Schritt 4: Fügen Sie Neuranking in Ihre RAG-Pipeline ein

Neuranking ist oft die größte Qualitätsverbesserung bei der RAG-Implementierung.

Neuranking verbessert:

- Präzision

- Kontextrelevanz

- Treue (Faithfulness)

- Signal-Rausch-Verhältnis

Erfahren Sie mehr über Neuranking-Techniken:

- Neuranking mit Embedding-Modellen

- Qwen3 Embedding + Qwen3 Reranker auf Ollama

- Neuranking mit Ollama + Qwen3 Embedding (Go)

- Neuranking mit Ollama + Qwen3 Reranker in Go

In produktionsreifen RAG-Systemen ist Neuranking oft wichtiger als der Wechsel zu einem größeren Modell.

Schritt 5: Integrieren Sie die Websuche (optional, aber wirkungsvoll)

RAG mit Websuche ermöglicht die dynamische Wissensabruf.

Websuche ist nützlich für:

- Echtzeitdaten

- Nachrichtenbewusste KI-Assistenten

- Wettbewerbsanalyse

- Fragen mit offenem Domänenbereich

Sehen Sie praktische Implementierungen:

Schritt 6: Erstellen Sie einen RAG-Evaluierungsrahmen

Ein ernsthafter RAG-Tutorial muss die Evaluierung beinhalten. Ohne sie wird die Optimierung eines RAG-Systems zum Ratespiel.

Was zu messen ist

| Schicht | Was zu messen ist | Warum es wichtig ist |

|---|---|---|

| Eingabe | Chunk-Abdeckung, Duplikationsrate, Embedding-Version | verhindert stillschweigende Drift |

| Abruf | recall@k, precision@k, MRR/NDCG | zeigt, ob Sie die richtigen Beweise abrufen |

| Neuranking | Delta in precision@k im Vergleich zur Basislinie | validiert die ROI des Rerankers |

| Generierung | Treue / Fundierung, Genauigkeit der Zitate, Qualität der Verweigerung | reduziert Halluzinationen |

| System | Latenz p50/p95, Kosten pro Abfrage, Cache-Trefferquote | hält das System in der Produktion nutzbar |

Minimaler Evaluierungs-Harness (praktische Checkliste)

- Erstellen Sie einen Testsatz von Abfragen (wenn möglich echte Nutzerabfragen)

- Speichern Sie für jede Abfrage:

- erwartete Antwort oder erwartete Quellen

- erlaubte Quellen (Gold-Dokumente), falls verfügbar

- Führen Sie ein Offline-Batch durch:

- Kandidaten abrufen

- neu ranken

- generieren

- bewerten (Abruf + Generierung)

- Verfolgen Sie Metriken über die Zeit und versagen Sie den Build bei Regressionen (auch bei kleinen)

Beginnen Sie einfach: 50–200 Abfragen reichen aus, um größere Regressionen zu erkennen.

Erweiterte RAG-Architekturen

Sobald Sie das grundlegende RAG verstanden haben, erkunden Sie erweiterte Muster:

Erweiterte RAG-Varianten: LongRAG, Self-RAG, GraphRAG

Erweiterte Architekturen für Retrieval-Augmented Generation ermöglichen:

- Mehrstufiges Reasoning

- Graph-basierten Abruf

- Selbstkorrigierende Schleifen

- Integration strukturierten Wissens

Diese Architekturen sind für unternehmensfähige KI-Systeme unerlässlich.

Wenn RAG scheitert (und wie man es repariert)

Die meisten RAG-Fehler sind diagnostizierbar, wenn Sie die Pipeline Schicht für Schicht betrachten.

- Es gibt irrelevante Kontexte zurück → verbessern Sie das Chunking, fügen Sie Metadatenfilter hinzu, implementieren Sie hybride Suche, justieren Sie K.

- Es ruft die richtigen Dokumente ab, beantwortet aber falsch → fügen Sie Neuranking hinzu, reduzieren Sie Kontextrauschen, verbessern Sie die Prompt-Grounding-Regeln.

- Es halluziniert trotz guter Dokumente → erzwingen Sie Zitate, fügen Sie Verwehrt-Verhalten hinzu, fügen Sie Treue-Scores hinzu, reduzieren Sie die „kreative" Temperatur.

- Es ist langsam/teuer → cachen Sie Abruf + Embeddings, reduzieren Sie das Neuranking-K, begrenzen Sie den Kontext, batchen Sie Embeds, justieren Sie ANN-Index-Parameter.

- Es leckt Daten zwischen Mietern → implementieren Sie Zugriffskontrolle zur Abrufzeit (ACL-Filter / Partitionen pro Mieter), trennen Sie Indizes oder Partitionen pro Mieter.

Häufige RAG-Implementierungsfehler

Zu den häufigen Fehlern in RAG-Tutorials für Anfänger gehören:

- Verwendung von übermäßig großen Dokument-Chunken

- Überspringen des Neurankings

- Überlastung des Kontextfensters

- Keine Filterung von Metadaten

- Fehlender Evaluierungs-Harness

Das Beheben dieser Probleme verbessert die Leistung von RAG-Systemen drastisch.

RAG vs. Feinabstimmung (Fine-Tuning)

In vielen Tutorials werden RAG und Fine-Tuning verwechselt. Nutzen Sie diese Entscheidungshilfe:

| Sie sollten lieber… | Wenn… |

|---|---|

| RAG | sich das Wissen häufig ändert; Sie Zitate/Nachvollziehbarkeit benötigen; Sie private Dokumente haben; Sie schnelle Updates ohne Neutraining wünschen |

| Fine-Tuning | Sie einen konsistenten Ton/Verhalten benötigen; Sie möchten, dass das Modell einem Domänen-Stilguide folgt; Ihr Wissen relativ statisch ist |

| Beides | Sie Domänenverhalten und frisches/privates Wissen benötigen (häufig in der Produktion) |

Nutzen Sie RAG für:

- Abruf externen Wissens

- Häufig aktualisierte Daten

- Geringeres operatives Risiko

Nutzen Sie Fine-Tuning für:

- Verhaltenskontrolle

- Konsistenz von Ton und Stil

- Domänenanpassung, wenn Daten statisch sind

Die meisten fortschrittlichen KI-Systeme kombinieren Retrieval-Augmented Generation mit selektivem Fine-Tuning.

Best Practices für RAG in der Produktion

Wenn Sie über einen RAG-Tutorial hinaus in die Produktion gehen:

Abruf + Qualität

- Nutzen Sie hybriden Abruf

- Fügen Sie Neuranking hinzu

- Nutzen Sie Metadatenfilterung und Deduplizierung

- Verfolgen Sie Abrufmetriken (recall@k / precision@k) kontinuierlich

Kosten + Latenz (dies nicht überspringen)

- Cachen Sie:

- Embedding-Cache (identischer Text → identisches Embedding)

- Abruf-Cache (beliebte Abfragen)

- Antwort-Cache (für deterministische Workflows)

- Justieren Sie ANN-Index-Parameter (HNSW/IVF) und Batch-Operationen

- Kontrollieren Sie die Token-Nutzung: kleinerer Kontext, weniger Kandidaten, strukturierte Prompts

Sicherheit + Datenschutz

- Führen Sie Zugriffskontrolle zur Abrufzeit durch (ACL-Filter / Partitionen pro Mieter)

- Redigieren Sie PII oder vermeiden Sie deren Indexierung, wo möglich

- Protokollieren Sie sicher (speichern Sie keine rohen sensiblen Prompts, es sei denn, dies ist erforderlich)

Operative Disziplin

- Versionieren Sie Ihre Embeddings und Chunking-Strategie

- Automatisieren Sie Eingabepipelines

- Überwachen Sie Metriken für Halluzinationen/Treue

- Verfolgen Sie die Kosten pro Abfrage

Retrieval-Augmented Generation ist nicht nur ein Tutorial-Konzept – es ist eine Disziplin der Produktionsarchitektur.

Abschließende Gedanken

Dieser RAG-Tutorial deckt sowohl die Implementierung für Anfänger als auch das fortgeschrittene Systemdesign ab.

Retrieval-Augmented Generation ist das Rückgrat moderner KI-Anwendungen.

Die Beherrschung von RAG-Architektur, Neuranking, Vektordatenbanken, hybrider Suche und Evaluierung wird darüber entscheiden, ob Ihr KI-System nur eine Demo bleibt – oder produktionsreif wird.

Dieses Thema wird sich weiterentwickeln, da sich RAG-Systeme weiterentwickeln.