LocalAI QuickStart: OpenAI-kompatible LLMs lokal ausführen

Bereitstellen von OpenAI-kompatiblen APIs mit LocalAI in wenigen Minuten auf dem eigenen Server.

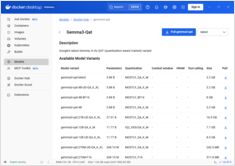

LocalAI ist ein selbstgehosteter, lokal-first Inferenzserver, der sich wie eine Drop-in OpenAI API verhält, um KI-Arbeitslasten auf Ihrer eigenen Hardware (Laptop, Workstation oder lokaler Server) auszuführen.