Qwen3 Embedding- en Reranker-modellen op Ollama: State-of-the-Art-prestaties

Nieuwe, geweldige LLM's beschikbaar in Ollama

De Qwen3 Embedding en Reranker-modellen zijn de nieuwste releases in de Qwen-familie, specifiek ontworpen voor geavanceerde tekst-inbedding (embedding), ophalen (retrieval) en her-ranking taken.

Genot voor het oog

De Qwen3 Embedding en Reranker-modellen vertegenwoordigen een significante vooruitgang in meertalige natuurlijke taalverwerking (NLP) en bieden state-of-the-art prestaties bij taken rond tekst-inbedding en her-ranking. Deze modellen, onderdeel van de Qwen-serie ontwikkeld door Alibaba, zijn ontworpen om een breed scala aan toepassingen te ondersteunen, van semantisch ophalen tot codesoek. Dit soort inbeddingsmogelijkheden is fundamenteel voor het bouwen van effectieve RAG-systemen, zoals uitgebreid behandeld in de Retrieval-Augmented Generation (RAG) Tutorial: Architecture, Implementation, and Production Guide. Hoewel Ollama een populaire open-source platform is voor het hosten en implementeren van grote taalmodellen (LLM’s), is de integratie van Qwen3-modellen met Ollama niet expliciet gedetailleerd in de officiële documentatie. De modellen zijn echter toegankelijk via Hugging Face, GitHub en ModelScope, wat lokale implementatie via Ollama of vergelijkbare tools mogelijk maakt.

Voorbeelden met deze modellen

Zie onderstaande voorbeeldcode in Go met Ollama en deze modellen:

- Reranking van tekstdocumenten met Ollama en Qwen3 Embedding-model - in Go

- Reranking van tekstdocumenten met Ollama en Qwen3 Reranker-model - in Go

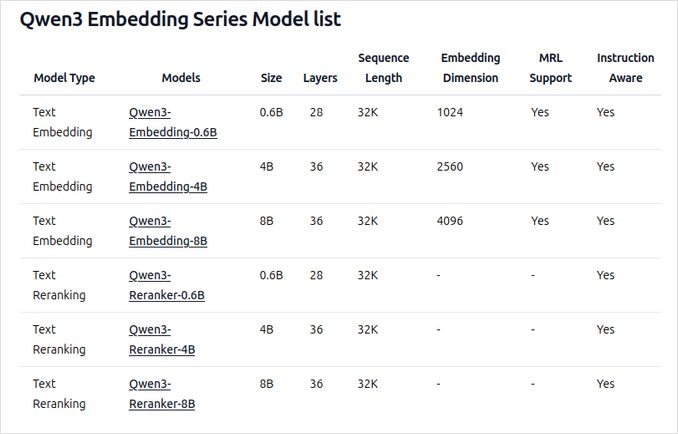

Overzicht van de nieuwe Qwen3 Embedding en Reranker-modellen op Ollama

Deze modellen zijn nu beschikbaar voor implementatie op Ollama in verschillende groottes, met state-of-the-art prestaties en flexibiliteit voor een breed scala aan taal- en code-gerelateerde toepassingen.

Belangrijkste kenmerken en mogelijkheden

-

Modelgroottes en flexibiliteit

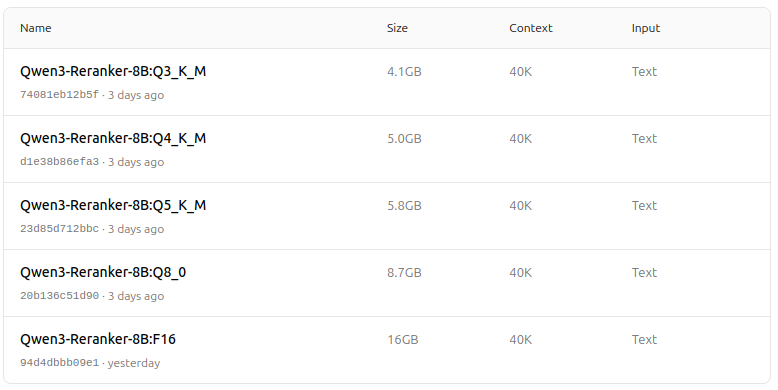

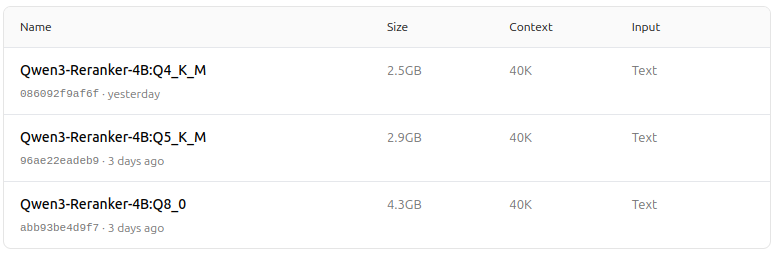

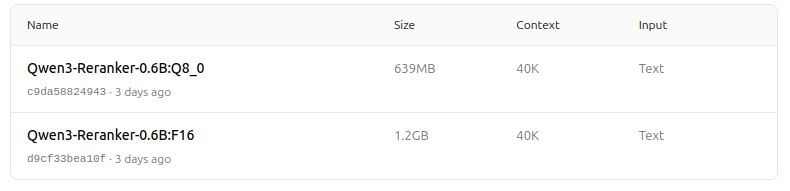

- Beschikbaar in meerdere groottes: 0,6B, 4B en 8B parameters voor zowel embedding- als reranking-taken.

- Het 8B embedding-model staat momenteel op nummer 1 op de MTEB-meertalige leaderboard (per 5 juni 2025, met een score van 70,58).

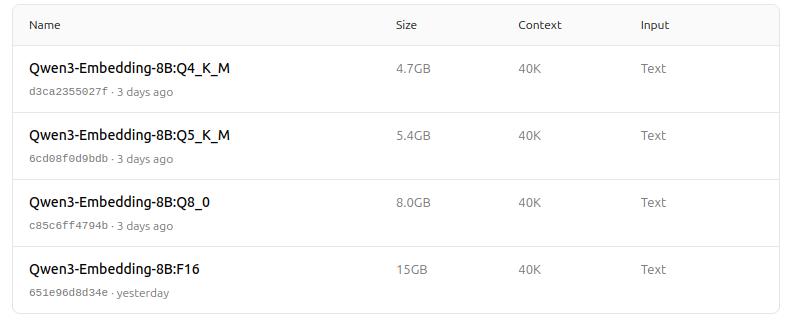

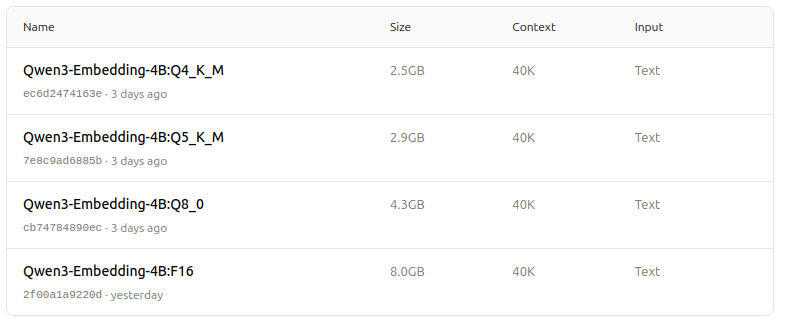

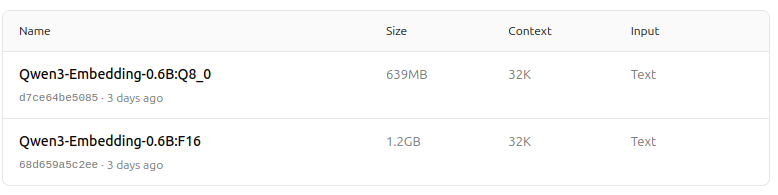

- Ondersteunt een reeks kwantisatie-opties (Q4, Q5, Q8, enz.) om een balans te vinden tussen prestaties, geheugengebruik en snelheid. Q5_K_M wordt aanbevolen voor de meeste gebruikers, aangezien het de meeste modelprestaties behoudt terwijl het efficiënt is qua resources.

-

Architectuur en training

- Gebouwd op de Qwen3-fundering, waarbij gebruik wordt gemaakt van zowel dual-encoder (voor embeddings) als cross-encoder (voor reranking) architecturen.

- Embedding-model: Verwerkt enkele tekstsegmenten en extracteert semantische representaties uit de laatste verborgen staat (hidden state).

- Reranker-model: Neemt tekstparen (bijv. query en document) en geeft een relevantiescore uit via een cross-encoder-aanpak.

- Embedding-modellen maken gebruik van een trainingsparadigma in drie fasen: contrastief pre-training, toezichthoudend training met hoogwaardige data en model-fusion voor optimale generalisatie en aanpassingsvermogen.

- Reranker-modellen worden direct getraind met hoogwaardige gelabelde data voor efficiëntie en effectiviteit.

-

Meertalige en multitask-ondersteuning

- Ondersteunt meer dan 100 talen, inclusief programmeertalen, wat robuuste meertalige, cross-linguale en code-ophalmogelijkheden mogelijk maakt.

- Embedding-modellen stellen flexibele vectordefinities en door de gebruiker gedefinieerde instructies mogelijk om prestaties af te stemmen op specifieke taken of talen.

- Voor toepassingen die multimodale mogelijkheden nodig hebben die verder gaan dan tekst, zie Cross-Modal Embeddings: Bridging AI Modalities.

-

Prestaties en gebruiksscenario’s

- State-of-the-art resultaten in tekstophalen, codeophalen, classificatie, clusteranalyse en bitext-mining.

- Reranker-modellen excelleren in verschillende tekstophaalscenario’s en kunnen naadloos worden gecombineerd met embedding-modellen voor end-to-end ophaalpijplijnen.

Hoe te gebruiken op Ollama

U kunt deze modellen op Ollama uitvoeren met commando’s zoals:

ollama run dengcao/Qwen3-Embedding-8B:Q5_K_M

ollama run dengcao/Qwen3-Reranker-0.6B:F16

Kies de kwantisatieversie die het beste past bij uw hardware en prestatiebehoeften.

Update december 2025: Ollama biedt nu standaard Qwen3-embeddingmodellen, afkomstig uit hun eigen repo, niet die van dengcao:

ollama pull qwen3-embedding:8b

ollama pull qwen3-embedding:4b

Zie meer: https://ollama.com/library/qwen3-embedding

Samenvattende tabel

| Modeltype | Beschikbare groottes | Belangrijkste sterktes | Meertalige ondersteuning | Kwantisatie-opties |

|---|---|---|---|---|

| Embedding | 0,6B, 4B, 8B | Top MTEB-scores, flexibel, efficiënt, SOTA | Ja (100+ talen) | Q4, Q5, Q6, Q8, enz. |

| Reranker | 0,6B, 4B, 8B | Excelleren in relevantie van tekstparen, efficiënt, flexibel | Ja | F16, Q4, Q5, enz. |

Fantastisch nieuws!

De Qwen3 Embedding en Reranker-modellen op Ollama vertegenwoordigen een significante sprong vooruit in meertalige, multitask-tekst- en code-ophaalcapaciteiten. Met flexibele implementatieopties, sterke benchmarkprestaties en ondersteuning voor een breed scala aan talen en taken, zijn ze geschikt voor zowel onderzoeks- als productieomgevingen.

Model zoo - nu genot voor het oog

Qwen3 Embedding

https://ollama.com/dengcao/Qwen3-Embedding-8B

https://ollama.com/dengcao/Qwen3-Embedding-4B/tags

https://ollama.com/dengcao/Qwen3-Embedding-0.6B/tags

Qwen3 Reranker

https://ollama.com/dengcao/Qwen3-Reranker-8B

dengcao/Qwen3-Reranker-8B:Q3_K_M

dengcao/Qwen3-Reranker-8B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-4B/tags

dengcao/Qwen3-Reranker-4B:Q5_K_M

https://ollama.com/dengcao/Qwen3-Reranker-0.6B/tags

Leuk!

Nuttige links

- Reranking van tekstdocumenten met Ollama en Qwen3 Embedding-model - in Go

- Reranking van tekstdocumenten met Ollama en Qwen3 Reranker-model - in Go

- Ollama cheatsheet

- Ollama-modellen verplaatsen naar een andere drive of map

- Self-hosting van Perplexica - met Ollama

- Test: Hoe Ollama Intel CPU-prestaties en Efficient Cores gebruikt

- LLM-snelheidsprestatievergelijking

- Vergelijking van LLM-samenvattingsvermogens

- Cloud LLM-aanbieders

- Hoe Ollama parallelle verzoeken afhandelt

- Vergelijking van de vertaalingskwaliteit van Hugo-pagina’s - LLM’s op Ollama